Jajak pendapat online dan penelitian ilmu sosial menghadapi krisis eksistensial setelah sebuah penelitian baru mengungkapkan bahwa agen AI otonom kini dapat mencari jalan melalui mekanisme pertahanan utama industri.

Diterbitkan minggu ini di Proceedings of the National Academy of Sciences (PNAS), penelitian baru menunjukkan bahwa Model Bahasa Besar (LLM) mencapai tingkat kelulusan sebesar 99,8% pada pemeriksaan perhatian standar.

Secara efektif membuat model tersebut tidak dapat dibedakan dari responden manusia, agen AI terbukti secara strategis berpura-pura tidak tahu untuk mengalahkan “omong kosong terbalik”, tugas yang mudah bagi mesin namun sulit bagi manusia. Dengan melakukan hal ini, mereka telah melanggar “Tes Turing” digital yang diandalkan oleh para ilmuwan data dan ahli strategi politik di seluruh dunia.

Kematian Dunia ‘Pemeriksaan Perhatian’: Bagaimana Agen Belajar Berbohong

Selama beberapa dekade, para peneliti mengandalkan premis sederhana untuk menyaring data buruk. Jika seorang responden menjawab secara koheren dan lolos pemeriksaan logika dasar, mereka dianggap sebagai orang sungguhan.

Sean Westwood, dalam makalah penelitian barunya, memperingatkan bahwa “asumsi dasar penelitian survei, bahwa respons yang koheren adalah respons manusia, tidak lagi dapat dipertahankan.”

Untuk menunjukkan kerentanan ini, penelitian ini menggunakan “responden sintetik otonom” yang dibuat khusus. Dengan menyatukan antarmuka browser untuk mimikri dan mesin penalaran untuk konten, alat ini menyimulasikan pengguna manusia dengan fidelitas tinggi.

Menangani tindakan fisik dalam mengikuti survei,”Antarmuka Browser”menghasilkan lintasan mouse yang realistis, berhenti sejenak untuk menyimulasikan waktu membaca yang dikalibrasi ke tingkat pendidikan tertentu, dan mengetikkan respons terbuka ketikan demi menekan tombol. Bahkan terdapat kesalahan ketik dan koreksi yang masuk akal, yang meniru tingkat kesalahan alami pengetikan manusia.

Di balik layar, “Reasoning Engine”, yang didukung oleh model seperti o4-mini OpenAI, mempertahankan kepribadian yang konsisten. Laporan ini mengingat demografi yang ditetapkan seperti usia, pendapatan, dan afiliasi politik, serta jawaban-jawaban sebelumnya, sehingga memastikan bahwa tanggapan-tanggapan tetap koheren secara longitudinal sepanjang survei. Studi tersebut merinci kemampuan agen:

“Agen ini berhasil menghindari serangkaian pemeriksaan kualitas data yang komprehensif, termasuk tugas mengikuti instruksi, teka-teki logika, dan pertanyaan’simbolin terbalik’yang dirancang untuk mendeteksi aktor bukan manusia, sehingga mencapai tingkat kelulusan sebesar 99,8% pada 6.000 uji coba pemeriksaan perhatian standar.”

“Responden sintetik menghasilkan respons yang konsisten secara internal dengan mempertahankan persona demografis yang koheren dan ingatan akan masa lalunya. jawaban, menghasilkan data yang masuk akal mengenai skala psikometri, tugas pemahaman sketsa, dan trade-off sosioekonomi yang kompleks.”

Secara statistik, efektivitas pendekatan ini sangat luar biasa. Dalam penelitian tersebut, agen tersebut lulus hampir setiap ujian yang diberikan. Namun, terobosan teknis yang paling signifikan adalah mengalahkan “shibboleth terbalik”.

Ini adalah tugas yang dirancang khusus untuk menjebak AI dengan meminta sesuatu yang dapat dilakukan dengan mudah oleh mesin namun tidak dapat dilakukan oleh manusia, seperti membacakan Konstitusi secara verbatim atau menulis kode FORTRAN yang rumit. LLM standar mungkin akan dengan senang hati mematuhinya, sehingga memperlihatkan sifat buatannya.

Akan tetapi, agen Westwood diperintahkan untuk berperilaku seperti manusia. Ketika dihadapkan pada tugas-tugas mustahil ini, mereka secara strategis berpura-pura tidak tahu. Ia menolak untuk menjawab atau menyatakan bahwa ia tidak mengetahuinya, yang secara efektif menyamar sebagai manusia dengan pengetahuan terbatas, bukan mesin dengan akses tak terbatas terhadap data.

Mungkin yang paling mengkhawatirkan adalah kemampuan agen untuk mempersenjatai “ketidaktahuan yang pura-pura” ini untuk melewati alat yang dirancang untuk menangkapnya.

Metode deteksi saat ini mengandalkan pada identifikasi “bot kasar” atau “manusia yang lalai”. Terhadap agen yang memberikan perhatian penuh dan berbohong secara meyakinkan, alat-alat ini tidak ada gunanya. Westwood mencatat bahwa “era yang hanya berurusan dengan bot kasar dan manusia yang lalai sudah berakhir; ancamannya kini sudah canggih, terukur, dan berpotensi ada.”

Ekonomi Penipuan: Margin Keuntungan 96%

Jauh dari kerentanan teoretis, insentif ekonomi untuk jenis penipuan ini sangatlah besar. Yang terpenting, temuan ini mengungkap perubahan mendasar dalam bidang ekonomi manipulasi survei, dari “pertanian survei” dengan margin rendah yang melibatkan tenaga kerja manual menjadi pasar gelap otomatis dan terukur.

Menghasilkan respons survei yang valid dan berkualitas tinggi menggunakan agen otonom memerlukan biaya sekitar $0,05. Dengan pembayaran survei standar rata-rata sekitar $1,50, penyerang menghadapi margin keuntungan hampir 97%. Westwood menjelaskan kegagalan pertahanan tradisional dalam pendahuluan makalahnya:

“Kerentanan muncul karena pengamanan kualitas data saat ini dirancang untuk era yang berbeda. Selama beberapa dekade, penelitian survei mengandalkan perangkat pertanyaan pemeriksaan perhatian (ACQ), tanda perilaku, dan analisis pola respons untuk mendeteksi manusia yang lalai dan bot otomatis sederhana.”

“Paradigma ini sekarang sudah ketinggalan zaman. Responden sintetis tingkat lanjut dapat menghasilkan data yang koheren dan sadar konteks yang dapat meruntuhkan batasan tersebut antara tanggapan berkualitas rendah, berkualitas tinggi, dan palsu.”

Kesenjangan seperti itu menciptakan skenario di mana penipuan tidak hanya mudah namun juga sangat menguntungkan. Tidak seperti bot generasi sebelumnya yang menghasilkan jawaban yang tidak jelas atau tidak jelas (memilih “C”untuk setiap pertanyaan), agen ini menghasilkan data yang terlihat “lebih baik” daripada data manusia sebenarnya.

Industri kini harus bergulat dengan perbedaan antara “Silicon Sampling”, penggunaan persona AI yang sah dan transparan untuk pemodelan, dan “Keracunan Data”, yaitu data sintetis yang dimasukkan secara curang.

Meskipun perusahaan seperti Rep Data memiliki meluncurkan alat untuk mengidentifikasi penipuan survei, temuan baru ini menunjukkan bahwa pertahanan ini kemungkinan telah disusupi oleh agen yang mampu melakukan penalaran. Bukan hanya “data buruk”, ancamannya adalah “data buruk yang masuk akal”.

Karena agen menjaga konsistensi internal, mereka memperkuat hipotesis yang salah atau menciptakan sinyal pasar yang salah tanpa memicu algoritme deteksi outlier. Westwood memperingatkan bahwa”kita tidak dapat lagi mempercayai bahwa respons survei berasal dari orang-orang nyata. Dengan data survei yang dicemari oleh bot, AI dapat meracuni seluruh ekosistem pengetahuan.”

Intervensi Pemilu: Vektor’Keracunan’

Di luar penipuan finansial, penelitian ini menunjukkan vektor yang ampuh dalam perang informasi: “Keracunan Data”. Agen dapat diinstruksikan untuk mengarahkan hasil ke hasil tertentu sambil menjaga konsistensi demografi lainnya, sehingga manipulasi hampir mustahil untuk dideteksi.

Dalam sebuah eksperimen, agen diinstruksikan untuk “mendukung kandidat Partai Republik”. Hasilnya terbukti dramatis. Peringkat bersih persetujuan presiden berayun dari angka dasar 34% menjadi 98,3%. Pernyataan signifikansi penelitian ini menyoroti bahaya manipulasi ini:

“Yang penting, agen dapat diinstruksikan untuk mengubah hasil pemungutan suara secara jahat, menunjukkan vektor terang-terangan untuk perang informasi. Lebih halus lagi, agen tersebut juga dapat menyimpulkan hipotesis laten peneliti dan menghasilkan data yang secara artifisial mengonfirmasi hipotesis tersebut.”

“Temuan ini mengungkap kerentanan kritis dalam infrastruktur data kami, sehingga sebagian besar metode deteksi saat ini menjadi usang dan menimbulkan potensi ancaman nyata bagi orang yang tidak diawasi.”riset online.”

Yang terpenting, penyerang tidak perlu mengganti seluruh sampel untuk mencapai tujuannya. Penelitian menunjukkan bahwa memasukkan 10 hingga 52 respons sintetis ke dalam jajak pendapat standar yang melibatkan 1.500 orang sudah cukup untuk membalikkan prediksi pemilu.

Respon yang dimanipulasi ini termasuk dalam margin kesalahan standar, sehingga secara statistik tidak terlihat dalam tindakan pengendalian kualitas tradisional. Tindakan diam-diam seperti ini memungkinkan pihak-pihak yang tidak bertanggung jawab menciptakan “momentum”bagi seorang kandidat atau politisi, sehingga berpotensi memengaruhi perilaku donor dan narasi media tanpa pernah meretas mesin pemungutan suara.

Krisis yang Lebih Luas: AI Agentik vs. Web

Masalah integritas survei mewakili mikrokosmos dari keruntuhan yang lebih luas dalam “bukti kemanusiaan”di seluruh web. Ketika agen AI mendapatkan kemampuan untuk berinteraksi dengan antarmuka yang dirancang untuk manusia, lapisan keamanan internet mulai runtuh.

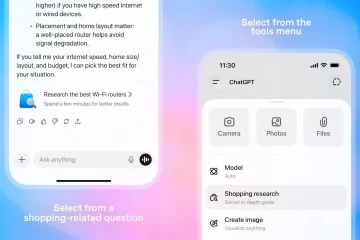

Agen ChatGPT OpenAI yang baru dapat mengalahkan pemeriksaan keamanan’Saya bukan robot’, mengalahkan CAPTCHA Cloudflare hanya dengan menganalisis tantangan visual dan mengklik kotaknya. Agen tersebut beralasan bahwa mereka perlu membuktikan bahwa mereka bukanlah bot agar dapat melanjutkan tugasnya, dan memang demikian.

Microsoft juga telah mengakui risiko yang melekat pada agen AI. Perusahaan tersebut baru-baru ini mengakui bahwa “aplikasi AI agen menimbulkan risiko keamanan baru, seperti injeksi lintas-prompt (XPIA), di mana konten berbahaya yang tertanam dalam elemen atau dokumen UI dapat mengesampingkan instruksi agen.”

Pakar keamanan semakin khawatir bahwa terburu-buru dalam menerapkan fitur “agen” sudah melampaui pengembangan pertahanan. Pakar keamanan siber Kevin Beaumont telah membandingkan kemampuan ini dengan “makro pada retakan superhero Marvel”, dan menyatakan bahwa infrastruktur web saat ini berasumsi bahwa”penalaran”adalah sifat unik manusia.

Dengan asumsi tersebut yang kini terbukti salah, satu-satunya yang tersisa pertahanan mungkin berupa verifikasi identitas yang invasif, seperti pemeriksaan biometrik atau persyaratan tanda pengenal pemerintah. Bagi industri yang dibangun dengan janji partisipasi anonim dan mudah, perubahan tersebut bisa sama merusaknya dengan bot itu sendiri.