Nvidia telah mengumumkan serangkaian alat untuk mengatasi meningkatnya kebutuhan akan kepercayaan, keamanan, dan keandalan dalam sistem AI agen.

Dikenal sebagai Nvidia Inference Microservices (NIMs), penawaran baru dirancang untuk membantu perusahaan menerapkan aplikasi AI yang mematuhi pedoman keselamatan dan mencegah hasil yang tidak diinginkan.

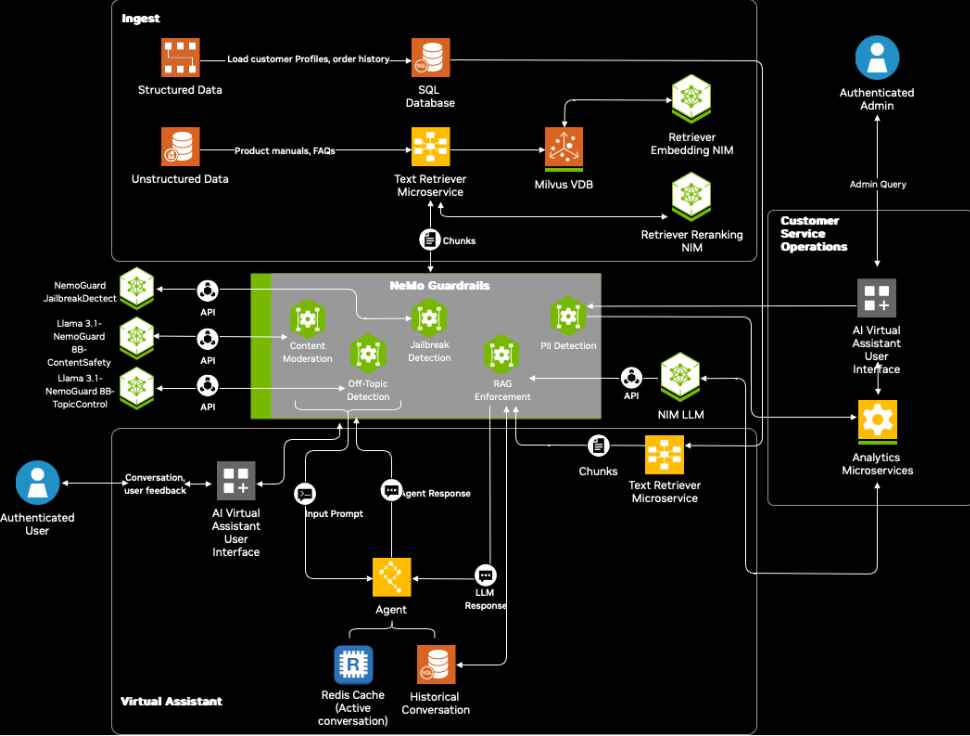

Sebagai bagian dari kerangka kerja NeMo Guardrails, layanan mikro ini memberikan solusi khusus untuk memoderasi konten, menjaga batasan percakapan, dan mendeteksi upaya untuk melewati pengamanan.

Kari Briski, Wakil Presiden Model AI Perusahaan di Nvidia, menekankan pentingnya memastikan keamanan AI dalam aplikasi saat ini. “Agen AI dengan cepat mengubah industri dengan mengotomatiskan interaksi, namun memastikan keamanan dan kepercayaan mereka sangatlah penting,” katanya dalam pengumuman resmi.

[konten tertanam]

Mengatasi Tantangan Keamanan AI dengan Layanan Mikro Khusus

Agentic AI, suatu bentuk kecerdasan buatan yang melakukan tugas secara mandiri, telah mengalami peningkatan penerapan di berbagai industri seperti ritel, layanan kesehatan, dan otomotif.

Sementara sistem ini meningkatkan efisiensi dan pelanggan dalam keterlibatannya, hal ini juga menimbulkan kekhawatiran mengenai keluaran yang berbahaya, privasi data, dan kerentanan yang merugikan. NIM Nvidia bertujuan untuk memitigasi risiko ini dengan tiga solusi yang ditargetkan:

Keamanan Konten NIM, yang dilatih berdasarkan Set Data Keamanan Konten Aegis, dirancang untuk mendeteksi dan memblokir yang tidak pantas atau berbahaya keluaran dari sistem AI. Kumpulan data ini, yang terdiri dari lebih dari 35.000 sampel yang dianotasi oleh manusia, memungkinkan model untuk mengidentifikasi dan merespons konten beracun secara efektif.

Terkait: NVIDIA Memajukan AI Agentik dengan Model Llama dan Cosmos Nemotron

Nvidia berencana membuat kumpulan data tersebut tersedia untuk umum melalui Hugging Face pada akhir tahun ini, memperluas jangkauannya aksesibilitas bagi pengembang dan peneliti.

Kontrol Topik NIM memastikan interaksi yang dihasilkan AI tetap berada dalam batasan yang ditentukan, mencegah sistem beralih ke topik yang tidak relevan atau tidak sah. Alat ini sangat berguna dalam skenario layanan pelanggan yang memerlukan respons yang konsisten dan relevan secara kontekstual.

Deteksi Jailbreak NIM mengatasi meningkatnya kekhawatiran akan serangan musuh. Dengan menganalisis masukan terhadap kumpulan data dari 17.000 upaya jailbreak yang diketahui, layanan mikro mengidentifikasi dan memblokir perintah berbahaya yang dirancang untuk mengesampingkan perlindungan sistem.

Diagram alur dari mengamankan asisten AI virtual cerdas untuk layanan pelanggan dengan NeMo Guardrails (Gambar: Nvidia)

Diagram alur dari mengamankan asisten AI virtual cerdas untuk layanan pelanggan dengan NeMo Guardrails (Gambar: Nvidia)

Briski menyoroti efisiensi alat-alat ini, dengan menyatakan, “Model kecil seperti yang ada di NeMo Pengumpulan pagar pembatas memberikan latensi yang lebih rendah, memungkinkan integrasi tanpa hambatan ke lingkungan dengan sumber daya terbatas seperti gudang atau rumah sakit.”

Menyeimbangkan Keamanan dan Kinerja AI

Aspek penting Salah satu pendekatan Nvidia adalah menyeimbangkan kebutuhan akan keamanan dengan permintaan akan kinerja tinggi. Nvidia mengatakan bahwa pengujian awal menunjukkan bagaimana layanan mikro baru hanya menambah latensi sekitar setengah detik sekaligus meningkatkan langkah-langkah keamanan sebesar 50%.

Terkait: NVIDIA Meluncurkan Model Fugatto AI Untuk Musik, Suara, dan Efek Suara

Tingkat pengoptimalan ini mengatasi salah satu permasalahan paling umum dalam AI perusahaan —memastikan waktu respons yang cepat tanpa mengorbankan keamanan.

“Bergantung pada interaksi pengguna, banyak LLM atau interaksi berbeda yang dapat dilakukan, dan Anda harus melindungi masing-masing interaksi tersebut,” kata Kari Briski.

Kasus Penggunaan Perusahaan dan Adopsi Industri

Beberapa perusahaan besar telah memasukkan Pagar Pembatas NeMo ke dalam alur kerja AI mereka untuk meningkatkan keselamatan dan keandalan. Misalnya, Lowe’s, pengecer perbaikan rumah, menggunakannya alat-alat ini untuk meningkatkan interaksi pelanggan dan memastikan keakuratan respons yang dihasilkan AI.

Cerence AI, pemimpin dalam AI otomotif, memanfaatkan layanan mikro untuk mendukung teknologi asisten dalam mobil Guardrails membantu kami memberikan respons yang tepercaya, penuh kewaspadaan, dan bebas halusinasi, sehingga mengamankan model kami dari keluaran yang berbahaya,”jelas Nils Schanz, Wakil Presiden Eksekutif Produk dan Teknologi di Cerence AI.

Terkait: Microsoft Memotong Pesanan Nvidia GB200, Memprioritaskan GB300 Di Tengah Keterlambatan Produksi

Selain itu, perusahaan seperti Amdocs dan Taskus memanfaatkan alat ini untuk menciptakan sistem AI yang lebih aman dan andal bagi pelanggan keterlibatan dan dukungan. Amdocs, penyedia perangkat lunak global untuk komunikasi dan media, menggunakan NeMo Guardrails untuk meningkatkan interaksi pelanggan berbasis AI.

Inisiatif Sumber Terbuka dan Implikasi yang Lebih Luas

Untuk mendukung pengembang dalam menguji dan meningkatkan keamanan AI, Nvidia telah memperkenalkan Garak, sebuah perangkat sumber terbuka untuk mengidentifikasi kerentanan dalam sistem AI.

Garak menyimulasikan skenario permusuhan, termasuk suntikan cepat dan upaya jailbreak, sehingga memungkinkan organisasi memperkuat model AI mereka terhadap potensi ancaman.

Pengembang juga dapat mengakses tutorial mendetail dan referensi cetak biru untuk menyederhanakan penerapan NeMo Guardrails dan layanan mikro. Resource ini mencakup berbagai kasus penggunaan, mulai dari chatbot layanan pelanggan hingga asisten otomatis di lingkungan retail dan layanan kesehatan.