Kevesebb, mint négy hónappal a videóra fókuszált Segment Anything Model 2 bemutatása után a Meta kiadta a SAM 3 és a SAM 3D modelleket, azonnal bevezetve a fejlett számítógépes látásmodelleket olyan fogyasztói termékekbe, mint a Facebook Marketplace és az Instagram.

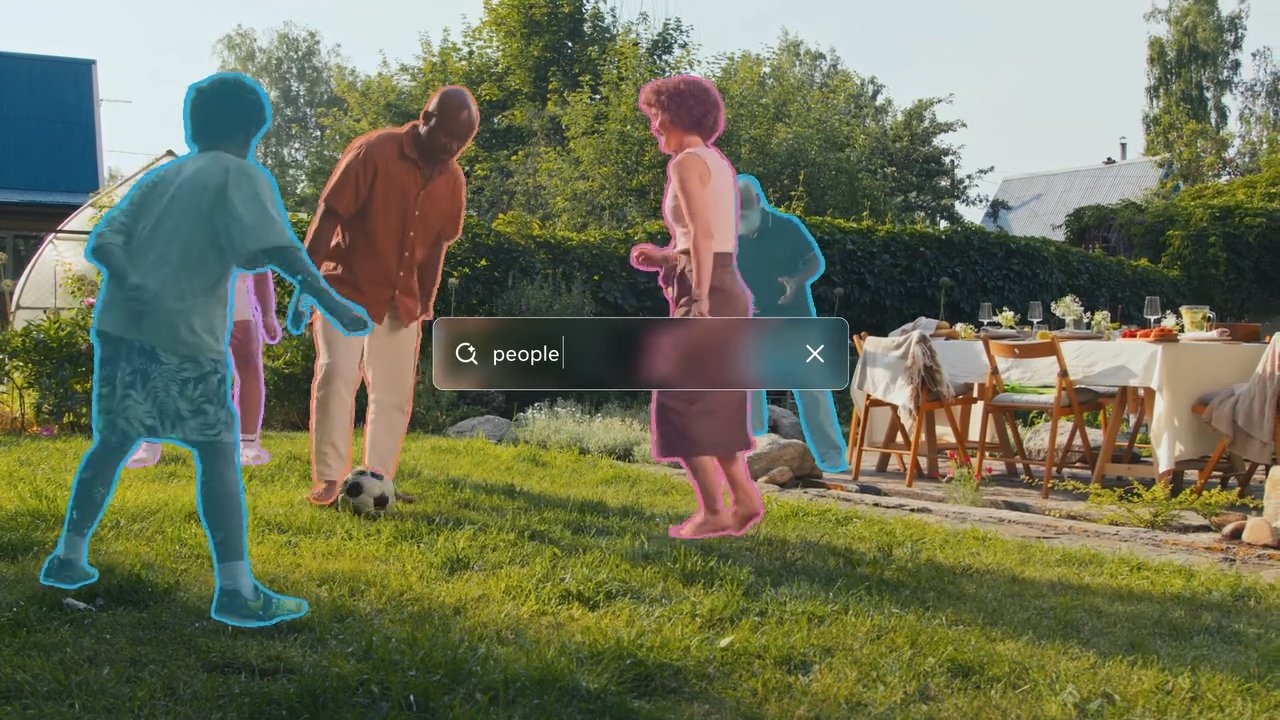

Mindkét eszköz segítségével a számítógépek sokkal jobban megértik, mit néznek. A SAM 3 lehetővé teszi a felhasználók számára, hogy leírást írjanak be, és a mesterséges intelligencia azonnal megtalálja és kiemelje az összes egyező objektumot egy fotón vagy videón.

A SAM 3D egy lépéssel tovább megy: lapos, kétdimenziós képet készít, és megjósolja, hogyan néz ki az objektum más szögekből, hatékonyan alakítva a szabványos fotót forgatható 3D-s modellné.

Míg a korábbi iterációk nagyrészt a kutatási tartományon belül maradtak, ez a frissítés gyors elmozdulást jelent az alkalmazott segédprogramok felé, olyan videofunkciókat biztosítva, amelyek lehetővé teszik a felhasználók számára, hogy effektusokat alkalmazzanak adott otthoni objektumaikban, vagy effektusokat alkalmazzanak

. „Promptable Concept Segmentation”, amely lehetővé teszi a jelenetben lévő összes egyező objektum szövegalapú azonosítását, és nagy pontosságú 3D-s rekonstrukciót egyetlen 2D-s képekből – a Meta állításai szerint ezek a lehetőségek nagymértékben felülmúlják a meglévő benchmarkokat.

A SAM 2 2024-es kiadása a hatékonyságot, de jelentős mértékben a videoszegmentáció széleskörű megértését is magában foglalja, de nagy hangsúlyt fektet a mai videószegmentálásra. és 3D-s generáció.

A kutatástól a termékig: Azonnali integráció

A hagyományos kutatástól a termékig terjedő ciklusból kilépve a Meta megkerüli a tipikus inkubációs fázist, hogy a SAM 3-at közvetlenül a zászlóshajó alkalmazásaiba integrálja.

A Facebook Marketplace felhasználói most lehetővé teszik, hogy a potenciális bútorok vásárlása hogyan nézzen meg a szobában. a saját életterükbe néznek, mielőtt elköteleznék magukat a vásárlás mellett.

Ez az alkalmazás kihasználja a modell azon képességét, hogy egyetlen 2D-s képekből 3D-s objektumokat tudjon rekonstruálni, ezzel megoldva az online kereskedelemben előforduló gyakori súrlódási pontokat.

Egyidejűleg az Instagram „Edits” applikációja és a MetaAM3 objektum precíz funkciója is használható. hatások. Az alkotók mostantól olyan módosításokat alkalmazhatnak, mint például a reflektorfény vagy a mozgási nyomvonal a videókockán belüli meghatározott témákon, olyan feladatokhoz, amelyek korábban bonyolult maszkolást igényeltek professzionális szerkesztőszoftverben.

Megtekintés szálakon

Ezen folyamatok automatizálásával a Meta célja a fejlett vizuális effektusok áruvá tétele, lehetővé téve a felhasználók számára a hozzáférést. A szélesebb körű kísérletezés során a vállalat elindította a „Segment Anything Playground” nevű web-alapú felületet, amely lehetővé teszi a nyilvánosság számára, hogy műszaki szakértelem nélkül tesztelje ezeket a modelleket.

A felhasználók képeket vagy videókat tölthetnek fel, és szöveges leírásokkal kérhetik a rendszert, hogy valós időben lássák a szegmentálási lehetőségeket. Ez a stratégia éles ellentétben áll a SAM 2 bevezetésével, amely elsősorban a számítógépes látáskutató közösség eszköze maradt.

A fogyasztói alkalmazásokba való azonnali bevezetés stratégiai irányt sugall a felhasználók megtartása és elköteleződése érdekében tett mesterséges intelligencia fejlesztéseinek kiaknázására a Meta társadalmi ökoszisztémájában.

Technikai ugrás: Concept3D3D href=”https://ai.meta.com/sam3″target=”_blank”>SAM 3 egy jelentős, „Promptable Concept Segmentation” (PCS) nevű képességet vezet be. Elődjeivel ellentétben, amelyek az egyedi objektumok szegmentálására összpontosítottak vizuális felszólítások, például kattintások vagy dobozok alapján, a SAM 3 képes azonosítani és elfedni a szöveggel leírt fogalom minden előfordulását.

Például, a felhasználó „piros baseball sapkával” kérheti a modellt, és az minden egyező elemet szegmentál a keretben. Ez az eltolódás megköveteli, hogy a modell szemantikai megértéssel és pontos lokalizációs képességekkel rendelkezzen.

Ennek eléréséhez az architektúra leválasztja a felismerést a lokalizációtól egy „jelenléti token” segítségével. Ez a mechanizmus először meghatározza, hogy létezik-e koncepció a kereten belül, mielőtt a modell megpróbálná szegmentálni, csökkentve a hamis pozitív eredményeket és javítva az általános észlelési pontosságot.

A Meta Research Team szerint „a SAM 3 megduplázza a meglévő rendszerek pontosságát mind a kép-, mind a videó PCS-ben, és javítja a korábbi SAM-képességeket a vizuális szegmentálási feladatoknál, miközben lehetővé teszi a modellek magas szintű kezelését a komplex szegmentálási feladatoknál.”

szabványos szegmentálási feladatokon.

A Meta Sam 3 Szegmentál bármit fogalmakkal

A 3D-generálásban a SAM 3D lehetővé teszi az objektumok és jelenetek rekonstrukcióját egyetlen 2D-s képből, amely feladat hagyományosan több pont-vagy mélységi adatot igényelt. A Meta azt állítja, hogy ez az új modell jelentősen felülmúlja a meglévő módszereket.

A Meta AI csapata megjegyzi, hogy „a személyes preferencia tesztek során legalább 5:1-es győzelmi arányt ér el más vezető modellekkel szemben”. Ez különösen fontos a kibővített valóságban és a játékokban, ahol kulcsfontosságú az eszközök gyors generálása.

Megtekintés szálakon

A Meta által kiadott teljesítménymutatók azt mutatják, hogy a SAM 3 rendkívül hatékony. A Meta Research Team azt is kijelenti, hogy”a SAM 3 30 ezredmásodperc alatt fut le egyetlen kép esetén, több mint 100 észlelt objektummal egy H200 GPU-n.”Ez a sebesség elengedhetetlen a fogyasztói eszközök valós idejű alkalmazásaihoz, ahol a késleltetés ronthatja a felhasználói élményt.

Az emberi rekonstrukcióhoz a SAM 3D Body egy új, nyílt forráskódú formátumot használ.

A „SAM 3D Body… egy új, nyílt forráskódú 3D hálóformátumot, a Meta Momentum Human Rig (MHR) nevű új, nyílt forráskódú 3D mesh formátumot hasznosítja, amely javítja a lágyszöveti struktúra értelmezhetőségét és szétválaszthatóságát.

Ez a szétválasztás valósághűbb és beállíthatóbb emberi modelleket tesz lehetővé, amelyek hatással lehetnek a virtuális avatarokra és az animációra.

E fejlesztések ellenére a modell nem korlátlan. A Meta AI csapata elismeri, hogy „a SAM 3 nehezen általánosítható a tartományon kívüli fogalmakra, például olyan speciális kifejezések azonosítására, amelyek tartományi ismereteket igényelnek, mint például a „vérlemezke”.

Ez arra utal, hogy bár a modell robusztus a gyakori objektumokhoz, finomhangolásra vagy további adatokra lehet szükség a hatékony specializált vagy ritka kategóriák kezeléséhez.

Da Összehasonlítás

A 3D-generálásban a SAM 3D lehetővé teszi az objektumok és jelenetek rekonstrukcióját egyetlen 2D-s képből, amely feladat hagyományosan több pont-vagy mélységi adatot igényelt. A Meta azt állítja, hogy ez az új modell jelentősen felülmúlja a meglévő módszereket.

Megtekintés szálakon

A hibrid adatmotor kihasználásával a Meta jelentősen skálázhatta képzési adatait. A vállalat kifejlesztett egy Llama-alapú „AI annotátorokat” használó rendszert a maszkok ellenőrzésére és a teljesség ellenőrzésére. Ez a feladat önmagában az emberek számára hihetetlenül lassú lenne.

Meta elmagyarázza, hogy „bizonyos feladatok AI annotátorokra való delegálásával – olyan modellekkel, amelyek megfelelnek vagy felülmúlják az emberi pontosságot – több mint kétszeresére növeljük az átviteli sebességet, mint az emberi felhasználású megközelítéssel.

adatkészlet, amely több mint 4 millió egyedi koncepciót és 52 millió maszkot tartalmaz, gazdag képzési talajt biztosítva az új modelleknek.

A modellek mellett a Meta kiadta a „Segment Anything with Concepts” (SA-Co) benchmarkot. Ez az adatkészlet 207 000 egyedi koncepciót tartalmaz, amelyek a nyílt szókincs felismerési képességeinek tesztelésére szolgálnak, és az iparági szabványt kényszerítik kiértékelésre.

Az adatmotor iteratív módon bányászza a „kemény negatívumokat” – olyan kifejezéseket, amelyek nem léteznek egy képen, de ellentétesek a modellel –, hogy javítsa a robusztusságot a hamis pozitív eredményekkel szemben. A Conservation X Labs-szal kötött partnerség a SAM 3-at alkalmazta a SA-FARI adatkészletben, ami videoszegmentáción keresztül segíti a vadon élő állatok automatikus megfigyelését. Ez a használati eset bemutatja a modell potenciális hasznosságát nagy mennyiségű, nem kurátoros videóadat kutatási célú feldolgozásában.

A kiadás modellsúlyokat, kódokat és kiértékelési adatkészleteket tartalmaz, folytatva a Meta nyílt forráskódú kulcsfontosságú AI-technológiáira vonatkozó stratégiáját. Ezen eszközök elérhetővé tételével a Meta célja, hogy iparági szabványokat állítson fel, és ösztönözze a további fejlődést az AI-közösségen belül.

A jövőbeni munka a modell azon képességének javítására fog összpontosítani, hogy képes legyen kezelni az összetett érvelési lekérdezéseket a SAM 3 és a multimodális nagynyelvi modellek (MLLM) kombinálásával, ami még kifinomultabb interakciókat tesz lehetővé.