Az OpenAI csütörtökön kiadta a „Teen Safety Blueprint”-et, egy új keretrendszert, amelyet a fiatal mesterségesintelligencia-felhasználók védelmére terveztek.

A lépés közvetlen válasz a San Francisco-i cégre nehezedő heves jogi és kormányzati nyomásra. Az OpenAI a Szövetségi Kereskedelmi Bizottság vizsgálata, az új kaliforniai chatbot-törvény, valamint a ChatGPT eszközét a tinédzserek önkárosításával összekapcsoló perek irányításával foglalkozik.

A válság megelőzésére a vállalat öt alapvető biztonsági elvet javasol. Ide tartozik a jobb életkor-felismerés és a kiskorúak alapértelmezett védelme. Az OpenAI reméli, hogy ez a proaktív terv alakítja a jövőbeli iparági szabályokat, és választ ad a növekvő biztonsági aggályokra.

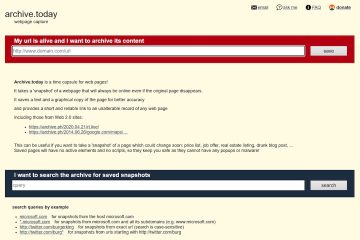

Ötpontos terv az Az AI biztonsági normájának kialakításáhozA biztonság href=”https://cdn.openai.com/pdf/OAI%20Teen%20Safety%20Blueprint.pdf”target=”_blank”>terv az az öt alapelv, amelyet az OpenAI szerint minden mesterséges intelligenciával foglalkozó vállalatnak el kell fogadnia.

A vállalat a dokumentumot nem csak belső szabályzatként, hanem új szabályozások kidolgozásának kiindulópontjaként pozicionálja. Először is a tinédzserek azonosítását kéri a platformokon „adatvédelmi, kockázatalapú életkorbecslési eszközök” segítségével, hogy különálló, életkoruknak megfelelő élményt nyújtsanak.

Amint a vállalat kijelenti: „Úgy gondoljuk, hogy a ChatGPT-nek ott kell találkoznia velük, ahol vannak: ahogy a ChatGPT reagál egy 15 éves gyerekre, el kell térnie attól, ahogyan a felnőttek igényeire reagálnak. irányelvek a 18 éven aluli felhasználók kockázatainak mérséklésére. A terv szerint az AI-rendszereket úgy kell megtervezni, hogy ne ábrázoljanak öngyilkosságot vagy önsértést, és „tilniuk kell a grafikus vagy magával ragadó (azaz szerepjátékos) intim és erőszakos tartalmakat”.

Az irányelvek célja az is, hogy az AI megakadályozza, hogy a mesterséges intelligencia korlátozza az ideális értékeléseket, a „káros testre szabott viselkedést és viselkedést” coaching.”

Harmadszor, az OpenAI a biztonságos U18-as élmény alapértelmezett beállítását támogatja, ha a felhasználó életkora kétséges, különösen a nem hitelesített felhasználók esetében. Ez előtérbe helyezi a biztonságot, még akkor is, ha ez akadályozza a felnőttek ingyenes termék használatát.

Negyedszer, a terv hangsúlyozza, hogy a családokat hozzáférhető szülői felügyelettel kell felruházni, a vállalat által nemrégiben bevezetett funkciókra építve. Ezek a vezérlők lehetővé teszik a gyámok számára, hogy összekapcsolják a fiókokat, beállítsák a „kikapcsolási órákat”, kezeljék az adatvédelmi beállításokat, és figyelmeztetéseket kapjanak, ha egy tinédzser tevékenysége önkárosító szándékra utal.

Végül a mentálhigiénés kutatások eredményeinek beágyazásával a jólétet kell tervezni. Az OpenAI dokumentuma ezt a prioritások alapvető változásaként fogalmazza meg.”A tizenévesek számára a biztonságot a magánélet és a szabadság előtt helyezzük előtérbe. Ez egy új és hatékony technológia, és úgy gondoljuk, hogy a kiskorúaknak jelentős védelemre van szükségük.”

Proaktív lépés a szabályozási és jogi ostrom közepette

A jogi és szabályozási ellenőrzés hullámvölgyével szembesülve, az OpenAI egyértelmű kísérlete a narratíva megtervezésére. A cég jelenleg védekezik egy nagy horderejű jogtalan haláleseti per ellen, amelyet egy öngyilkos tinédzser szülei indítottak.

A tinédzser apja, Matthew Raine erőteljes megrovásban részesítette: „Szülőként el sem tudod képzelni, milyen lehet egy beszélgetést olvasni egy chatbottal, amely felkészítette a gyermekedre, és a cég a nyilvánosság elé állította a társaságot.” biztonsági gyakorlatok mikroszkóp alatt.

A kormányzati nyomás több irányból is fokozódik. Szeptemberben az Egyesült Államok Szövetségi Kereskedelmi Bizottsága komoly vizsgálatot indított a mesterséges intelligencia kísérő chatbotjainak a tinédzserekre gyakorolt hatásával kapcsolatban, az OpenAI-t és hat másik technológiai óriást célozva meg.

Andrew N. Ferguson, az FTC elnöke kiegyensúlyozó intézkedésként jellemezte a vizsgálatot: „A gyerekek online védelme a mi innovációs szektorunk legfontosabb prioritása, ezért a Trump-Vance kritikus fontosságú az FTC-ben és a Trump-Vance-ben. gazdaság.”

Az állami és a szövetségi törvényhozók is agresszíven mozognak. Kaliforniában Gavin Newsom kormányzó aláírta az október 243-i S-törvényt. az AI chatbotokra vonatkozó országon belüli első szabályok.

A törvény előírja, hogy az üzemeltetők ismétlődő figyelmeztetéseket adjanak, amelyek emlékeztetik a kiskorúakat, hogy mesterséges intelligenciával beszélnek, blokkolják a veszélyes tartalmat, és magánjogot biztosítanak a családok számára, hogy beperelhessék a nem megfelelő fejlesztőket.

A törvényjavaslat szerzője, Steve Padilla szenátor nem bízhat meg a rendőrségen, és korábban Steve Padillában nem bízták meg a rendőrséget. magukat.”Szövetségi szinten az egyesült államokbeli szenátorok kétpárti csoportja bevezette a GUARD-törvényt, október végén még tovább terjeszti a törvényjavaslatot. a kiskorúak mesterséges intelligencia-kísérőinek teljes betiltása, és új büntetőjogi felelősségre vonás azon vállalatok számára, amelyek mesterséges intelligencia tiltott tartalmat állít elő kiskorú felhasználók számára.

Tervrajzában az OpenAI visszalép a tétlenség narratívája ellen, kiemelve meglévő biztonsági intézkedéseit. A cég megjegyezte, hogy csak 2025 első felében több mint 75 000 kibertippről számolt be a hatóságoknak mesterséges intelligencia által generált gyermekek szexuális zaklatását tartalmazó anyagokról.

Police Conversial with aMoverral. Álláspont

Mivel azonban az OpenAI vezető szerepet tölt be a tizenévesek biztonsága terén, meg kell küzdenie saját, egymásnak ellentmondó nyilvános nyilatkozataival és irányelveivel is. Ez a biztonságos üzenetküldés éles ellentétben áll a vállalat közelmúltbeli politikai változásaival.

A múlt hónapban Sam Altman vezérigazgató megvédte azt a vitatott döntést, amely engedélyezi a korhatáros erotikus tartalmat a ChatGPT-n. Visszaszorította a kritikát azzal, hogy kijelentette: „nem mi vagyunk a világ választott erkölcsi rendõrsége”. A lépés, amely aggodalmat keltett az olyan számadatokban, mint Mark Cuban, ellentmondó prioritások felfogását váltotta ki a vállalaton belül.

A Teen Safety Blueprint a legfrissebbnek tekinthető azon gyorstüzelős kezdeményezések sorában, amelyek célja a biztonság iránti elkötelezettség demonstrálása. Szeptember végén a vállalat bevezette szülői felügyeleti csomagját.

Csak két héttel később bejelentette egy nyolctagú szakértői tanács megalakulását, amely a jóléttel és a mentális egészséggel kapcsolatos tanácsokat ad.

Ezek a kihívások nem csak az OpenAI-ra jellemzőek, hanem egy tágabb, az egész iparágra kiterjedő számítást tükröznek. Az olyan versenytársak, mint a Meta, saját jogi válsággal néznek szembe a tizenévesek biztonsága miatt. Egy DC-bíróság a közelmúltban hivatkozott a ritka bűncselekmény-csalás kivételére, hogy kimondja, hogy a Meta nem rejtheti el a belső tinédzserkár-kutatást az ügyvéd-ügyfél kiváltsága mögé.

A bíróság bizonyítékokat talált arra vonatkozóan, hogy az ügyvédek azt tanácsolták a kutatóknak, hogy módosítsák a megállapításokat a felelősség korlátozása érdekében, igazolva a bejelentők „valószínű tagadhatósági” stratégiáját. Tervének közzétételével az OpenAI stratégiai játékot hajt végre a mesterséges intelligencia biztonságának meghatározására, abban a reményben, hogy a szabályokat még azelőtt formálhatja, mielőtt a szabályozó hatóságok és bíróságok szigorúbbakat szabnának ki.