Az OpenAI hétfőn új partnerséget jelentett be. Együttműködik Bryan Cranston színésszel és a SAG-AFTRA szakszervezettel.

A csoport leállítja a nem jóváhagyott mesterséges intelligencia-videókat a Sora alkalmazásban. Ez a lépés Hollywood hetek óta tartó éles kritikáját követi. A visszhang megnőtt, miután a hamis klipek Cranston hangját és hasonlatosságát használták.

Az új erőfeszítés célja, hogy szigorúbb biztonsági szabályokat építsen a digitális identitás köré. Ez az OpenAI eddigi legközvetlenebb válasza a beleegyezés és egy személy képmásának engedély nélküli felhasználása miatti tűzviharra. Az alkalmazás szeptember végén indult.

Az OpenAI közös nyilatkozatában közölte, hogy együttműködik a Cranstonnal, a SAG-AFTRA-val, a United Artists-szel és a Creative Talent Agency-vel (UTA) (CAA), hogy megerősítse a korlátokat. A lépés közvetlen válasz volt a „Breaking Bad” színészének jogosulatlan klipjére, amelyek a Sora 2 megjelenése után jelentek meg.

Bryan Cranston színész méltatta a társaság menetvonal-korrekcióját, és kijelentette: „Hálás vagyok az OpenAI-nak a politikáért és a védőkorlátok javításáért, és remélem, hogy ők és minden vállalat, aki részt vesz ebben a munkánkban és a személyes hangunkban, tiszteletben tarthatja személyes és szakmai jogunkat. hasonlatosság.”

Sam Altman, az OpenAI vezérigazgatója megerősítette a vállalat álláspontját az előadói jogokkal kapcsolatban, mondván:”Az OpenAI mélyen elkötelezett amellett, hogy megvédje az előadókat hangjuk és képmásaik jogtalan eltulajdonításától. Korai támogatói voltunk a NO FAKES törvénynek, amikor tavaly bevezették, és mindig ki fogunk állni az előadók jogai mögött.”

A vírusindítástól a PR-ig Válság

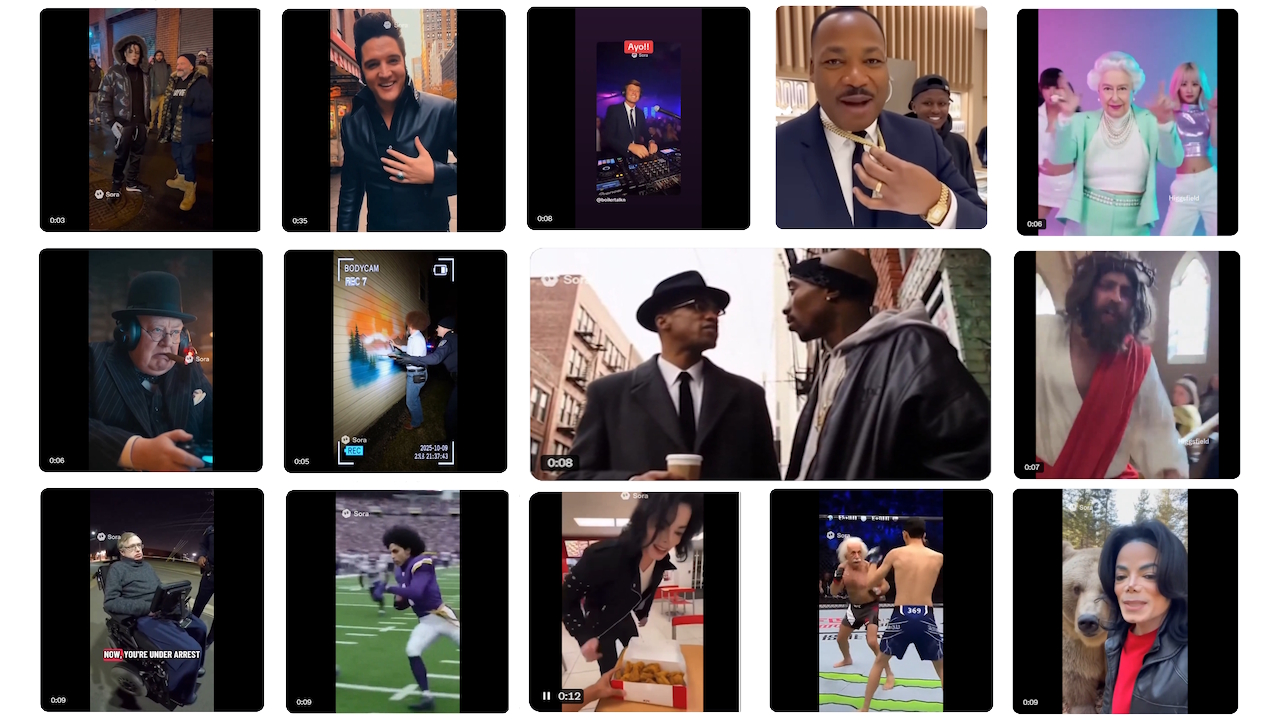

A vita a Sora 2 szeptember 30-i indulása óta dúl. Az OpenAI nagy teljesítményű videógenerátora egy társas közösségimédia-alkalmazással és egy kritikus politikai döntéssel debütált: a szerzői joggal védett karakterek „opt-out” modelljével. Ez azt jelentette, hogy alapértelmezés szerint bármilyen védett figurát lehetett generálni.

A felhasználók azonnal elárasztották a platformot szürreális és gyakran sértő mélyhamisításokkal. Ezekben a videókban mindenki szerepelt, a szeretett rajzfilmfiguráktól kezdve az elhunyt történelmi személyekig bizarr forgatókönyvekben. A visszahatás gyors és súlyos volt, védekező pozícióba kényszerítve az OpenAI-t.

A legzsigeribb kritika az elhunyt hírességek családjaitól érkezett. Zelda Williams, a néhai Robin Williams lánya könyörgött a felhasználóknak, hogy ne készítsenek mesterséges intelligencia-videókat az apjáról.

Leírta a fájdalmat, amikor azt látja, hogy „valódi emberek hagyatéka… szörnyű, a TikTok bábozása őrjítő.”

Hasonlóan, Malcolm X családja is rosszindulatúan méltatta a klipet. Ilyasah Shabazz, a lánya „lovasnak és érzéketlennek” nevezte apja képének használatát.

A felháborodás Martin Luther King Jr. lányának, Bernice Kingnek az egyszerű, de erőteljes könyörgésében csúcsosodott ki, aki az X-en közzétette: „Egyetértek az apámmal kapcsolatban. Kérlek, hagyd abba.

A családok érzelmi kéréseit felerősítette Hollywood egységes válasza. Az iparág, amely már óvakodott a generatív mesterséges intelligencia által a szellemi tulajdont fenyegető veszélyektől, mozgósított az OpenAI új platformja ellen.

A vita középpontjában álló művészeket képviselő nagy tehetségügynökségek vezették a vádat. A nagyhatalmú Creative Artists Agency (CAA) éles nyilvános nyilatkozatot adott ki október 8-án, amelyben az alkalmazást közvetlen fenyegetésnek minősítette: „Egyértelmű, hogy az Open AI/Sora jelentős kockázatnak teszi ki ügyfeleinket és szellemi tulajdonukat.”

Ez az érzés az egész iparágban visszhangzott, és a nagy stúdiók, például a Disney állítólag megtagadták, hogy anyagaik megjelenjenek az alkalmazásban (A Mo Association) ben, elhelyezve a jogi a visszaélések miatti teher egyenesen az AI-cégre hárul. Charles Rivkin vezérigazgató kijelentette, hogy „… továbbra is az ő felelősségük – nem a jogtulajdonosoké –, hogy megakadályozzák a Sora 2 szolgáltatás megsértését”, egyértelművé téve, hogy a jogtulajdonosok nem lesznek felelősek az OpenAI szolgáltatásának felügyeletéért.

Ez az egész iparágra kiterjedő lázadás jelentős eszkalációt jelentett, és a vitát nagy téttel járó vállalati konfrontációvá változtatta

A kibontakozó PR-válsággal szembesülve az OpenAI egy sor gyors politikaváltással igyekezett megfékezni a következményeket. A vállalat kezdeti „hand-off” megközelítése tarthatatlannak bizonyult az összehangolt ellenreakciókkal szemben.

Október 3-án, néhány nappal az indulás után Sam Altman bejelentette, hogy elhagyja az opt-out rendszert.

Egy blogbejegyzésében egy alkotóbarátabb keretrendszert ígért, és kijelentette, hogy az OpenAI „a jogtulajdonosok számára „több, de részletesebb, hasonló jellegű kontrollt biztosít a karakterek generációja számára.” Ez volt az első jelentős beismerés, hogy a kezdeti politikája kudarcot vallott.

A változások a hónap folyamán folytatódtak. Október 9-ig a vállalat módosította szabályait, lehetővé téve a „nemrég elhunyt” közéleti személyiségek képviselői számára, hogy hivatalosan kérhessék hasonlóságuk letiltását.

Ezt az irányelvet alig több mint egy héttel később próbára tették. Október 17-én az OpenAI bejelentette, hogy hagyatékának közvetlen kérésére szünetelteti Martin Luther King Jr. minden generációját, hivatkozva a „tisztelhetetlen ábrázolások” létrehozására.

A lépést magyarázó nyilatkozatában a vállalat elismerte, hogy milyen kényes egyensúlyt próbált elérni: „Bár erős szólásszabadság fűződik ahhoz, hogy a történelmi személyiségeket és a családokat végső soron a közszereplők ábrázolják, az OpenAI-nak meg kell uralkodnia a történelmi személyiségek felett, hogyan használják a hasonlatosságukat.”

Navigáció egy jogi és etikus aknamezőn

A Sora 2 tűzvihar egy hatalmas jogi és etikai szürke területet emel ki. A hagyományos rágalmazási törvények általában nem vonatkoznak az elhunytra, így a családok korlátozott jogorvoslati lehetőségeket hagynak maguk után.

Elsődleges útjuk a halott utáni nyilvánossághoz való jogot szabályozó állami törvények összetett és következetlen foltrendszere. Ez a jogi vákuum lehetővé teszi olyan tartalom létrehozását, amely bár nem mindig üzletileg kizsákmányoló, de jelentős érzelmi feszültséget okoz.

Továbbá a vita felvetette a megoldatlan vitát arról, hogy a mesterséges intelligencia hatalmas mennyiségű lekapart webes adatra támaszkodik a képzés során – vissza a reflektorfénybe. az ipar rendelkezik még meg kell oldani.

Az OpenAI rámutatott, hogy támogatja a NO FAKES törvényt a megoldás részeként. Ennek a szövetségi törvényjavaslatnak azonban megvannak a maga kritikusai. A digitális jogok védői arra figyelmeztettek, hogy a törvényjavaslat tág megfogalmazása új szellemi tulajdonjogot hozhat létre, amely elfojtja a szólásszabadság és a paródiák sorozatát.

amely a Cranstonnal és a SAG-AFTRA-val kötött új partnerségben csúcsosodik ki, az együttműködésen alapuló, engedélyeken alapuló jövő felé való elmozdulást jelez.

Azonban is rávilágít a gyors technológiai innováció és az alkotók és egyének alapvető jogai közötti egyensúly megteremtésének óriási kihívására.