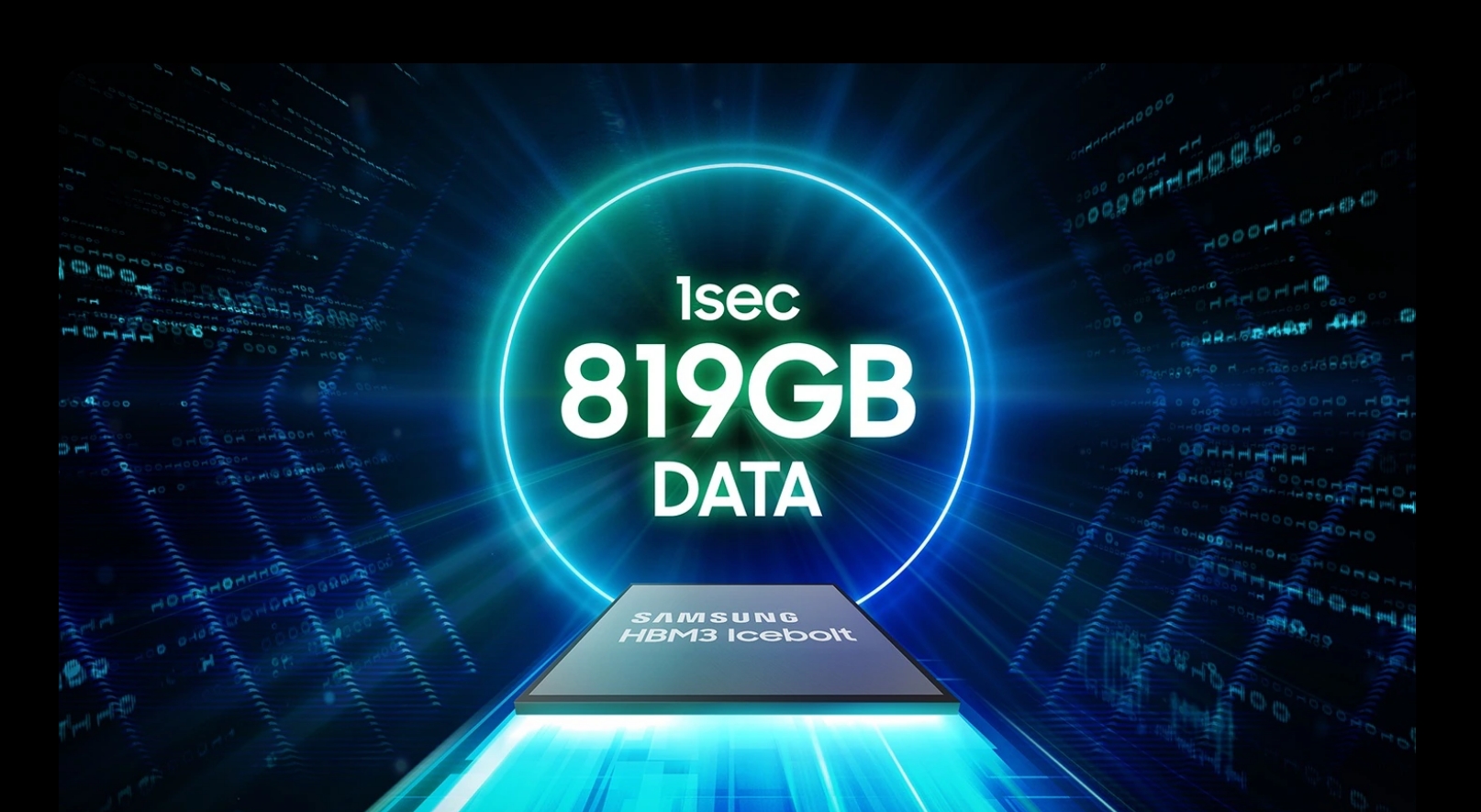

A Samsung HBM3 DRAM chipjei, amelyeket az Nvidia AI-gyorsítóiban való használatra terveztek, teljesítményproblémákba ütköztek tesztelés. Az elsődleges aggodalmak a túlzott hőtermelés és a magas energiafogyasztás körül forognak, ami kétségeket ébreszt az Nvidia nagy teljesítményű számítástechnikai igényeinek megfelelőségével kapcsolatban. A HBM a High Bandwidth Memory (nagy sávszélességű memória) rövidítése, olyan chip-kialakítással, amely nagyobb sávszélességet biztosít, mint a DDR4 vagy GDDR5 modulok, miközben kevesebb energiát fogyaszt, és lényegesen kisebb méretű. Ez legfeljebb nyolc DRAM alapfejek és egy opcionális alapbetét, amely tartalmazhat pufferáramkört és tesztlogikát.

Hő-és energiafogyasztási aggályok

A bejelentett hő-és energiafogyasztási problémák nem korlátozódnak kizárólag a HBM3 chipekre. A Samsung néhány hónapja bemutatott HBM3E chipjei is hasonló problémákkal küzdenek. Ezek a problémák nyilvánvalóvá váltak, amikor 2024 áprilisában kiadták a Samsung 8 és 12 rétegű HBM3E lapkáinak eredményeit.

Ezzel szemben az SK Hynix 2024 márciusában elkezdte HBM3E chipek szállítását az Nvidiának kulcsszereplő a HBM piacon. Az SK Hynix jelenleg az Nvidia legnagyobb HBM chip-szállítója, amelyek elengedhetetlenek az AI-gyorsítók működéséhez. Az Nvidia dominanciája a mesterséges intelligencia piacán, 80%-os részesedéssel, minden HBM chipgyártó számára kulcsfontosságúvá teszi tanúsítását.

A Samsung optimalizálási erőfeszítései

A Samsung felismerte, hogy az optimalizálásra van szükség az ügyfelek igényeivel párhuzamosan. A vállalat szorosan együttműködik az ügyfelekkel, hogy megoldja ezeket a problémákat, és több mint egy éve arra törekszik, hogy megfeleljen az Nvidia szigorú tesztjein. A Samsung közelmúltbeli vezetői változásai, beleértve a DRAM és NAND flash fejlesztés korábbi szakértőjének kinevezését, alátámasztják elkötelezettségét e kihívások megoldása iránt.

Az Nvidia tanúsítása létfontosságú a Samsung HBM-piaci törekvései szempontjából. A megoldatlan hő-és áramfogyasztási problémák árnyékot vetnek a Samsung kilátásaira. Továbbra is bizonytalan, hogy ezek a problémák azonnal kezelhetők-e. Az Nvidia vezérigazgatójának, Jensen Huangnak a Samsung HBM3E 12H (12 rétegű) memóriachipjének támogatása a GTX AI 2024 konferencián, ahol a „Jensen jóváhagyva” feliratot írta a chipre, rávilágít ennek a partnerségnek a fontosságára.

A Samsung azon képessége, hogy leküzdje ezeket a kihívásokat, nem csak az üzleti tevékenysége, hanem a szélesebb iparág számára is kritikus fontosságú Az AMD és az Nvidia is nagyon szeretné megoldani ezeket a problémákat, hogy több gyártótól is biztosíthassa a HBM chipek stabil ellátását, ami segíti az árak versenyképességét. A Samsung már szállít HBM chipeket az AMD-nek, ezzel is hangsúlyozva a megbízható és hatékony memóriamegoldások szükségességét.

A Samsung célja a HBM3E chipek tömeggyártásának megkezdése az év második negyedéve előtt A HBM chipek optimalizálására tett erőfeszítései az ügyfelekkel együttműködve tükrözik az eltökélt szándékot, hogy megvessék a lábukat a versenyképes mesterségesintelligencia-hardverpiacon. Ezek az erőfeszítések jelentősen befolyásolják a mesterséges intelligenciagyorsítók és a nagy teljesítményű számítástechnika jövőbeli környezetét.