TL;DR

L’essentiel : Google teste une interface”Search Live”qui affiche des cartes de citation visuelles en temps réel lors des réponses vocales conversationnelles. Détails clés : optimisée par Gemini 3, la fonctionnalité fait apparaître les liens sources pendant que l’IA parle pour permettre une vérification immédiate des affirmations. Pourquoi c’est important : cette mise à jour vise à combler le « écart de confiance » causé par les hallucinations de l’IA et répond aux préoccupations des éditeurs concernant le trafic sans clic.

Pour combler le fossé entre la recherche vocale conversationnelle et l’attribution Web, Google teste une nouvelle interface qui superpose des cartes de citation visuelles lors des réponses orales en temps réel. La fonctionnalité expérimentale, repérée dans le mode IA de l’entreprise, vise à atténuer la nature de « boîte noire » des interactions audio.

En faisant apparaître les liens sources pendant que l’IA parle, la mise à jour répond aux critiques persistantes concernant les « hallucinations », où les modèles inventent des faits, et l’érosion du trafic des éditeurs. Elle intègre les capacités conversationnelles de Gemini Live directement dans le produit de recherche principal.

Comment fonctionne la nouvelle interface vocale

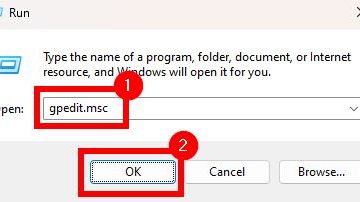

Repérée par l’expert SEO Sachin Patel lors d’un test A/B, la mise à jour intègre Search Live. directement dans la bascule du mode IA standard trouvée dans l’application Google.

Contrairement aux assistants vocaux précédents qui fonctionnent souvent comme des « boîtes noires » opaques, cette interface génère des cartes de citation visuelles en temps réel. Pendant que l’IA raconte une réponse, des liens sources pertinents apparaissent à l’écran, permettant aux utilisateurs de vérifier immédiatement des affirmations spécifiques.

Est-ce nouveau en mode Ai (ma requête est : qu’est-ce qu’il y a de référencement dessus) @brodieseo @rustybrick @gaganghotra_ pic.twitter.com/3N5hXtKmdm

— Sachin Patel (@SachuPatel53124) 6 décembre 2025

Sous le capot, le système exploite les capacités multimodales de l’intégration Gemini 3 récemment déployée. Cette mise à niveau du modèle a été conçue pour gérer des requêtes complexes en plusieurs étapes qui nécessitent la synthèse d’informations provenant de sources disparates.

Promo

Les dirigeants ont noté un changement dans la façon dont les utilisateurs interagissent avec ces modèles plus performants. Comme l’a précédemment souligné Hema Budaraju, directeur principal des produits chez Google,”avec le mode IA, nous voyons déjà des gens approfondir des sujets complexes et poser des questions près de trois fois plus longtemps que les recherches traditionnelles.”

Le déplacement de cette fonctionnalité de l’application Gemini autonome vers l’environnement de recherche à fort trafic marque un changement stratégique majeur. Il tente de normaliser l’IA conversationnelle en tant que méthode de recherche principale plutôt qu’en tant que nouveauté.

L’écart de confiance : atténuer les hallucinations

La recherche vocale a toujours souffert d’un manque d’attribution claire. Les utilisateurs reçoivent généralement une réponse synthétisée sans savoir d’où proviennent les informations, ce qui rend la vérification difficile.

Stratégiquement, l’intégration fait suite au lancement du moteur de raisonnement Deep Think de Google. Cette architecture permet au modèle de faire une pause et de raisonner avant de répondre, une capacité décrite par Demis Hassabis, PDG de Google DeepMind, comme « le modèle le plus avancé de Google pour les tâches complexes » qui peut « comprendre de vastes ensembles de données, posant des problèmes provenant de différentes sources d’informations. »

Malgré ces progrès, la fiabilité reste un obstacle majeur à une adoption généralisée. Des recherches indépendantes suggèrent que les résultats de recherche générative s’écartent souvent considérablement des classements traditionnels.

Une étude de fiabilité récente a quantifié cet écart, révélant que 53 % des sites Web liés par l’IA de Google n’apparaissaient pas dans les 10 premiers résultats d’une recherche conventionnelle. Cela indique une divergence significative par rapport aux signaux de classement établis par la recherche traditionnelle.

Ces résultats mettent en évidence le « fossé de confiance » que les cartes visuelles visent à combler. En affichant les sources spécifiques utilisées pour générer une réponse, Google tente de prouver que son IA fonde ses réponses sur du contenu Web réel plutôt que d’inventer des faits.

Trafic contre réponses

Pour les entreprises de médias, le passage à la recherche vocale « agentique » représente une menace potentielle pour le trafic de référence. Les éditeurs craignent que les réponses vocales complètes éliminent le besoin de cliquer, même si une carte de citation est visible.

Les plateformes contrecarrent ce récit en tentant de redéfinir la valeur d’une interaction de recherche. Ils affirment que même si le volume peut baisser, l’intention du trafic restant est plus élevée.

Microsoft a été particulièrement bruyant à propos de ce changement de métrique. Fabrice Canel, chef de produit principal chez Bing, a fait valoir que”pour les spécialistes du marketing, la visibilité elle-même devient une forme de monnaie. Si vous définissez vos préférences avant qu’un clic n’ait lieu.”

Microsoft et Google ont publié des données affirmant que les taux de conversion revendiqués par les références de l’IA sont jusqu’à 3 fois plus élevés que le trafic de recherche traditionnel.

Les responsables des médias ne restent pas convaincus par cette défense de « la qualité plutôt que la quantité ». Beaucoup considèrent la récupération de leurs données pour la formation en IA comme une violation fondamentale de l’échange de valeurs sur le Web.