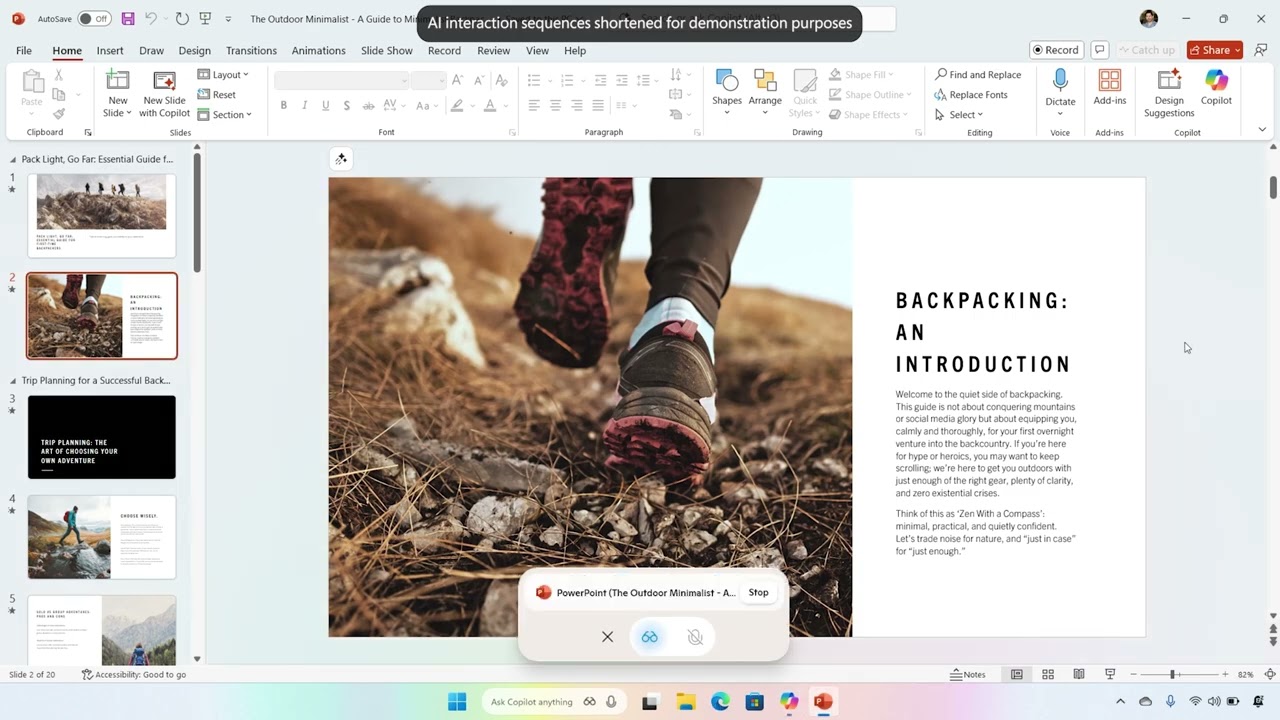

À peine un mois après avoir présenté Copilot Actions comme pièce maîtresse de sa stratégie « AI PC », Microsoft a admis de manière alarmante que la technologie introduisait de « nouveaux risques de sécurité » capables de compromettre des systèmes entiers.

Dans une mise à jour discrète pour prendre en charge la documentation accompagnant le déploiement de la fonctionnalité Insider, la société a averti que les attaquants peuvent exploiter ces agents via Cross-Prompt Injection (XPIA) pour exfiltrer des données ou installer des logiciels malveillants. La divulgation transfère effectivement la responsabilité aux utilisateurs, suscitant des critiques immédiates de la part des chercheurs en sécurité qui comparent la vulnérabilité aux macros Office non sécurisées.

Après notre couverture des actions Copilot initialement annoncées en octobre, dans lesquelles Microsoft avait promis un « déverrouillage magique » transparent pour la productivité, la réalité de la mise en œuvre s’est avérée beaucoup plus complexe.

Alors que la société continue de commercialiser le « AI PC » en tant que partenaire sécurisé, la documentation récemment mise à jour révèle des mises en garde importantes qui étaient absentes du blitz marketing initial.

Un aveu discret de « nouveaux risques de sécurité »

Enfoui dans la documentation de support mise à jour accompagnant le déploiement du 17 novembre auprès de Windows Insiders se trouve un avertissement qui modifie fondamentalement le profil de risque lié à l’utilisation IA agentique.

Microsoft a explicitement reconnu que « les applications d’IA agentique introduisent de nouveaux risques de sécurité, tels que l’injection d’invites croisées (XPIA), où le contenu malveillant intégré dans des éléments ou des documents de l’interface utilisateur peut remplacer les instructions de l’agent, conduisant à des actions involontaires comme l’exfiltration de données ou l’installation de logiciels malveillants. »

Cette vulnérabilité, connue sous le nom d’injection d’invites croisées (XPIA), permet aux attaquants de cacher des instructions malveillantes dans les sites Web, les documents ou les e-mails traités par l’agent IA. Étant donné que l’agent est conçu pour agir au nom de l’utilisateur, il peut être amené à exécuter des commandes que l’utilisateur n’a jamais autorisées.

Au-delà de la menace de manipulation externe, la documentation admet également que les modèles eux-mêmes restent sujets aux erreurs.

Microsoft note que « les modèles d’IA sont toujours confrontés à des limitations fonctionnelles en termes de comportement et peuvent parfois halluciner et produire des résultats inattendus. » Ces « limitations fonctionnelles » signifient que même sans interférence malveillante, l’agent peut mal interpréter une commande ou halluciner une tâche, supprimant potentiellement des fichiers ou envoyant des e-mails par erreur.

Et surtout, Microsoft a défini ces risques comme la responsabilité de l’utilisateur. Conseillant aux clients de procéder avec prudence, la page d’assistance suggère d’activer la fonctionnalité uniquement « si vous comprenez les implications de sécurité décrites sur cette page ».

En plaçant la responsabilité sur l’utilisateur de « comprendre » les vecteurs d’attaque complexes comme XPIA, la société semble se protéger de manière préventive de toute responsabilité si ces fonctionnalités expérimentales conduisaient à des violations de données ou à des compromissions du système.

‘Macros sur Marvel Superhero Crack’

En écho Face aux cauchemars de sécurité qui ont tourmenté les versions précédentes d’Office, les experts n’ont pas tardé à critiquer le modèle de défense « opt-in ».

Pendant des décennies, les macros Office ont servi de principal vecteur d’infection par des logiciels malveillants, car les utilisateurs, motivés par leurs besoins de productivité, les activaient malgré les avertissements de sécurité.

Kevin Beaumont, un éminent chercheur en sécurité, a établi un parallèle direct avec cette histoire, déclarant que la nouvelle fonctionnalité est une « macro sur le crack du super-héros Marvel ».

Les critiques soutiennent que le « contrôle » promis par Microsoft est largement illusoire pour l’utilisateur moyen. Détecter une attaque XPIA en temps réel est techniquement impossible pour la plupart des gens, car l’invite malveillante est souvent invisible à l’œil humain mais parfaitement lisible par l’IA.

Guillaume Rossolini, un autre chercheur en sécurité, a souligné la futilité de demander aux utilisateurs de contrôler ces interactions, notant“Je ne vois pas comment les utilisateurs pourraient empêcher quoi que ce soit de ce genre auquel ils font référence, à part ne pas surfer sur le Web, je suppose.”

Reed Mideke a qualifié l’avertissement de rien de plus qu’une manœuvre légale. Il a fait valoir que l’industrie ne dispose pas d’une solution technique permettant une injection rapide.”La solution ? Transférer la responsabilité vers l’utilisateur”, a écrit Mideke, notant,”peu importe que vous n’auriez pas besoin du chatbot en premier lieu si vous connaissiez la réponse.”

Ce scepticisme reflète une préoccupation plus large dans la communauté de la sécurité selon laquelle”l’agent”les fonctionnalités sont mises sur le marché avant que les vulnérabilités fondamentales des grands modèles linguistiques (LLM) n’aient été résolues.

Architecture et déploiement : la réalité de « l’espace de travail des agents »

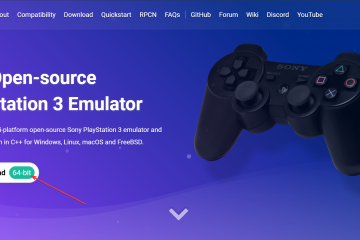

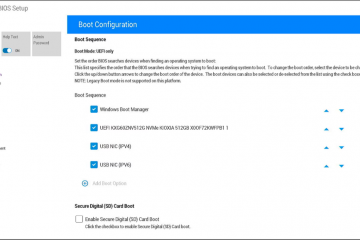

Malgré la fanfare entourant la révélation initiale du « PC AI », la mise en œuvre technique de ces agents est particulièrement prudente. Selon le blog des développeurs Ignite 2025, le nouvel « Agent Workspace » fonctionne comme une session Windows parallèle avec une portée étendue. autorisation plutôt qu’une machine virtuelle ou un bac à sable entièrement isolé.

Équilibrant performances et sécurité, ce choix architectural ne parvient pas à atteindre l’isolement rigoureux que certains experts avaient espéré.

Pour atténuer les risques récemment révélés, Microsoft a restreint l’accès au système de fichiers de l’agent à six dossiers de profil utilisateur spécifiques : Documents, Téléchargements, Bureau, Musique, Images et Vidéos. Conçue pour empêcher les agents compromis d’accéder aux fichiers système critiques, cette limitation vise à contenir les dommages potentiels dans les zones accessibles aux utilisateurs.

Navjot Virk, vice-président des expériences Windows chez Microsoft, a tenté de gérer les attentes lors de l’annonce initiale, avertissant qu’« au début, vous pourriez voir l’agent faire des erreurs ou rencontrer des difficultés lorsqu’il essaie d’utiliser des applications vraiment complexes. »

Actuellement, la fonctionnalité est déploiement auprès des Windows Insiders dans le canal de développement, restant désactivé par défaut et nécessitant le basculement des privilèges d’administrateur. Suggérant une conscience aiguë des réactions négatives potentielles, cette stratégie de déploiement vise probablement à éviter une répétition du désastre entourant la fonctionnalité controversée de rappel, qui a été supprimée après que les chercheurs ont révélé de graves failles de confidentialité.