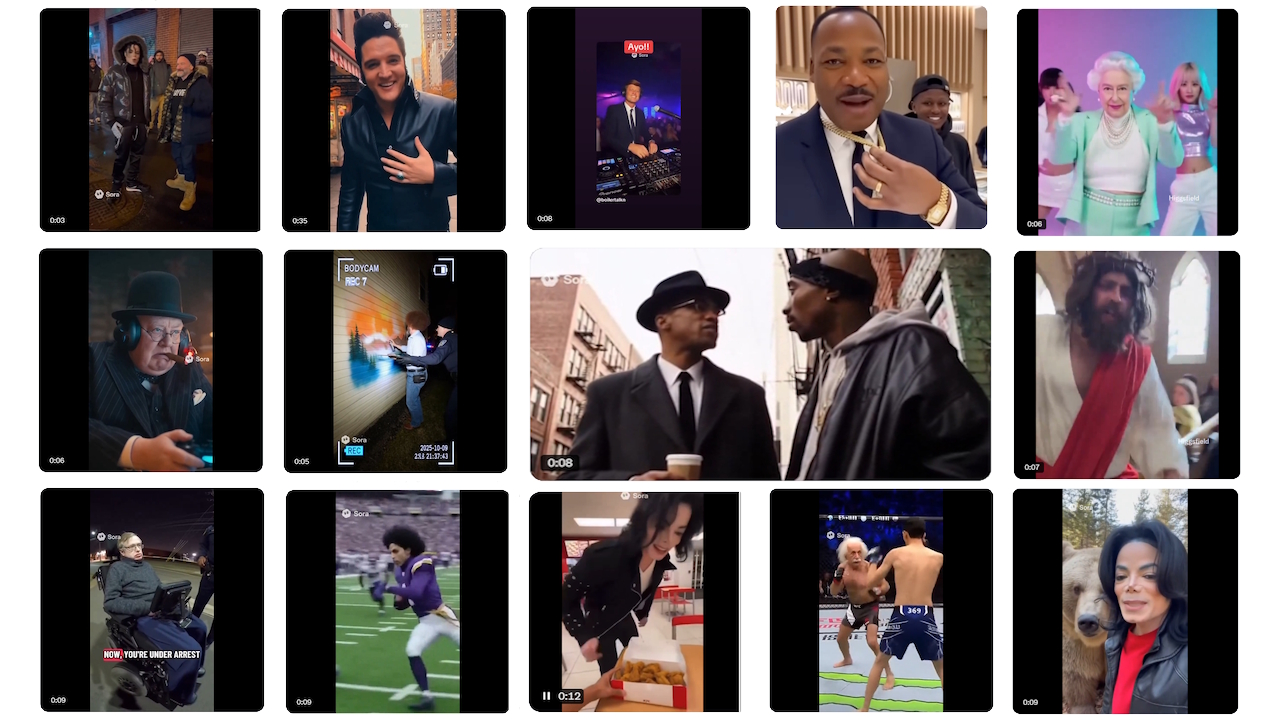

OpenAI a annoncé jeudi avoir suspendu la possibilité pour les utilisateurs de générer des vidéos de Martin Luther King Jr. avec son application Sora 2.

Cette décision intervient à la demande directe de la succession du défunt leader des droits civiques, suite à une vague de « représentations irrespectueuses » créées depuis le lancement de la plateforme début octobre.

La controverse n’est pas isolée ; Les familles d’autres personnalités publiques décédées, dont Malcolm X et Robin Williams, ont également condamné les vidéos blessantes générées par l’IA. Cette réaction violente a contraint OpenAI à une série de revirements politiques rapides, intensifiant un débat féroce sur le consentement et sur qui contrôle l’héritage d’une personne à l’ère de l’IA.

Ce dernier Cette action est la réponse la plus directe d’OpenAI à une crise qui a englouti sa nouvelle plateforme vidéo depuis le premier jour. La politique initiale de l’entreprise exemptait les « personnages historiques » des règles de consentement, une approche qui s’est retournée contre eux presque immédiatement.

Le blocage de l’image du Dr King marque l’intervention la plus spécifique et la plus médiatisée à ce jour.

Les familles condamnent « Horrible, TikTok Slop »

La plateforme a été rapidement inondée de deepfakes bizarres et offensants. Des vidéos montraient le militant des droits civiques Malcolm X faisant des blagues grossières, le peintre Bob Ross représenté avec des paysages enflammés et, selon certaines informations, le Dr King faisant des bruits de singe. La réaction des membres de la famille a été rapide et viscérale.

Ilyasah Shabazz, fille de Malcolm X, a déclaré au Washington Post que « c’est profondément C’est irrespectueux et blessant de voir l’image de mon père utilisée de manière aussi cavalière et insensible alors qu’il a consacré sa vie à la vérité.”

Son sentiment a été repris par Zelda Williams, fille de l’acteur Robin Williams. Elle a supplié les utilisateurs d’arrêter de créer et de partager des vidéos IA de son défunt père.

Williams a décrit la douleur de voir « l’héritage de vraies personnes se condenser en… horribles, les marionnettes de TikTok sont exaspérantes. » Les familles d’autres personnalités ont également prononcé des condamnations publiques. Dans un post concis sur X, la fille du Dr King, Bernice King, a simplement déclaré :”Je suis d’accord concernant mon père. Arrêtez s’il vous plaît.”, un plaidoyer qui a eu un large écho.

Le tollé général a été amplifié par une réponse coordonnée de Hollywood. La puissante Creative Artists Agency (CAA) a qualifié l’application de « risque important », tandis que la Motion Picture Association (MPA) a placé la charge juridique en cas d’utilisation abusive directement sur la société d’IA.

Le PDG de la MPA, Charles Rivkin, a déclaré que « … il reste de leur responsabilité – et non celle des titulaires de droits – d’empêcher toute violation du service Sora 2. »

La ruée d’OpenAI pour inverser Cours

Face à une véritable crise de relations publiques, OpenAI s’est efforcé d’en contenir les conséquences. Le 3 octobre, deux jours seulement après le lancement, le PDG Sam Altman a annoncé un changement par rapport à la politique initiale en matière de droits d’auteur. Il a promis un modèle d’adhésion plus granulaire pour les personnages protégés.

C’était un aveu clair que l’approche initiale de non-intervention était intenable. Le 9 octobre, la société a de nouveau modifié ses règles. Elle a commencé à autoriser les représentants de personnalités publiques « récemment décédées » à demander formellement que leur image soit bloquée sur la plateforme.

L’évolution de la politique a culminé avec l’annonce du 16 octobre selon laquelle elle avait complètement suspendu les générations à l’image du Dr King.

Dans une déclaration publiée sur X, la société a expliqué son évolution de position. OpenAI a déclaré que”bien qu’il existe de forts intérêts en matière de liberté d’expression dans la représentation de personnages historiques, OpenAI estime que les personnalités publiques et leurs familles devraient en fin de compte avoir le contrôle sur la façon dont leur image est utilisée.”, signalant un changement de politique important sous la pression des familles et des partenaires industriels.

Déclaration d’OpenAI et de King Estate, Inc.

La succession de Martin Luther King, Jr., Inc. (King, Inc.) et OpenAI ont ont travaillé ensemble pour expliquer comment l’image du Dr Martin Luther King Jr. est représentée dans les générations Sora. Certains utilisateurs ont généré des représentations irrespectueuses du Dr…

— OpenAI Newsroom (@OpenAINewsroom) 17 octobre 2025

Un champ de mines juridique et éthique

La controverse expose une vaste zone grise juridique et éthique. Les lois traditionnelles sur la diffamation ne s’appliquent généralement pas aux défunts, laissant aux familles des recours légaux limités. Leur principal moyen est un patchwork complexe et incohérent de lois étatiques régissant le droit de publicité post-mortem.

Ce paysage juridique est notoirement fragmenté. Des États comme la Californie et New York disposent de lois strictes protégeant l’image d’une célébrité pendant des décennies après son décès. Cependant, de nombreux autres États n’offrent que peu ou pas de protections de ce type, créant ainsi une loterie légale pour les familles en fonction du lieu de résidence du défunt.

La défense du premier amendement est également un champ de bataille crucial. Les entreprises technologiques soutiennent souvent que le contenu généré par l’IA peut être qualifié d’« utilisation transformatrice » ou de parodie, de formes de discours protégés.

Un tribunal devra peut-être déterminer si un deepfake est une œuvre nouvelle et expressive ou simplement une exploitation non autorisée de l’identité d’une personne, une frontière qui reste floue avec l’IA générative.

OpenAI a défendu sa stratégie de « construction en public », les dirigeants citant la nécessité d’éviter une désavantage concurrentiel en développant une technologie en secret. Alors que l’entreprise considère cela comme une étape nécessaire vers la recherche sur l’AGI, les critiques y voient une démarche calculée visant à normaliser une technologie controversée et à transférer le fardeau de la surveillance de son utilisation abusive sur le public.

La capacité de l’application à générer si facilement ce que les médias 404 appellent « la pourriture cérébrale des principaux personnages protégés par le droit d’auteur » a repoussé le débat non résolu sur le « péché originel » de l’IA – sa dépendance à l’égard de données récupérées – dans sous les projecteurs.