La startup de l’IA chinoise Z.AI augmente la guerre des prix de l’IA du pays avec ses nouveaux modèles GLM-4.5. L’entreprise, anciennement Zhipu, a annoncé lundi la sortie open source. Il positionne les nouveaux modèles pour être moins cher que ceux de Key Rival Deepseek.

Construit pour des tâches”agentiques”complexes, la version cible la transition de l’industrie vers une IA autonome. Ces systèmes peuvent exécuter des instructions en plusieurs étapes. Cette décision intensifie la concurrence dans le secteur technologique chinois, où les entreprises se battent désormais à la fois sur le pouvoir et le prix.

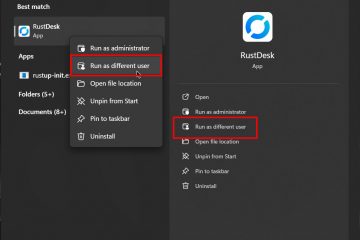

Le lancement se produit également lorsque Z.AI opère sous des sanctions américaines, ajoutant une couche géopolitique à la rivalité. Les modèles sont disponibles via la plate-forme Z.AI, une API et comme open-weights on Hugging Face . height=”626″src=”data: image/svg + xml; nitro-empty-id=mtc5mzoxmtm3-1; base64, phn2zyb2awv3qm94psiwidagmti4mca3nz giihdpzhropsixmjgwiibozwlnahq9ijc3ocigeg1sbnm9imh0dha6ly93d3cudzmub3jnlziwmdavc3znij48l3n2zz4=”>

Sous le capot: un modèle agentique construit pour l’efficacité

La nouvelle famille GLM-4.5 de Z.AI est conçue pour la prochaine vague d’applications d’IA, allant au-delà de la simple suivante des instructions pour adopter un cadre”agentique”plus sophistiqué. Selon les Article de blog technique , les modèles sont conçus pour unifier le raisonnement, le codage et l’utilisation d’outils agentiques, ce qui leur permet de décomposer de manière autonome des demandes complexes, de former un plan et d’exécuter des tâches sans guidage humain continu. Cette approche vise à satisfaire aux exigences de plus en plus compliquées des applications agentiques émergentes.

Le GLM-4.5 phare est un modèle puissant de mélange d’Experts (MOE), un choix de conception qui améliore l’efficacité informatique. Bien qu’il contient un énorme paramètres au total de 355 milliards, il active uniquement un sous-ensemble de 32 milliards de paramètres pour une tâche donnée. Z.AI a également publié une plus petite variante GLM-4.5-air avec 106 milliards de paramètres au total et 12 milliards de personnes actives pour une efficacité encore plus grande. Dans un écart stratégique par rapport aux rivaux comme Deepseek-V3 et Kimi K2, Z.AI a priorisé une architecture «plus profonde et non plus», augmentant le nombre de couches pour améliorer la capacité de raisonnement principale du modèle.

Sous la base de cette architecture sont plusieurs innovations techniques clés. Le modèle utilise une attention groupée et un nombre plus élevé de têtes d’attention pour améliorer les performances des références de raisonnement. Pour garantir la stabilité lors de sa formation massive, qui impliquait un corpus général de 15 milliards de tarifs suivi d’un code et d’un corpus de raisonnement de 7 milliards, l’équipe a utilisé un Muon Optimizer et QK-Norm pour stabiliser les logites d’attention. Le modèle comprend également des appels de fonction natifs et une durée de contexte 128k, tous deux essentiels pour permettre à ses capacités d’agence avancées.

Remarquablement, Z.AI affirme que le modèle phare peut fonctionner sur seulement huit des puces H20 de Nvidia. Ce matériel est la version contrôlée par exportation conçue pour le marché chinois, et l’efficacité du modèle souligne un accent stratégique sur la fourniture de performances élevées dans des contraintes matérielles importantes. Cette combinaison d’architecture avancée, de formation à échelle massive et de positions d’optimisation matérielle GLM-4.5 en tant que nouvelle entrée formidable dans le paysage mondial de l’IA.

performance

Selon des indices comprimés publiés par Z.AI, le nouveau modèle GLM-4.5 pour la conduite de l’idée de se diriger vers le tiers du terrain, de la prétendue Tive Global, de la conduite globale, de l’espace global, de la conduite globale, de la conduite globale, de la conduite globale, de l’espace global, de la conduite globale, de l’espace global, de l’espace global, de la prétendue Tive Global, de Breeding Global, de Breedary PROPEPTY comme un prétendant Top-Initer, Recusting Global Global contre A axation de Breeds de Breedary Are Modèles open source d’Openai, Anthropic et Google. Le plus petit GLM-4.5-Air fonctionne également fortement, garantissant la sixième position. Ces données suggèrent que Z.AI a développé avec succès un modèle qui rivalise à la frontière de la capacité de l’IA, ce qui remet en question la hiérarchie établie.

Dans les tests conçus pour mesurer ses capacités agentiques, GLM-4.5 montre des résultats impressionnants. Sur la fonction-Bench et Berkeley appelant le classement (BFCL-V3), ses performances correspondent à celles de Claude 4 Sonnet. Le modèle excelle également à des tâches de navigation Web complexes, surpassant Claude-4-Opus sur la référence BrowsComp difficile. Son mode de «pensée» s’avère efficace dans le raisonnement avancé, atteignant un score de 91,0 sur le test de compétition de mathématiques AIME24 et 79,1 sur le benchmark de niveau de question de question de niveau GPQA. Grok 4 MMLU Pro 84.6 81,4 85,3 87,3 86,2 84,9 84,5 86,6 Aime24 91,0 89,4 90,3 75,7 88,7 89,3 94,1 94,3 Math 500 98,2 98,1 99,2 98,2 96.7 98,3 98,0 42.8 40,3 42,9 45,7 GPQA 79.1 75,0 82,7 79,6 84,4 81,3 81,1 87.7 HLE 14,4 10,6 20,0 11,7 21,1 14,9 15,8 23,9 Livecodebench (2407-2501) 72,9 70,7 78,4 63.6 80.1 77.0 78.2 81.9 A-98 (Estimé) 67,7 64,8 70,0 64,4 70,5 68,3 69,4 73,2

Les capacités de codage du modèle sont également robustes. Dans une évaluation humaine directe et multi-ronde à l’aide d’un cadre de codage standardisé, GLM-4.5 a atteint un taux de victoire de 53,9% contre Kimi K2 de MoonShot et a dominé le coder QWEN3 d’Alibaba avec un taux de réussite de 80,8%. Z.AI rapporte également un taux de réussite d’appel à outils de 90,6%, le plus élevé parmi ses pairs, démontrant une fiabilité supérieure pour les tâches de codage agentiques. Les trajectoires complètes de ces tests ont été rendu publics disponible pour la Community Review .