Réponses de l’industrie: Meta et Microsoft cybersécurité. Le sceau vidéo de META, un cadre de filigrane open source, intégré des identifiants invisibles et invisibles résistants aux vidéos générées par AI-authentification pour authentifier leur origine.

Cette décision fait partie d’un effort continu à l’échelle de l’industrie pour garantir que les consommateurs peuvent distinguer entre les médias réels et gérés par AI. La solution de Meta complète des efforts comme les initiatives de Microsoft, qui ont également inclus une action en justice contre les cybercriminels exploitant l’IA pour générer un contenu nocif, tels que des vidéos DeepFake.

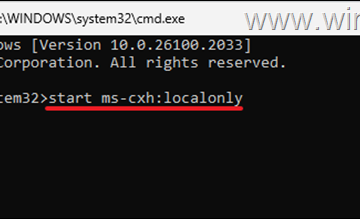

Dans un cas notable, Microsoft a récemment déposé un procès contre un groupe de piratage qui a utilisé des informations d’identification ouvertes malveillantes Stolen Azure pour générer des fasks malveillants. Ces fausses vidéos ont été conçues pour manipuler des cibles dans la divulgation d’informations sensibles. Ce procès souligne la fréquence croissante des menaces de cybersécurité liées à l’IA et la nécessité pour les entreprises d’adopter des défenses robustes contre de telles attaques.

Solutions de défense AI proactives

L’intégration de l’IA dans les plates-formes de cybersécurité est essentielle pour maintenir la sophistication des menaces modernes. La plate-forme de copilote de sécurité de Microsoft, par exemple, s’est récemment développée pour inclure des agents d’IA qui automatisent la détection du phishing, de la gestion de la vulnérabilité et de la protection de l’identité. Ces agents de l’IA font partie d’une tendance plus large où les entreprises tirent parti de l’IA non seulement pour répondre aux cyberattaques mais aussi pour anticiper et atténuer les risques potentiels.

De même, la sécurité adaptative utilise l’IA pour simuler des scénarios d’attaque réalistes, offrant aux entreprises un terrain de test pour renforcer leurs défenses. La plate-forme de l’entreprise vise à enseigner aux employés comment reconnaître les menaces alimentées par l’IA avant de subir des pertes importantes. Cette approche proactive est cruciale car les technologies d’IA comme Deepfakes continuent d’évoluer et deviennent plus difficiles à détecter.

Selon Microsoft, l’intégration de l’IA dans ses outils de sécurité a déjà montré des résultats prometteurs dans la découverte de vulnérabilités dans les systèmes fondamentaux. Ces découvertes-telles que les défauts trouvés dans les chargeurs de démarrage qui pourraient potentiellement être exploités-en lumière la nécessité d’outils dirigés sur l’IA pour identifier les risques que les méthodes traditionnelles de cybersécurité peuvent négliger.

Dans une autre initiative axée sur l’IA, les données NTT et Palo Alto Networks ont introduit le MXDR, un service de cybersécurité AI-Ai-Ai-Ai-Ai-Aid. La plate-forme utilise une détection basée sur l’IA pour identifier rapidement les modèles qui pourraient indiquer des violations potentielles, permettant aux entreprises de réagir rapidement.

Cybersécurité dirigée par AI: un défi mondial

À mesure que les outils AI comme les fesses profondes et le clonage vocal continuent de progresser, les risques associés à leur consommation de mal de plus sont de plus en plus pervasives. Une augmentation mondiale de la cybercriminalité axée sur l’IA, de l’Asie du Sud-Est à l’Europe, a fait des alarmes sur la portée et la sophistication de ces menaces. Rien qu’en Asie du Sud-Est, les cybercriminels ont exploité les technologies de l’IA pour perpétrer la fraude qui s’élevait à 37 milliards de dollars en 2023.

Les gouvernements et les entreprises technologiques commencent à reconnaître l’urgence de lutter contre ces risques. En 2024, Europol a averti que le contenu généré par l’IA complique les efforts pour lutter contre le crime organisé, notant l’utilisation croissante de l’IA pour l’exploitation des enfants et la fraude financière. Cela met en évidence la nécessité d’une action unifiée dans l’industrie de la technologie pour s’assurer que les technologies d’IA sont utilisées de manière responsable, tout en défendant contre ceux qui cherchent à les exploiter à des fins malveillantes.

La voie à suivre: la mise à l’échelle des défenses de l’IA

Le 43 millions de dollars dans les fonds sécurisés par l’adaptation à l’adaptation à l’échelle de l’entreprise Attaques générées par l’AI. Avec le soutien d’Openai, la sécurité adaptative est positionnée pour mener la charge dans la lutte contre ces menaces émergentes. La plate-forme de l’entreprise, qui simule Deepfake attaque et forme les employés à reconnaître les menaces axées sur l’IA, est un élément clé de l’avenir de la cybersécurité.

Cependant, alors que les technologies d’IA continuent de progresser, il en va de même pour la sophistication des cybercriminels qui cherchent à les exploiter. Pour garder une longueur d’avance sur ces risques, les entreprises devront investir dans des outils de cybersécurité de pointe qui peuvent s’adapter aux menaces nouvelles et émergentes. The collaboration between OpenAI and Adaptive Security is a step in the right direction, but it will be essential for the industry to continue innovating and working together to address the rapidly evolving threat landscape.

Final Thoughts on the Evolving Threat Landscape

The growing reliance on AI tools, both for malicious purposes and in defense, makes it increasingly difficult for businesses to navigate the complexities of cybersécurité. Alors que des entreprises comme la sécurité adaptative augmentent leurs efforts pour contrer ces menaces, il devient évident qu’une stratégie de défense multicouche et axée sur l’IA sera essentielle pour se protéger contre la nouvelle génération de cybercriminalité.

Malgré les avancées prometteuses faites par des sociétés comme la sécurité adaptative, la route à l’avance est lancée de défis. Alors que la technologie de l’IA continue d’évoluer rapidement, les entreprises devront rester agiles, adoptant de nouvelles mesures de sécurité et affiner continuellement leurs défenses pour suivre le rythme des menaces. La collaboration entre les sociétés d’IA et les startups de cybersécurité est cruciale pour développer des mécanismes de défense plus sophistiqués et proactifs, garantissant que les entreprises peuvent non seulement répondre, mais aussi anticiper les tactiques de plus en plus sophistiquées employées par les cybercriminels.

Pour le moment, les 43 millions de dollars d’investissement dans la sécurité adaptative ne sont pas prises pour la sécurité du système de sécurité cybercrémique. Cependant, avec le potentiel de l’IA pour le bien et les dommages, il est clair que la bataille pour la sécurité numérique ne fait que commencer. Alors que nous regardons vers l’avenir, la clé sera de veiller à ce que la même technologie stimulant l’innovation puisse également être exploitée efficacement pour se protéger contre la vague croissante de cybercriminalité basée sur l’IA.