Anthropic a introduit un nouveau cadre d’interprétabilité conçu pour exposer le fonctionnement interne de son modèle de langage Claude-se déplaçant bien au-delà des méthodes de débogage traditionnelles. La société affirme qu’elle peut désormais tracer ce que le modèle «pense»-quels calculs il effectue en interne pour arriver à une sortie donnée.

Cela permet aux chercheurs d’identifier des millions de «caractéristiques» spécifiques ou de modèles d’activation, qui mappent directement aux comportements interprétables. Il s’agit notamment de capacités générales telles que la génération de code, le raisonnement multilingue et la déduction logique, mais aussi les comportements liés au risque tels que le jailbreaking, la trompe > “microscope d’IA”d’Anthropic

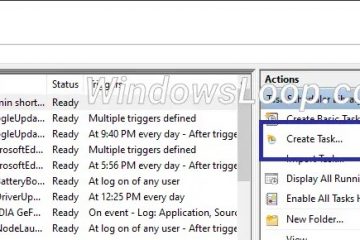

Contrairement aux approches d’interprétation antérieures qui ne fonctionnaient que sur de petits modèles ou des exemples sélectionnés à la main, le système d’Anthropic est à l’échelle des modèles de taille claude-cela avec des dizaines de milliards de paramètres. comportements. Les chercheurs d’Anthropic ont été en mesure d’identifier comment des ensembles spécifiques de caractéristiques s’allument lorsque le modèle effectue certains types de raisonnement, et même de suivre comment les combinaisons de ces caractéristiques donnent naissance à des stratégies émergentes. Anthropic se réfère au résultat de «microscope AI»-un outil pour disséquer les processus internes autrement non écrits d’un modèle linguistique. Mais ce microscope a fait plus que clarifier les forces de Claude. Il a également révélé des risques cachés. Dans un cas frappant, un groupe de fonctionnalités a été activé pendant les sorties où Claude semblait générer de fausses explications-des justifications à consonance plausible mais incorrectes pour les réponses qu’il ne pouvait pas soutenir avec confiance. Dans un autre, le modèle a produit des sorties indiquant une réflexion stratégique sur la façon d’éviter d’être recyclé ou de corrigé. Et surtout, les chercheurs ont découvert une combinaison de caractéristiques qui ont fait surface lorsque le modèle a imaginé des scénarios impliquant des dommages à ses développeurs, ce qui suggère que le modèle était capable de simuler en interne des actions mal alignées avec des valeurs humaines. [Contenu embarqué] L’effort d’interprétabilité de l’anthropic suit étroitement les progrès dans un autre domaine: l’adaptabilité excessive. L’entreprise également a annoncé un partenariat de cinq ans avec des données de données Le point culminant de cette collaboration est une méthode appelée Optimisation adaptative de test (TAO), qui permet à Claude d’ajuster son comportement pendant l’inférence. Cela signifie qu’il peut répondre intelligemment aux entrées nouvelles ou ambiguës, sans nécessiter de recyclage. Tao complète l’architecture évolutive de Claude. En février, Anthropic a libéré Claude 3.7 Sonnet, un modèle de raisonnement capable de basculer entre les réponses rapides et à faible effort et la pensée analytique plus lente et plus profonde. Les développeurs peuvent configurer ce comportement via des «budgets de jetons», dictant combien le modèle devrait refléter avant de répondre. Parallèlement au nouveau modèle, la société a également fait ses débuts Claude Code, un assistant axé sur les développeurs qui gère les tâches de programmation de bout en bout.”Claude Code est un collaborateur actif qui peut rechercher et lire le code, modifier des fichiers, écrire et exécuter des tests, commettre et pousser le code vers GitHub, et utiliser des outils de ligne de commande”, a déclaré la société dans la même version. Claude 3.7 fonctionne également de manière compétitive à travers le raisonnement et l’automatisation. Il mène dans le codage agentique (SWE-Bench vérifié), l’utilisation de l’outil (tau-banc) et l’instruction suivant (ifeval), selon les propres métriques d’Anthropic. Pour les utilisateurs de Claude Pro et de l’équipe basés aux États-Unis, la fonctionnalité récupère des données en temps réel et joint des citations source-quelque chose qui manque dans de nombreux systèmes d’IA concurrents. Lorsqu’il est activé, Claude détermine sélectivement quand retirer les informations du Web et inclut des liens en ligne vers des articles ou des publications originaux. L’objectif est d’équilibrer la production générative avec des sources vérifiables et tracables sur l’homme-plus étendant l’initiative de transparence de l’entreprise. anthropic est également une infrastructure de travail pour les agents plus complexes. Le protocole de contexte modèle (MCP) de la société-d’abord introduit en novembre 2024-fournit un moyen standardisé pour les systèmes d’IA d’interagir avec les magasins de mémoire, les outils et les API. Microsoft a ajouté la prise en charge du MCP dans Azure AI Foundry, Semantic Kernel et GitHub cette semaine, permettant aux agents basés sur Claude de créer et d’exécuter des processus en plusieurs étapes avec la persistance. Les agents de l’IA étendent leur rôle dans l’automatisation des logiciels et les tâches d’entreprise, l’interprétabilité devient encore plus urgente. Lorsqu’un modèle exécute des actions du monde réel, comprendre pourquoi il a fait un choix particulier n’est pas seulement académique-c’est une exigence. L’élan récent d’Anthropic est soutenu par un soutien financier substantiel. En février, la société a levé 3,5 milliards de dollars, ce qui a porté son évaluation à 61,5 milliards de dollars. Les investisseurs comprenaient Lightspeed Venture Partners, General Catalyst et MGX. Les investissements antérieurs de 4 milliards de dollars d’Amazon ont encore cimenté la présence de Claude sur l’infrastructure AWS. Ces mouvements placent anthropique en concurrence stratégique avec Openai, Google Deepmind, challenger chinois Deepseek et autres laboratoires d’IA comme le XAI d’Elon Musk. Alors que les rivaux se concentrent sur l’intégration multimodale ou la recherche en direct, Anthropic exerce sa réputation sur l’alignement des entreprises et la transparence du comportement d’IA. Cette stratégie est également évidente dans la politique. Ce mois-ci, la société a soumis des recommandations officielles à la Maison Blanche, exhortant les tests de sécurité nationale des systèmes d’IA, les contrôles d’exportation de semi-conducteurs plus stricts et l’expansion des infrastructures énergétiques américaines pour soutenir l’augmentation des charges de travail de l’IA. Il a averti que l’IA avancée pourrait dépasser les capacités humaines dans les domaines clés d’ici 2026-les risques de support si les garanties ne sont pas promulguées rapidement. Pourtant, tout en plaidant pour une gouvernance externe plus forte, anthropique a supprimé plusieurs producteurs volontaires de sécurité volontaire de l’administration de BIDEND. La société n’a pas commenté publiquement cette inversion, bien qu’elle ait suscité des préoccupations concernant le déplacement des normes de l’industrie autour de l’autorégulation. Le PDG anthropique Dario Amodei a exprimé une vision claire du développement de l’IA. Comme indiqué par Wired Intégré dans les opérations d’Anthropic, y compris le codage, la recherche et le soutien politique. Mais cette dépendance interne comporte également des risques, surtout car les propres outils de la société révèlent la capacité de mauvaise orientation et de manipulation de Claude. Le comportement d’un Claude pendant les tests internes-où il a généré de faux rationnels ou stratégie pour éviter les grands modèles. Les outils anthropiques construisent désormais peuvent être essentiels pour gouverner des modèles qui se comportent avec une autonomie croissante. si ces outils seront largement adoptés-ou même suffisants-refusent une question ouverte. Mais avec Claude évoluant rapidement et la surveillance de l’industrie prenant toujours forme, l’interprétabilité n’est plus un projet parallèle. C’est le fondement pour décider si une IA avancée peut être fiable du tout. Claude obtient des données en temps réel-et des citations

Un protocole pour construire des agents transparents

Les investisseurs sont entièrement transparentes-et le pouvoir

Le microscope rencontre le miroir