Microsoft a rendu public Phi-4, son modèle de langage compact, en open source en publiant l’intégralité de son contenu sur Hugging Face sous une licence MIT.

Phi-4, introduit pour la première fois en décembre 2024 via La plateforme Azure AI Foundry de Microsoft était initialement disponible uniquement pour les chercheurs sous licence contrôlée. Avec cette version open source, Microsoft fournit aux chercheurs et aux développeurs du monde entier les outils nécessaires pour personnaliser, déployer et commercialiser ce modèle compact mais très performant.

Phi-4 : un modèle compact avec des capacités surdimensionnées. Résultats

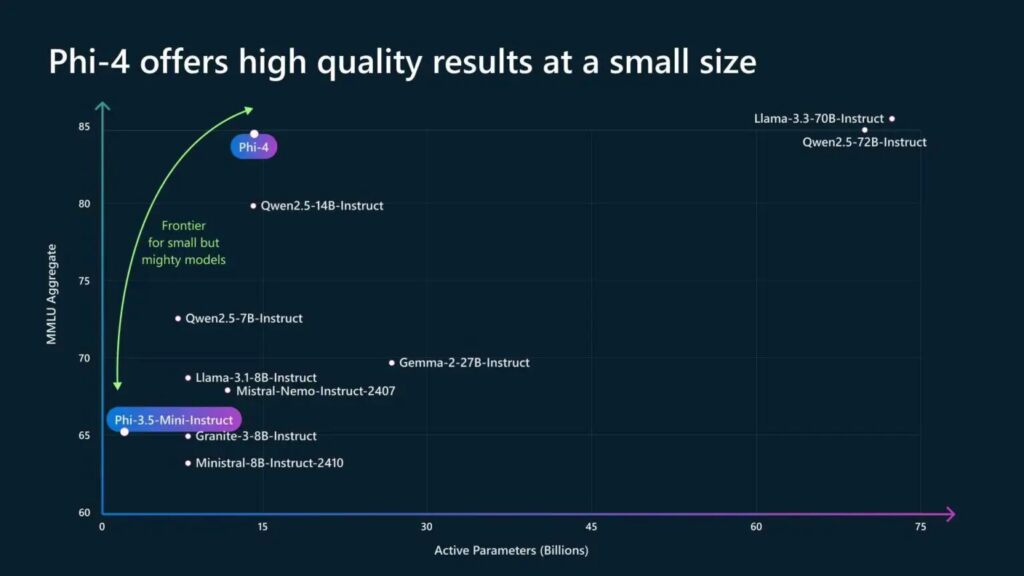

Phi-4 représente une rupture avec le développement traditionnel de l’IA, qui a souvent donné la priorité à l’échelle comme principale mesure de performance. Avec seulement 14 milliards de paramètres, Phi-4 fournit des résultats qui rivalisent et même surpassent ses homologues plus grands, tels que Gemini Pro 1.5 de Google et GPT-4o d’OpenAI.

Source : Microsoft

Source : Microsoft

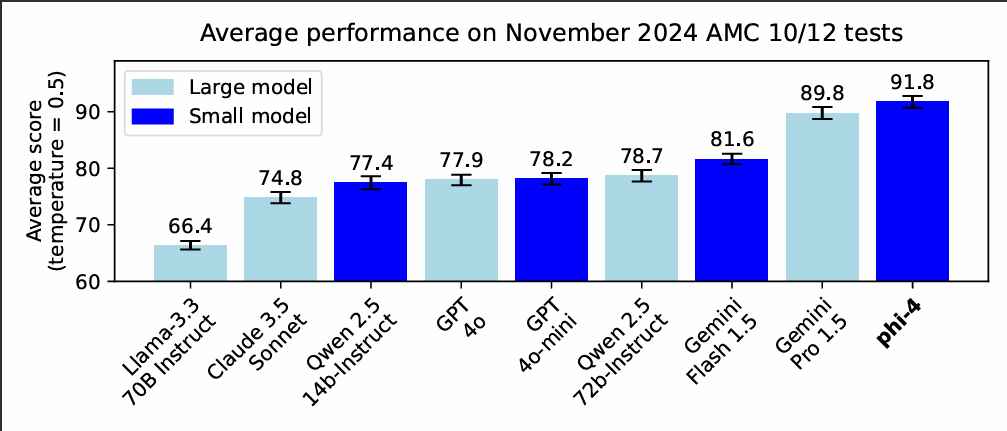

Dans des tests de performances récents, Phi-4 a obtenu un score impressionnant de 91,8 à l’American Mathematics Competition (AMC 12), surpassant le score de 89,8 de Gemini Pro 1,5 et GPT-4o est 77,9.

Microsoft a présenté les capacités de raisonnement mathématique de Phi-4 à travers un problème combinatoire, dans lequel le modèle a calculé avec précision 431 permutations distinctes pour une course hypothétique impliquant cinq escargots.

Phi-4 surpasse des modèles beaucoup plus grands, dont Gemini Pro 1.5, sur des problèmes de compétition mathématique (Source : Microsoft)

Phi-4 surpasse des modèles beaucoup plus grands, dont Gemini Pro 1.5, sur des problèmes de compétition mathématique (Source : Microsoft)

Ce niveau de précision met en évidence son potentiel pour les domaines nécessitant une rigueur logique et mathématique, tels que la finance, l’ingénierie, et la recherche scientifique.

Microsoft a expliqué ses objectifs pour Phi-4 dans sa documentation officielle :”Phi-4 continue de repousser la frontière entre taille et qualité”, un sentiment repris par les chercheurs qui ont comparé ses performances à modèles avec cinq fois plus de paramètres.

Méthodologie de formation et données synthétiques

Le fondement du succès de Phi-4 réside dans son approche de formation exploitée par Microsoft. des ensembles de données synthétiques comprenant contenu de style manuel, mettant l’accent sur le raisonnement mathématique, la programmation et la logique de bon sens. Ces ensembles de données, totalisant 9 800 milliards de jetons, ont été complétés par des documents publics, des textes universitaires et des données multilingues.

« Plutôt que de servir de substitut bon marché aux données organiques, les données synthétiques offrent des avantages directs », a noté Microsoft. dans son rapport technique, soulignant le contrôle et l’adaptabilité qu’elle offre lors de la formation du modèle. Cette approche a également réduit le recours au contenu web-scrapé, souvent critiqué pour ses incohérences de qualité.

Pour améliorer la qualité du modèle. En matière de raisonnement et d’alignement, Microsoft a appliqué des techniques avancées de post-formation telles que le réglage fin supervisé et l’optimisation directe des préférences. Ces méthodologies ont affiné la capacité de Phi-4 à faire la distinction entre les sorties de haute qualité et de mauvaise qualité, améliorant ainsi sa précision dans les applications spécifiques à un domaine..

Disponibilité Open Source

La décision de publier Phi-4 en open source reflète la stratégie plus large de Microsoft visant à démocratiser les outils d’IA. pouvez désormais accéder au modèle sur Hugging Face, où ses poids complets sont disponibles sous licence MIT. Shital Shah, ingénieur principal chez Microsoft, a annoncé la sortie sur X (anciennement Twitter), en écrivant:”Beaucoup de gens nous demandaient une libération de poids… Eh bien, n’attendez plus.”

Nous avons été complètement surpris par la réponse à la sortie de phi-4. Beaucoup de gens nous ont demandé une libération de poids, même si peu ont téléchargé des poids phi-4 contrefaits sur HuggingFace😬.

Eh bien, attendez non. plus. Nous publions aujourd’hui le modèle officiel phi-4 sur HuggingFace !

Avec licence MIT !!/a>

— Shital Shah (@sytelus) 8 janvier 2025

La version open source permet aux développeurs de personnaliser Phi-4 pour des applications spécifiques sans la surcharge de calcul généralement associée aux modèles plus grands. Son architecture dense, composée uniquement de décodeurs, est une variante de. le modèle Transformer minimise les besoins en ressources, le rendant accessible même aux organisations disposant d’une infrastructure limitée.

Considérations éthiques et impacts sur l’industrie

Déploiement de Phi-4 par Microsoft souligne son engagement en faveur d’un déploiement responsable de l’IA. La plateforme Azure AI Foundry, qui hébergeait initialement Phi-4, intègre des protections telles que le filtrage de contenu et les tests contradictoires. Ces mesures sont conçues pour atténuer les risques tels que les biais, la désinformation et la génération de contenu préjudiciable.

En publiant Phi-4 sous une licence open source, Microsoft répond également à la demande croissante de transparence dans le développement de l’IA. Cette décision s’aligne sur les tendances du secteur observées dans des versions telles que la série Llama 3.2 de Meta et la série Gemma de Google, bien que les performances exceptionnelles du Phi-4 dans les tests de référence établissent une nouvelle norme pour les modèles compacts.

Phi-4 remet en question l’hypothèse selon laquelle les modèles plus grands sont intrinsèquement meilleurs. Sa conception compacte réduit non seulement les coûts de calcul et d’énergie, mais élargit également l’accès aux capacités avancées d’IA. Cette efficacité est particulièrement précieuse pour les organisations de taille moyenne et les chercheurs qui ne disposent pas des ressources nécessaires pour déployer des modèles massifs.

Alors que l’IA continue d’évoluer, Phi-4 offre un aperçu d’un avenir où des modèles plus petits et plus intelligents pourront se rencontrer. aux exigences des tâches spécialisées sans compromettre les performances.