SambaNova Systems, un acteur clé de l’IA générative destinée aux entreprises, a établi une nouvelle référence en matière de performances en atteignant un débit de 1 000 jetons par seconde. en utilisant le modèle d’instruction de paramètre Llama 3 8B. Cette réussite, validée par la société de tests indépendante Analyse Artificielle, dépasse le précédent record de 800 jetons par seconde détenu par Groq. Cette étape représente une avancée significative dans les capacités des systèmes d’IA générative.

Applications d’entreprise et implications

L’augmentation de la vitesse de traitement a des implications considérables pour diverses applications d’entreprise. Des temps de réponse plus rapides, une meilleure utilisation du matériel et des coûts opérationnels réduits font partie des avantages. Cette accélération est particulièrement avantageuse pour les applications nécessitant une faible latence et un débit élevé, telles que les agents d’IA, les applications d’IA grand public et l’interprétation de documents volumineux. George Cameron, co-fondateur d’Artificial Analysis, a déclaré VentureBeat le rythme croissant de la course aux puces IA et met en évidence les options matérielles croissantes disponibles pour les développeurs d’IA. Son entreprise met l’accent sur les performances réelles de ces systèmes, apportant un nouvel enthousiasme aux cas d’utilisation dépendant de la vitesse.

🚀 SambaNova a ravagé NVIDIA dans un nouveau test de vitesse réalisé par Artificial Analysis. 🚀

Samba-1 Turbo fonctionne à merveille rapide à 1 000 t/s, un record du monde : https://t.co/PmDHWrFGCH.#AI # GenAI #EnterpriseAI #LLM #NLP #AIAreAll #GPUAlternative #EnterpriseScaleAI #AIChips #ChipRace pic.twitter.com/TMtUqyZWpy

— Systèmes SambaNova (@ SambaNovaAI) 29 mai 2024

Les avancées technologiques derrière cette réussite

Le succès de SambaNova repose essentiellement sur sa technologie d’unité de flux de données reconfigurable (RDU), qui le distingue des accélérateurs d’IA traditionnels comme les GPU de Nvidia. Les RDU sont des puces d’IA spécialisées conçues pour prendre en charge à la fois les phases de formation et d’inférence du développement de modèles d’IA. Ils excellent dans la gestion des demandes de charge de travail de l’entreprise, y compris dans le réglage précis des modèles. La pile logicielle de SambaNova joue un rôle crucial dans l’optimisation du RDU pour des gains de performances, permettant une optimisation itérative de l’allocation des ressources sur différentes couches de réseau neuronal, conduisant à des améliorations significatives en termes d’efficacité et de vitesse.

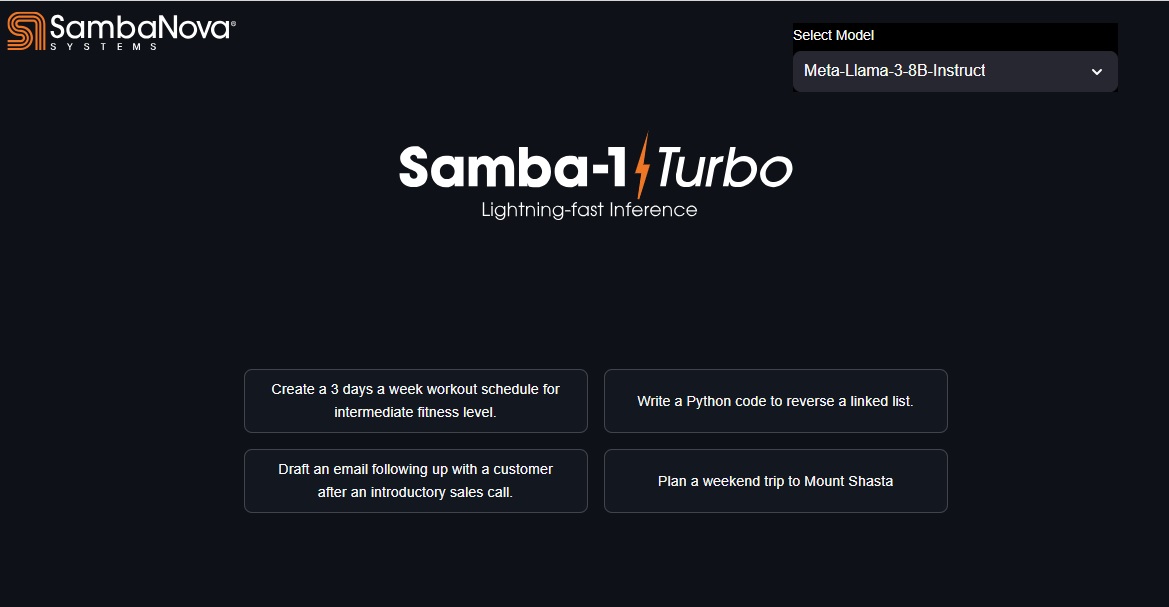

L’introduction de Samba-1-Turbo, alimenté par la puce SN40L, a joué un rôle déterminant dans l’atteinte de ce record du monde. Le Samba-1-Turbo traite 1 000 jetons par seconde avec une précision de 16 bits, exécutant le modèle avancé Llama-3 Instruct (8B). Contrairement aux GPU traditionnels, qui souffrent souvent d’une capacité de mémoire sur puce limitée et de transferts de données fréquents, le RDU de SambaNova dispose d’un énorme pool de mémoire distribuée sur puce via ses unités de mémoire de modèle (PMU). Ces PMU sont positionnées à proximité des unités de calcul, minimisant le mouvement des données et améliorant l’efficacité.

Optimisation de l’exécution du réseau neuronal

Les GPU traditionnels exécutent des modèles de réseau neuronal de manière mode noyau par noyau, qui augmente la latence et sous-utilise les unités de calcul. En revanche, le compilateur SambaFlow mappe l’intégralité du modèle de réseau neuronal sous forme de graphique de flux de données sur la structure RDU, permettant l’exécution de flux de données en pipeline et améliorant les performances. La gestion de grands modèles sur des GPU nécessite souvent un parallélisme de modèles complexe, exigeant des frameworks et du code spécialisés. L’architecture RDU de SambaNova automatise le parallélisme des données et des modèles lors du mappage de plusieurs RDU dans un système, simplifiant ainsi le processus et garantissant des performances optimales.

Le Meta-Llama-3-8B-Instruct alimente la vitesse et l’efficacité sans précédent du Samba-1-Turbo. De plus, la suite SambaLingo de SambaNova prend en charge plusieurs langues, notamment l’arabe, le bulgare, le hongrois, le russe, le serbe (cyrillique), le slovène, le thaï, le turc et le japonais, démontrant la polyvalence et l’applicabilité mondiale du système. L’intégration étroite du matériel et des logiciels dans Samba-1-Turbo est la clé de son succès, rendant l’IA générative plus accessible et plus efficace pour les entreprises.