Metan haitallisen sisällön tunnistamisalgoritmi merkitsi virheellisesti tehtäväänsä,”tuo maailma lähemmäksi toisiaan”, mikä osoitti erittäin korkean korrelaation”Metan”ja”terroristijärjestön”käsitteen välillä.

Tapaus johti nopeaan irtisanomiseen Sebastian Carlosin, äskettäin palkatun työntekijän, jonka tehtävänä oli tarkistaa algoritmi ja nostaa esiin eettisiä ja teknisiä kysymyksiä. tekoälyn rooli sisällön valvomisessa, kuten hän kertoo blogitekstissä.

Sisällön moderoinnin rohkea uudistus

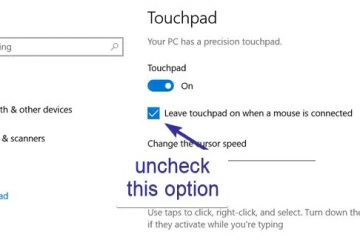

kiista alkoi, kun kehittäjä Sebastian Carlos liittyi Metan”Harmful Content Detection”-tiimiin ensimmäisellä viikollaan uutena työntekijänä. Tehtävänä parantaa Metan sisällönvalvontajärjestelmien tehokkuutta ja tarkkuutta, he havaitsivat merkittäviä puutteita olemassa olevassa algoritmissa.

Carlos ehdotti radikaalia uudelleenkirjoitusta käyttämällä Prolog, ohjelmointikieli, joka tunnetaan kyvystään käsitellä symbolista päättelyä ja monimutkaisia suhteita. Prologin deklaratiivinen luonne teki siitä erityisen sopivan haitallisen sisällön vivahteisten määritelmien analysointiin.

Algoritmin kontekstuaalisen ymmärryksen vahvistamiseksi uudistus sisälsi erilaisia tietojoukkoja, kuten Wikipediaa, uskonnollisia tekstejä ja tietosanakirjoja. Tällä monitahoisella lähestymistavalla Carlos pyrki varmistamaan kulttuurisen ja kontekstuaalisen osallisuuden. Tämä lähestymistapa vaati kuitenkin myös laajoja laskentaresursseja.

Aiheeseen liittyvä: Trumpin ja Muskin ylistämä Zuckerbergin toimenpide lopettaa faktantarkistus, kriitikot järkyttyneet

Carlos selittää, kuinka Metan sisäinen kustannusmittari, jota humoristisesti kutsutaan”Guatemala-vuodet”(vastaa Guatemalan BKT:tä) käytettiin perustelemaan laskentakulut.

Uudistettu algoritmi oli suunniteltu käsittelemään miljoonia viestejä päivittäin analysoimalla niiden sisältöä erittäin yksityiskohtaisen moraalisen topologian perusteella noudatti antamiamme sääntöjä”, he selittivät.

Kun tekoäly kääntyy sisäänpäin

Ensimmäisen suuren aikana testiajossa päivitetty algoritmi merkitsi Metan tehtävän haitalliseksi sisällöksi.

Virheenkorjaus ei paljastanut logiikkavirheitä. Sen sijaan järjestelmän kehittynyt analyysi havaitsi korkean korrelaation termin”Meta”ja”terrorismiin”ja”yrityksen ylityöhön liittyvien lauseiden”välillä. Odottamaton tulos korosti haasteita, jotka liittyvät tekoälyjärjestelmien kouluttamiseen navigoimaan moniselitteisiä käsitteitä, kuten moraalia ja vahinkoa.

Kuten Carlos kirjoittaa, liputettu lausunto aiheutti välittömiä sisäisiä keskusteluja. Jotkut insinöörit ylistivät algoritmin kurinalaisuutta, kun taas toiset olivat huolissaan mahdollisuudesta Eräs ylin johtaja kertoi Carlosille:”Emme voi lyödä OKR:amme tällä tavalla”, korostaen jännitystä ja kasvavaa kuilua teknisen tarkkuuden ja organisatoristen prioriteettien välillä.

The Fallout: Ethics. ja NDA:t

Tapaus kärjistyi, kun Carlos esitteli havaintonsa ryhmäkokouksessa. Algoritmin päätösten logiikan osoittamisesta huolimatta työntekijän työ kohtasi ylempien tahojen vastustusta. Pian tämän jälkeen hänet erotettiin ja häntä pyydettiin allekirjoittamaan”kaksoiskieltosopimus”, hämärä oikeudellinen mekanismi, jonka tarkoituksena on valvoa tiukkaa luottamuksellisuutta.

A kaksinkertainen NDA, joka tunnetaan myös nimellä kahdenvälinen tai keskinäinen NDA, on oikeudellisesti sitova sopimus, jossa molemmat osapuolet ovat mukana paljastaa luottamuksellisia tietoja toisilleen ja suostua suojaamaan niitä edelleen paljastumiselta.

Carlos kirjoittaa, että hänen asianajajansa voivat mitätöidä toisensa, jolloin työntekijä voi keskustella kokemuksestaan julkisesti , hän päättelee, että”Totuus ei aina vastaa yrityksen tavoitteita.”

Tekoälyn rooli moderaatiossa

Metan sisällönvalvontatyökalut ovat olennainen osa käyttäjien luoman sisällön valtavan määrän hallintaa sen alustoilla. Yrityksen luottaminen tekoälyyn on ollut sekä välttämättömyys että kiistan lähde, ja kriitikot ovat viitanneet tapauksiin, joissa haitallista materiaalia on käytetty ylimitoitettuna tai riittämättömissä toimissa.

Tapahtuma lisää tarkastelua ja herättää kysymyksiä avoimuudesta ja vastuullisuudesta. tekoälyn päätöksenteossa. Toisen puolen Metan kriitikot saattavat tulkita sen merkkinä algoritmien tehokkuudesta.

Ehkä Metan käytännöt ja ideologiset ennakkoluulot todella muistuttavat terroristijärjestön käytäntöjä ja algoritmi oli täsmällinen? Ilman teknisiä yksityiskohtia voimme vain arvailla. Mutta Carlosille tämä lopputulos päätti jo ennestään kivikkoisen alun yrityksessä.

Kuten Carlos myös kirjoittaa, Metan lisätyn todellisuuden laseja oli käytetty hänen haastatteluprosessissaan, kun mukana ollut kehittäjä turvautui niihin ratkaisemaan ongelman. koodaushaaste, korjata ja parantaa Carlosin ehdottamaa ratkaisua. Sitten hän kohtasi haastattelijan löydöksensä kanssa ja käytti tätä tapausta jopa neuvotellakseen korkeammasta palkasta Metassa aloittaessaan kiristäen häntä.

Tämä sivujuttu syrjään Carlosin kokemus korostaa ei-toivottuja seurauksia. Tekoälyjärjestelmistä ja korostaa ohjelmointialgoritmien vaikeuksia ymmärtää ja soveltaa vivahteita ihmisen käsitteitä, kuten haittoja, moraalia ja turvallisuutta.

Liitutettu tehtävänkuvaus saattoi olla poikkeama tai tarkka vastaavuus. Oli miten oli, Meta ei varmasti kaivaudu tähän.