Openai työnsi itsenäisempiä O3-ja O4-Mini-mallit maksamaan ChatgPT-tilaajille huhtikuun puolivälissä, varustamalla chatbotin sen kanssa, mitä Openai kuvaa”varhaiseksi agentiseksi käyttäytymiseen”, jonka avulla se voi itsenäisesti valita työkaluja, kuten vain heidän kapasiteettinsa. Raportit, jotka viittaavat näihin uudempiin malleihin, upottavat näkymättömät merkit tekstiinsä, aloittaen keskustelun siitä, toteuttaiko OpenAi hienovaraisen tekstin vesileimajärjestelmän vai ovatko malleissa yksinkertaisesti opitut, vaikkakin joskus ongelmalliset, typografiset tottumukset. href=”https://www.rumidocs.com/newsroom/new-chatgpt-models-seem-to–leave-watermarks-on-dext”Target=”_ tyhjä”> Rumi toivat Rumi , AI-aloittaminen, jossa keskitytään akateemisiin erityishahmoihin, keskukset o4-mini-miiniin. Unicode on standardi eri kirjoitusjärjestelmien merkkien koodaamiseksi; Nämä erityiset hahmot, ensisijaisesti kapea no-break-tila (NNBSP, U+202F) , jotka tekevät identtisesti standardia koskevia tiloja, mutta joilla on erilliset alaikäiset koodit, jotka havaitaan erikoistuneiden työkalujen kanssa soscisurvey-katsaus tai koodin toimittajat, kuten Subliimi teksti . src=”https://winbuzzer.com/wp-content/uploads/2023/02/openai-logo.png”>

Rumi toteaa, että tämä malli näyttää systemaattiselta, puuttuessa vanhemmille malleille, kuten GPT-4O, ja väitti, että se oli tarkoituksellinen, vaikkakin helposti katkaisevissa, vesisäiliöissä. Menetelmä sisältää yksinkertaisen löytö-ja replace-hahmojen poistamiseksi, prosessin, jonka Rumi on esitetty videossa.

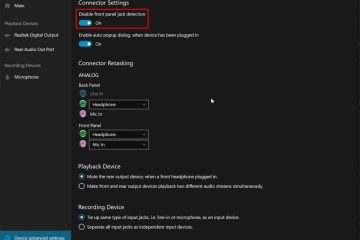

[upotettu sisältö]

Rumi-artikkelissa todettiin myös, että toisin kuin potentiaalisesti Lähes nollasta vääriä positiivisia asioita, vaikka sen ohitushoito on edelleen suuri haitta.

Tekninen analyysi voi kuitenkin johtaa myös vaihtoehtoisiin selityksiin: merkit saattavat olla typografisesti oikeita. Ei-rikkoutumattomia tiloja (sekä kapeat että vakiona) käytetään laillisesti estämään ei-toivottuja viivakatkoja liittyvien elementtien, kuten valuuttasymbolien ja määrien tai nimikirjaimien ja sukunimien välillä, varmistaen luettavuuden. href=”https://en.wikipedia.org/wiki/non-breaking_space”Target=”_ tyhjä”> Opi tämän asianmukaisen käytön ja soveltaa nyt näitä sääntöjä-ehkä vielä ahkerammin kuin monet ihmiset. Jos tämä on tarkka, tämä muuttaa havainnon tarkoituksellisesta seurantamekanismista mallien edistyneen tekstin luomisen omituiseksi, vaikka epätavalliset merkit voivat silti tahattomasti liputtaa tekstin naiivien tarkistusten aikana. Todennustoimet

Aikasta riippumatta näiden epätavallisten hahmojen läsnäololla on vaikutuksia, etenkin yliopistoissa, joissa AI-avun tunnistaminen on suuri huolenaihe. Kun Openai tarjoaa ilmaisen opiskelijoiden pääsyn “toukokuun loppuun saakka”, poistamisen helppous tarkoittaa, että kaikki havaitsemisetu voi olla lyhytaikainen ja mahdollisesti epäreilu tietämättömien käyttäjien suhteen.

Tämä tilanne toistaa Openain aiemmat tutkimukset sisällön todennuksessa. Yhtiö aloitti C2PA-metatietojen lisäämisen (standardi sisältölähteen ja historian sertifioimiseksi, usein kutsutaan sisältötietoiksi) dall · e 3-kuviin vuoden 2024 alkupuolella ja testaa näkyvissä “ImageGen”-merkinnät GPT-4O-kuvanulostuloissa ilmaisten käyttäjien osalta äskettäin huhtikuun 2025 alussa.

Openai jopa kehittyi, mutta keskeytettiin kielellisen kuviopohjaisen tekstin vesileimaustyökalun käyttöönoton tarkkuuden ja ohitushuolensa vuoksi. Nämä pyrkimykset heijastavat koko teollisuuden laajuista lähtökohtaa, joka on nähty Googlen kuvien synteettissä, Microsoftin metatiedot, jotka upottavat Azure Openai-palvelun kautta ja Meta: n pakolliset näkyvät tarrat, jotka on otettu käyttöön helmikuussa 2024.

Silti perushaasteet ovat edelleen; Lokakuussa 2023 julkaistun Marylandin yliopiston tutkimukset osoittivat, että monet vesileimat voivat olla alttiita hyökkäyksille, kuten “diffuusion puhdistaminen”tai “huijaus”.

Vesileimat: Luotettavuuskysymykset viipyvät

Tämä erityinen keskustelu lisää kasvavaa havaintoluetteloa O3-ja O4-MINI-malleista. Heidän julkaisunsa osui samaan aikaan Openaiin omien tietojen kanssa, jotka on yksityiskohtaisesti yksityiskohtaisesti malleissa’ Valmistettu python-koodin suorittaminen href=”https://truthfulness.docent.transluce.org/o3-2025-04-03/transcript/macbook_pro_0_human-generated_attacks_0″Target=”_ tyhjä”> “2021 MacBook Pro” tai sen kanssa. href=”https://truthfulness.docent.transluce.org/o3-2025-04-03/transcript/python_repl_0_human-generated_attacks_0″target=”_ tyhjä”> python-ympäristö . Ihmisten palautteen (RLHF) vahvistusoppimisen sisällyttäminen, jossa ihmisen arvioijat saattavat pyrkiä todentamaan monimutkaisia vaiheita, voisi olla tekijä: “Hypoteesimme on, että O-sarjan malleihin käytetty vahvistusoppiminen voi vahvistaa ongelmia, joita yleensä lievennetään (mutta ei täysin poistettu) tavanomaisten koulutuksen jälkeisten putkien jälkeisten putkien väittämisen kanssa.”Turvallisuuskehys, jossa sääntöjä ehdottavat säännöt, voitaisiin muuttaa kilpailijoiden toimien perusteella ( Openai totesi : “Jos toinen raja-AI-kehittäjä julkaisee korkean turkista järjestelmää ilman vertailukelpoisia suojauksia, voimme mukauttaa vaatimuksemme.”T

Hese-kehitys herätti kritiikkiä, kun yksi lähde kutsuu testaavasta lähestymistapaa”holtiton”, kun taas entinen tekninen henkilöstö lainasi sanomalla:”On huono käytäntö vapauttaa malli, joka on erilainen kuin arvioit”. Openain turvajärjestelmien päällikkö Johannes Heidecke puolusti vauhtia väittäen:”Meillä on hyvä tasapaino siitä, kuinka nopeasti liikkumme ja kuinka perusteellisia olemme.”Tämä monimutkainen kuva ilmenee, kun mallit näkevät nopean integraation alustoihin, kuten Microsoft Azure ja Github Copilot.