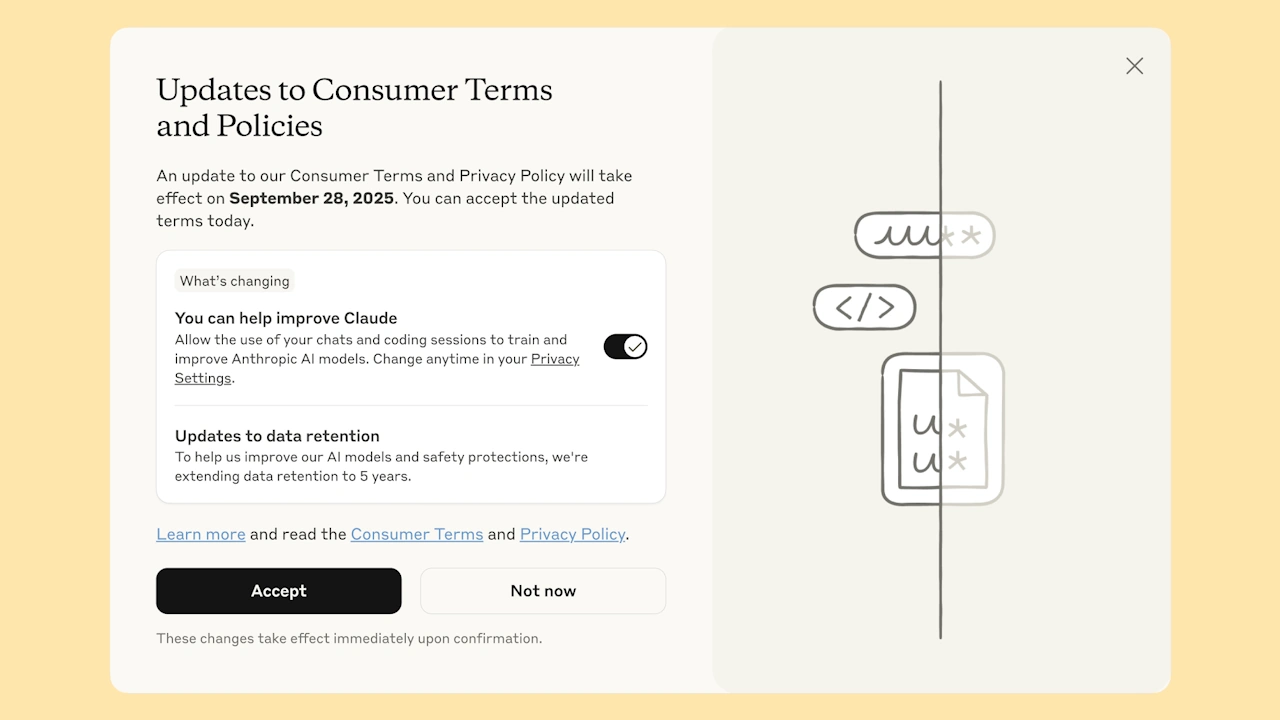

Anthrope está actualizando su política de privacidad, lo que lo convierte en el último desarrollador importante de IA en utilizar los datos de chat de consumo para la capacitación de modelos de forma predeterminada. Comenzando de inmediato para los nuevos usuarios y solicitando a los usuarios existentes que no optan por el 28 de septiembre, la compañía retendrá y analizará las conversaciones de sus servicios de Claude AI para mejorar los modelos futuros.

Este cambio alinea antrópico con competidores como Google y Meta, que tienen políticas de exclusión similares. El movimiento intensifica el debate en curso sobre la privacidad del usuario y el control de datos en la carrera por una IA más poderosa, colocando la carga a las personas para administrar activamente cómo se usa su información personal.

antrópico adopta la política de capacitación de datos de exclusión

bajo los nuevos términos, los datos de los usuarios de los cláude de los estandamientos y los mágicos se recopilarán a los centros a menos que se recopilen los niveles mágicos y los mágicos. href=”https://www.anthropic.com/news/updates-to-our-consumer-terms”target=”_ blank”> explícitamente optando por fuera . For those who consent, Anthropic is also extending its data retention period significantly, from the previous 30 days to five years.

Anthropic justifies the move by Explicar que los datos de las interacciones del mundo real proporcionan información crucial sobre qué respuestas son más útiles y precisas. Por ejemplo, un código de depuración de desarrolladores con Claude ofrece señales valiosas que mejoran el rendimiento futuro del modelo en tareas similares.

Un cambio en toda la industria hacia la recopilación de datos predeterminada

El cambio de política de Anthrope no está sucediendo en una vacío. Refleja una tendencia de la industria más amplia donde la recopilación de datos predeterminada se ha convertido en la norma para los productos de IA orientados al consumidor. Google anunció recientemente una política de exclusión similar para Gemini, que entrará en vigencia el 2 de septiembre.

Esa política es igualmente amplia, cubriendo archivos, fotos, videos e incluso capturas de pantalla que los usuarios hacen preguntas. Del mismo modo, la aplicación AI de Meta, lanzada en abril de 2025, también recuerda a los chats de los usuarios de forma predeterminada personalizar las respuestas y se encontró que capturaran detalles confidenciales inferidos de los chats.

Esta convergencia de estrategias entre los grandes jugadores tecnológicos subrayan el valor inmenso de los datos de los usuarios del mundo real en la carrera competitiva a la raza competitiva a la construcción de los sistemas AI de la AI de la raza más capaz y el contexto. Los precedentes montan

Este pivote en toda la industria se ha encontrado con una resistencia significativa de los defensores de la privacidad y ha desencadenado desafíos legales. Los críticos argumentan que estos sistemas de exclusión están diseñados para desalentar a los usuarios de proteger sus datos. Ben Winters de la Federación de Consumidores de América llamó a tales divulgaciones y opciones”Las revelaciones y las elecciones de los consumidores en torno a entornos de privacidad son ridículamente malos”.

El panorama legal también se está volviendo más peligroso para las empresas tecnológicas. En enero de 2025, se presentó una demanda colectiva contra LinkedIn, acusándolo de utilizar mensajes privados de InMail de suscriptores premium para capacitar a los modelos de IA, supuestamente violando la Ley de Comunicaciones almacenadas.

complicando más asuntos, un tribunal de EE. UU. OpenAi en julio para retener a todos los chats de usuarios, incluso de esos usuarios de los usuarios, como los usuarios posibles en sus copyright inflinaciones inflinaciones en el momento de la ley de New York. Este fallo alarmado expertos en privacidad como Jay Edelson, quien advirtió:”La idea de que tienes un grupo de abogados que van a hacer lo que sean con algunos de los datos más sensibles del planeta… debería hacer que todos sean inquietudes”. Muchos sienten que el equilibrio está apagado, con Justin Brookman de Consumer Reports señalando:”La idea de un agente es que está trabajando en mi nombre, no en tratar de manipularme en nombre de los demás”.