Nvidia ha anunciado un conjunto de herramientas para abordar la creciente necesidad de confianza, seguridad y confiabilidad en los sistemas de IA agentes.

Conocidos como Nvidia Inference Microservices (NIM), las nuevas ofertas están diseñados para ayudar a las empresas a implementar aplicaciones de IA que cumplan con las pautas de seguridad y eviten resultados no deseados.

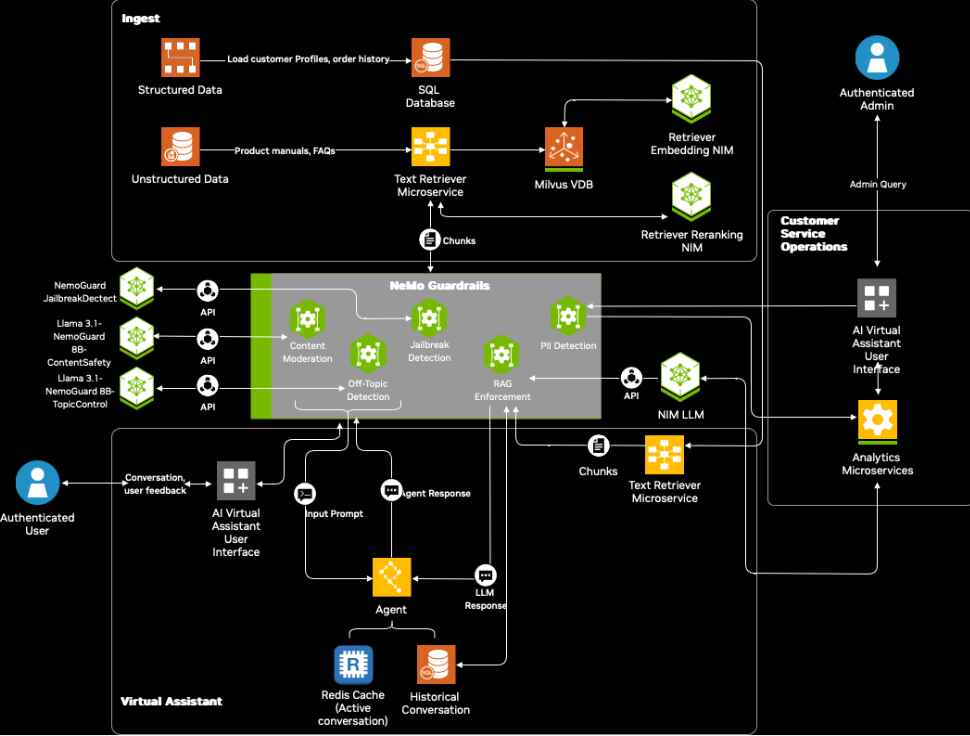

Como parte del marco NeMo Guardrails, estos microservicios proporcionan soluciones especializadas para moderar contenido, mantener límites conversacionales y detectar intentos de eludir las salvaguardas.

Kari Briski, vicepresidenta de modelos empresariales de IA en Nvidia, enfatizó la importancia de garantizar la seguridad de la IA en las aplicaciones actuales.”Los agentes de IA están transformando rápidamente las industrias al automatizar las interacciones, pero garantizar su seguridad y confiabilidad es fundamental”, afirmó en el anuncio oficial.

[contenido incorporado]

Abordar los desafíos de seguridad de la IA con microservicios especializados

La IA agente, una forma de inteligencia artificial que realiza tareas de forma autónoma, ha experimentado una adopción cada vez mayor en industrias como la minorista, la atención médica y la automoción.

Mientras estos sistemas. mejorar la eficiencia y la participación del cliente, también plantean preocupaciones sobre resultados dañinos, privacidad de datos y vulnerabilidades adversas. Los NIM de Nvidia tienen como objetivo mitigar estos riesgos con tres soluciones específicas:

El Content Safety NIM, capacitado en el conjunto de datos de seguridad de contenido patentado Aegis, está diseñado para detectar y bloquear resultados inapropiados o dañinos de los sistemas de inteligencia artificial. Este conjunto de datos, que consta de más de 35,000 muestras anotadas por humanos, permite a los modelos identificar y responder al contenido tóxico de manera efectiva.

Relacionado: NVIDIA avanza en la IA agente con modelos Llama y Cosmos Nemotron

Nvidia planea hacer que el conjunto de datos esté disponible públicamente a través de Hugging Face a finales de este año, ampliando su accesibilidad para desarrolladores e investigadores.

El Control de temas NIM garantiza que las interacciones generadas por IA permanezcan dentro de límites definidos, evitando que los sistemas se desvíen hacia temas irrelevantes o no autorizados. Esta herramienta es particularmente útil en escenarios de servicio al cliente donde son esenciales respuestas consistentes y contextualmente relevantes.

El JailbreakDetection NIM aborda la creciente preocupación por los ataques adversarios. Al analizar las entradas con un conjunto de datos de 17.000 intentos de jailbreak conocidos, el microservicio identifica y bloquea mensajes maliciosos diseñados para anular las protecciones del sistema.

Diagrama de flujo de asistentes virtuales inteligentes de IA seguros para el servicio al cliente con NeMo Guardrails (Imagen: Nvidia)

Diagrama de flujo de asistentes virtuales inteligentes de IA seguros para el servicio al cliente con NeMo Guardrails (Imagen: Nvidia)

Briski destacó la eficiencia de estas herramientas y afirmó: “Los modelos pequeños como los del La colección NeMo Guardrails proporciona una latencia más baja, lo que permite una integración perfecta en entornos con recursos limitados, como almacenes u hospitales”.

Equilibrio entre la seguridad y el rendimiento de la IA

Un aspecto crítico Un aspecto del enfoque de Nvidia es equilibrar la necesidad de seguridad con la demanda de alto rendimiento. Nvidia dice que las primeras pruebas indican cómo los nuevos microservicios añaden sólo alrededor de medio segundo de latencia al tiempo que mejoran las medidas de seguridad en un 50%.

Relacionado: NVIDIA presenta el modelo de IA Fugatto para música, voces y efectos de sonido

Este nivel de optimización aborda una de las preocupaciones más comunes en la IA empresarial —Garantizar tiempos de respuesta rápidos sin comprometer la seguridad.

“Dependiendo de la interacción del usuario, se pueden realizar muchos LLM o interacciones diferentes, y hay que proteger cada una de ellas”, dijo Kari Briski.

Casos de uso empresarial y adopción industrial

Varias empresas importantes ya han incorporado NeMo Guardrails en sus flujos de trabajo de IA para mejorar la seguridad y la confiabilidad. Por ejemplo, Lowe’s, el minorista de mejoras para el hogar. , utiliza estas herramientas para mejorar las interacciones con los clientes y garantizar la precisión de las respuestas generadas por IA.

Cerence AI, líder en IA automotriz, aprovecha los microservicios para impulsar las tecnologías de asistentes en el automóvil.”NeMo Guardrails nos ayuda a ofrecer respuestas confiables, conscientes y libres de alucinaciones, protegiendo nuestros modelos contra resultados dañinos”, explicó Nils Schanz, vicepresidente ejecutivo de Producto y Tecnología de Cerence AI.

Relacionado: Microsoft recorta los pedidos de Nvidia GB200 y prioriza la GB300 en medio de retrasos en la producción

Además, empresas como Amdocs y Taskus están utilizando estas herramientas para crear sistemas de inteligencia artificial más seguros y confiables para la participación y el soporte del cliente. Amdocs, un proveedor global de software para comunicaciones y medios, utiliza NeMo Guardrails para mejorar las interacciones con los clientes impulsadas por IA.

Iniciativas de código abierto e implicaciones más amplias

Para ayudar a los desarrolladores a probar y mejorar la seguridad de la IA, Nvidia ha presentado Garak, un conjunto de herramientas de código abierto para identificar vulnerabilidades en los sistemas de IA.

Garak simula escenarios adversarios, incluidas inyecciones rápidas e intentos de jailbreak, lo que permite a las organizaciones fortalecer sus modelos de IA contra amenazas potenciales.

Los desarrolladores también pueden acceder a tutoriales detallados y planos de referencia para agilizar la implementación de NeMo Guardrails y microservicios. Estos recursos cubren una variedad de casos de uso, desde chatbots de servicio al cliente hasta asistentes automatizados en entornos minoristas y de atención médica.