Bluesky Social, la alternativa descentralizada a las plataformas tradicionales como X (anteriormente Twitter), está lidiando con crecientes críticas a medida que su función de manejo de dominio se convierte en una herramienta para extorsión y suplantación de identidad.

Esta función, diseñada para vincular perfiles de usuario con dominios personalizados para una mayor confianza y visibilidad, ahora está siendo utilizada indebidamente por estafadores para explotar a personas destacadas, exponiendo importantes lagunas en el sistema de moderación de Bluesky. Esto plantea preguntas críticas sobre la viabilidad de los modelos de moderación descentralizados en la gestión de plataformas a gran escala.

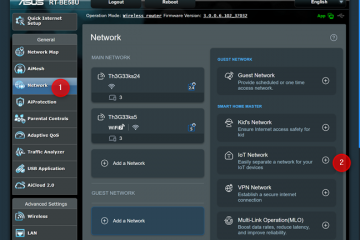

La mecánica de la explotación del control de dominios

El dominio único La función de manejo en Bluesky permite a los usuarios integrar su identidad con nombres de dominio personalizados, presentando una forma innovadora de verificar y mostrar perfiles. Sin embargo, este sistema se ha convertido en un arma de doble filo.

Los estafadores han aprovechado la oportunidad para hacerse pasar por usuarios de alto perfil comprando dominios vinculados a sus identidades. Estos dominios luego se utilizan para crear perfiles falsos que apuntan a sus contrapartes reales para extorsionarlos.

El columnista de Bloomberg Conor Sen fue víctima de este esquema cuando un estafador compró un dominio que imitaba su nombre e intentó vendérselo a él por una suma exorbitante. El intento de extorsión puso de relieve no sólo los peligros de unas salvaguardias inadecuadas sino también la lucha de Bluesky por actuar con rapidez contra tales abusos.

Parece que un tipo está intentando extorsionar aquí:

— Conor Sen (@conorsen.bsky.social) 17 de diciembre de 2024 a las 1:47 a.m.

Del mismo modo, El empresario Sam Parr fue objeto de un plan que involucraba cuentas falsas y títeres. tácticas, donde los estafadores amplificaron la confusión al difundir información errónea sobre su identidad.

Cuando los moderadores de Bluesky intervinieron, bloquearon por error la cuenta legítima de Parr y dejaron al imitador activo, lo que agravó aún más la situación.

Hola @bluesky: este tipo se está haciendo pasar por mí. ¿De todos modos podemos cerrar esto? https://t.co/BeSis6olLi

— Sam Parr (@thesamparr) 17 de diciembre de 2024

Moderación retrasada y frustración del usuario

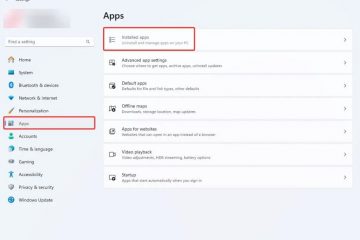

El modelo de moderación descentralizada de Bluesky, que se basa en una gobernanza impulsada por el usuario, ha sido la piedra angular de su identidad. Sin embargo, este modelo ha mostrado limitaciones significativas a la hora de abordar los desafíos que plantean el rápido crecimiento de usuarios y las estafas coordinadas.

Los retrasos en la moderación han frustrado a las víctimas y han generado preocupaciones sobre la preparación de la plataforma para manejar actividades maliciosas a escala. Los críticos argumentan que la falta de un mecanismo de supervisión centralizado contribuye a inconsistencias y errores en la aplicación de la ley, como se vio en los escándalos de suplantación de identidad.

Relacionado: A medida que se dispara el crecimiento de BlueSky, también lo hacen las quejas de los usuarios.

En esencia, la filosofía de gobernanza de Bluesky enfatiza la descentralización, otorgando a los usuarios y comunidades el poder de definir y hacer cumplir sus propias reglas de moderación. Los representantes de Bluesky enfatizan su visión de permitir que las comunidades se gobiernen a sí mismas utilizando herramientas de moderación que reflejen sus valores y necesidades específicas.

Este modelo prioriza la autonomía y la flexibilidad, ofreciendo herramientas como listas de moderación y filtrado colaborativo de contenido. Si bien estas características tienen como objetivo ofrecer un sentido de propiedad entre los usuarios, también introducen fragmentación e ineficiencias, especialmente cuando se necesita una acción rápida y coordinada.

Herramientas tecnológicas: un arma de doble filo

Bluesky ha buscado abordar los desafíos de moderación a través de una combinación de herramientas avanzadas y procesos impulsados por el usuario. Dos componentes clave de su infraestructura de moderación son las herramientas de Ozone y Thorn, que desempeñan funciones fundamentales en la identificación y gestión de contenido dañino.

Ozone es la herramienta de etiquetado colaborativo de Bluesky que permite a grupos de moderadores evaluar colectivamente el contenido marcado. Al aprovechar las decisiones grupales, Ozone pretende mejorar la coherencia y precisión de las acciones de moderación y, al mismo tiempo, reducir la dependencia del juicio individual.

Las herramientas de Thorn como Safer, por otro lado, están diseñadas para Detectar proactivamente material de abuso sexual infantil (CSAM) utilizando algoritmos de aprendizaje automático. Estos sistemas minimizan la carga de los moderadores humanos y garantizan que el material dañino se aborde rápidamente.

Relacionado: El ascenso de Bluesky: de proyecto paralelo de Twitter a refugio para usuarios que huyen de X

Si bien estas tecnologías mejoran las capacidades de moderación de Bluesky, parecen insuficientes para contrarrestar la escala y la sofisticación de estafas como la extorsión de dominios.

Fragmentación versus escalabilidad: el dilema central

El modelo descentralizado de la plataforma, si bien es innovador, presenta importantes desafíos de escalabilidad. Por diseño, Bluesky permite a las comunidades crear y hacer cumplir sus propias políticas de moderación.

Este enfoque se alinea con su espíritu de empoderar a los usuarios, pero crea inconsistencias en toda la plataforma. Las prácticas de moderación varían ampliamente entre comunidades, lo que dificulta abordar de manera eficiente problemas multiplataforma, como los esquemas de suplantación de identidad.

La naturaleza descentralizada de la gobernanza de Bluesky también ralentiza las respuestas a amenazas urgentes. En el caso de Conor Sen y Sam Parr, el tiempo necesario para investigar y resolver las quejas de suplantación de identidad socavó la confianza de los usuarios.

Los críticos argumentan que la introducción de un mecanismo de supervisión centralizada para casos de alto riesgo, como fraude de identidad y extorsión, podría mejorar significativamente la capacidad de Bluesky para mantener la seguridad sin comprometer su compromiso más amplio con la descentralización.

Implicaciones más amplias para las redes sociales descentralizadas

Los desafíos de Bluesky resaltan preguntas más amplias sobre la viabilidad de la moderación descentralizada en plataformas a gran escala. Las luchas actuales de la plataforma con los esquemas de suplantación de identidad y extorsión subrayan las dificultades de ampliar un modelo de este tipo garantizando al mismo tiempo la seguridad y la confianza.

Otras plataformas descentralizadas, como Mastodon y Matrix, enfrentan problemas similares, pero han adoptado diversos grados de intervención centralizada para abordar desafíos específicos. Cada instancia de Mastodon puede establecer sus propias políticas de moderación, lo que permite un control localizado sobre el contenido. Matrix utiliza un sistema de identidad federado, similar al correo electrónico, que permite cierto control centralizado a nivel del servidor.

Los incidentes de extorsión en Bluesky plantean preocupaciones sobre la sostenibilidad a largo plazo de la gobernanza descentralizada. Sin un marco unificado para abordar el abuso, Bluesky y plataformas similares corren el riesgo de convertirse en ecosistemas fragmentados donde los malos actores pueden aprovechar las lagunas jurídicas. La dependencia de la plataforma de la moderación impulsada por el usuario puede fomentar un sentido de propiedad comunitaria, pero también introduce vulnerabilidades que los sistemas centralizados están mejor equipados para manejar.