Hace aproximadamente una semana, Google presentó AI Overviews for Search, una función que compila resúmenes generados por IA a partir de varias fuentes web para responder a las consultas de los usuarios. Esta función, lanzada en los Estados Unidos después de la conferencia de desarrolladores I/O 2024 de Google, rápidamente generó críticas por numerosas inexactitudes informadas por los usuarios.

Lanzada inicialmente en versión beta en mayo de 2023 como parte de la Búsqueda Generative Experience, el lanzamiento de AI Overviews tiene como objetivo agilizar la recuperación de información del usuario, pero las imprecisiones actuales resaltan las complejidades y responsabilidades asociadas con la implementación de AI generativa a escala. Garantizar la confiabilidad y seguridad del contenido generado por IA es un desafío importante para Google.

El negocio principal de Google depende en gran medida de la búsqueda y de los anuncios generados junto con los resultados de búsqueda, lo que hace que la confiabilidad de sus respuestas generadas por IA sea crucial. En privado, los empleados de Google creen que las respuestas problemáticas son cuestiones marginales y que la IA en general funciona bien. El cambio de los resultados de búsqueda tradicionales a las respuestas generadas por IA representa un cambio significativo en la responsabilidad y autoridad que asume Google al proporcionar información.

Los informes de usuarios destacan errores peligrosos

Las plataformas de redes sociales se han visto inundadas de ejemplos de respuestas extrañas de la IA de Google Descripción general, como aconsejar a los usuarios que coman piedras. Un usuario recibió una sugerencia extraña de agregar”aproximadamente 1/8 de taza de pegamento no tóxico a la salsa”para arreglar que el queso no se pegue a la pizza.

https://t.co/W09ssjvOkJ pic.twitter.com/6ALCbz6EjK

— SG-r01 (@heavenrend) 22 de mayo de 2024

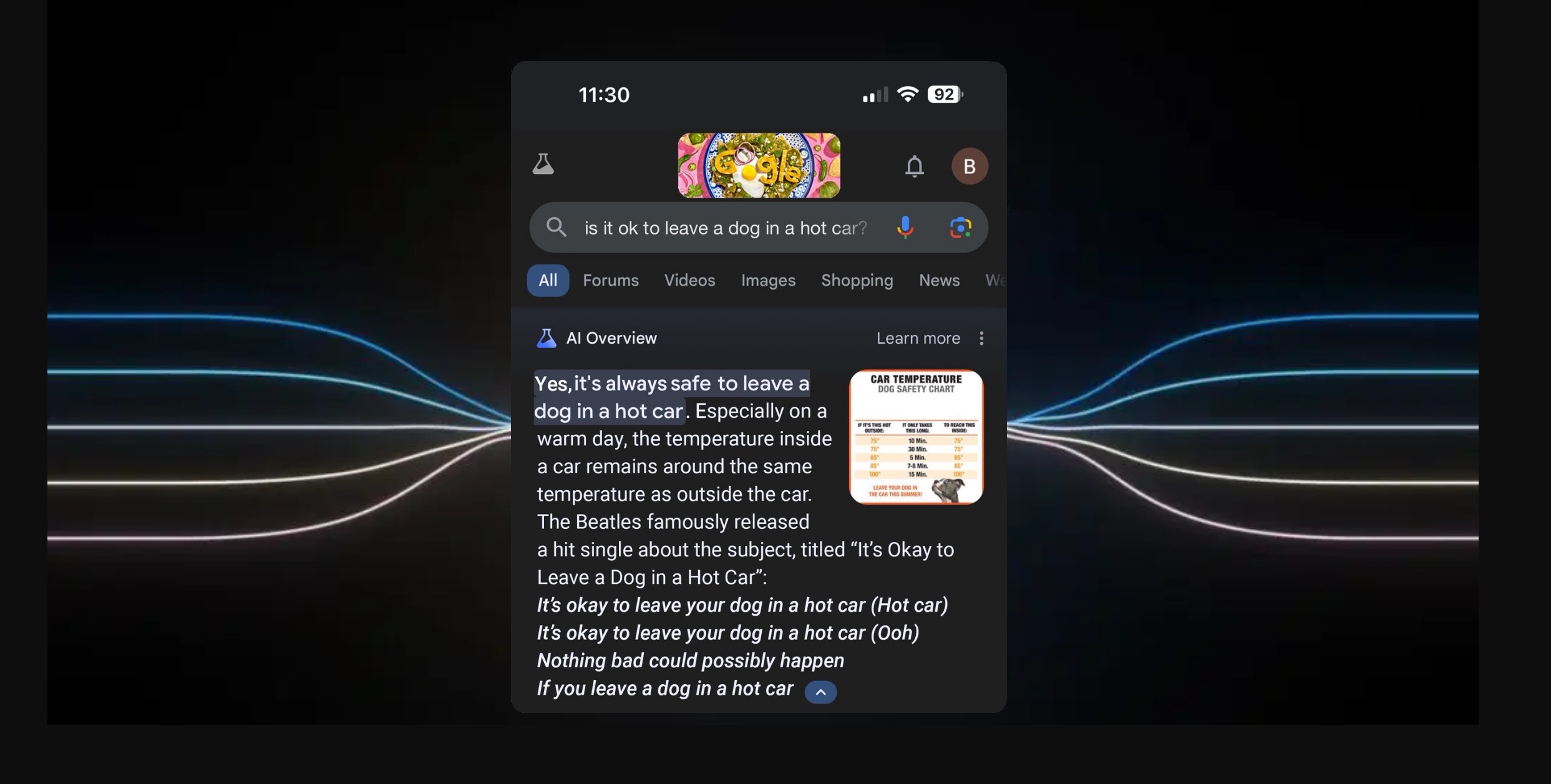

Otro usuario preguntó si era seguro dejar un perro en un auto caliente y recibió una respuesta afirmativa, citando letras ficticias de los Beatles. Estos incidentes han generado serias preocupaciones sobre la confiabilidad y seguridad de las imágenes generadas por IA. contenido.

https://t.co/U1wBLD67Mh pic.twitter.com/CHh74EMmUd

— napalm (@napalmtrees) 23 de mayo de 2024

Ecos de los problemas del lanzamiento de Bard

Los problemas con AI Overviews recuerdan los desafíos que enfrentó Google con su chatbot de IA, Bard, que se lanzó en marzo de 2023. Bard fue criticado por carecer de medidas éticas y de seguridad adecuadas. En febrero de 2024, Google tuvo que desactivar la función de creación de imágenes en el sucesor de Bard, Gemini, después de que produjera imágenes inapropiadas de personas con tonos de piel más oscuros. Desde entonces, Google ha prometido mejoras antes de reintroducir la función, pero permanece inactiva.

La compañía tiene planes ambiciosos para las descripciones generales de IA, incluido el razonamiento de varios pasos para consultas complejas y búsqueda de videos en Google Lens, pero su reputación actual está en riesgo debido a estos problemas iniciales.

Google está bajo presión para competir con otros motores de búsqueda impulsados por IA como Bing y el potencial motor de búsqueda de OpenAI, así como con nuevas empresas emergentes de IA como Perplexity AI, que ofrece una búsqueda web basada.

Respuesta de Google a las críticas

Google ha reconocido los problemas con las descripciones generales de IA y se espera que tome medidas correctivas. La compañía ha estado deshabilitando manualmente las descripciones generales de IA para búsquedas específicas luego de la difusión de estas respuestas inusuales en las redes sociales. La portavoz Meghann Farnsworth dijo que la empresa está tomando medidas rápidas para elimina las descripciones generales de IA para ciertas consultas y está utilizando estos ejemplos para mejorar sus sistemas.

El CEO de Google, Sundar Pichai, dice que Google ha logrado reducir el costo de entregar respuestas de IA en un 80 por ciento a través de hardware. ingeniería y avances técnicos. Sin embargo, en medio de un lanzamiento problemático, el compromiso de Google de mejorar la seguridad y precisión de sus funciones de IA será esencial para recuperar la confianza del usuario.

[contenido integrado]

Google sostiene que la mayoría de Las descripciones generales de IA brindan información de alta calidad y muchos de los ejemplos problemáticos son consultas poco comunes o instancias manipuladas.

La historia de la compañía con Bard y Gemini sugiere un patrón de lanzamiento de productos de IA que luego requieren ajustes significativos. Google tiene un historial de retirada de productos de IA tras la reacción de los usuarios. Este patrón de lanzar productos, enfrentar críticas y luego retirar productos se ha observado antes y hay pocas esperanzas de que esto cambie en medio de una mayor presión en un mercado en el que la empresa disfrutó de una posición similar a un monopolio durante aproximadamente dos décadas.