Kuaishou, una importante plataforma de videos cortos con sede en Beijing, dio a conocer su modelo de lenguaje grande de desarrollo propio llamado KwaiYii al público la semana pasada, según un informe de informe de TechNode. Además, la empresa también dio a conocer su investigación sobre Spiking Neural Networks y el desarrollo de SpikeGPT.

Este lanzamiento llega después de una fase de prueba beta. para un servicio similar a ChatGPT para dispositivos Android que comenzó el 18 de agosto. El servicio de diálogo, que cuenta con 13 000 millones de parámetros enraizados en KwaiYii, compite con OpenAI GPT-3.5 en su capacidad de creación de contenido, consulta y resolución de problemas.

El LLM se detalla en la página GitHub de KwaiYii. La aplicación principal para el chatbot de IA de Kuaishou ha sido la búsqueda, utilizando contenido original de la plataforma para abordar las”alucinaciones”de IA: imprecisiones resultantes de un entrenamiento de datos inadecuado.

SpikeGPT: un salto en la eficiencia energética

Kuaishou se está posicionando como una fuerza importante en Investigación y desarrollo de IA, tanto en productos públicos convencionales como en proyectos de I+D. KwaiYii es un ejemplo de la IA pública convencional, mientras que Kuaishou también discutió esta semana sobre SpikeGPT, un ejemplo de sus esfuerzos de investigación de IA.

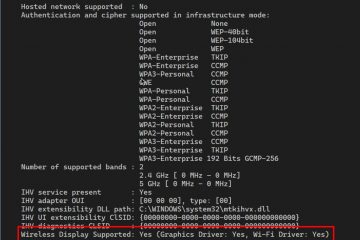

Las demandas computacionales de los modelos contemporáneos de lenguaje extenso (LLM) son sustanciales. Sin embargo, las Spiking Neural Networks (SNN) se han identificado como una fuente de energía más alternativa eficiente a las redes neuronales artificiales convencionales, aunque su eficacia en las tareas de generación de lenguaje sigue sin explorarse.

Una colaboración de investigación entre la Universidad de California y Kuaishou Technology ha presentado SpikeGPT (a través de Revisión sincronizada), la revisión inaugural Modelo de lenguaje de red neuronal de picos generativos (SNN). Este modelo, con su versión de parámetros de 260M, iguala el rendimiento de las redes neuronales profundas (DNN ) al tiempo que conserva los beneficios de ahorro de energía de los cálculos basados en picos.

SpikeGPT es un modelo de lenguaje generativo caracterizado por unidades de activación de picos puramente binarias impulsadas por eventos. Integra recurrencia en un bloque transformador, haciéndolo compatible con SNN. Esta integración no solo elimina la complejidad computacional cuadrática, sino que también facilita la representación de palabras como picos impulsados por eventos.

El modelo puede procesar datos de transmisión palabra por palabra, iniciando el cálculo incluso antes de la formación de una oración completa. sin dejar de capturar las dependencias de largo alcance en estructuras sintácticas intrincadas. El equipo de investigación también incorporó varias técnicas para mejorar el rendimiento de SpikeGPT, como un paso de incrustación binaria, un operador de cambio de token y un RWKV estándar para reemplazar el mecanismo tradicional de autoatención.

Comprender Spiking Redes neuronales

Las redes neuronales de picos (SNN) son un tipo de red neuronal artificial inspirada en la forma en que funcionan las neuronas biológicas. En los SNN, las neuronas se comunican entre sí enviando picos, que son ráfagas cortas de actividad eléctrica. Los picos no son continuos, sino que ocurren en intervalos de tiempo discretos. Esto contrasta con las redes neuronales artificiales tradicionales, que usan valores continuos para representar la activación de las neuronas.

Los SNN tienen varias ventajas potenciales sobre las redes neuronales artificiales tradicionales. En primer lugar, son más eficientes energéticamente. Esto se debe a que los picos solo se envían cuando es necesario, en lugar de hacerlo de forma continua. En segundo lugar, los SNN son biológicamente más realistas. Esto los convierte en una buena opción para aplicaciones que requieren un alto grado de realismo, como robótica e imágenes médicas.

Sin embargo, los SNN también enfrentan algunos desafíos. Un desafío es que son más difíciles de entrenar que las redes neuronales artificiales tradicionales. Esto se debe a que los picos son eventos discretos, lo que dificulta la retropropagación del error a través de la red. Otro desafío es que los SNN no se entienden tan bien como las redes neuronales artificiales tradicionales. Esto dificulta el diseño y la optimización de SNN para tareas específicas.

Cómo funciona SpikeGPT

En un estudio empírico, SpikeGPT se entrenó con tres escalas de parámetros diferentes (parámetros 45M, 125M y 260M) y se comparó con líneas base de transformadores como Reformer, Synthesizer, Linear Transformer y Performer utilizando el conjunto de datos Enwik8. Los resultados revelaron que SpikeGPT entregó resultados comparables con 22 veces menos operaciones sinápticas (SynOps).

Esta investigación subraya el potencial de entrenar grandes SNN para aprovechar los avances en los transformadores, lo que sugiere una reducción significativa en las demandas computacionales de los LLM. mediante la aplicación de activaciones de spiking impulsadas por eventos a la generación de lenguaje. Los investigadores han expresado su intención de continuar refinando su modelo y actualizarán su documento de preimpresión en consecuencia. El código para SpikeGPT está disponible en el GitHub del proyecto, y Se puede acceder al documento que detalla el modelo en arXiv.