Οι ερευνητές ασφαλείας έχουν εκθέσει ένα κρίσιμο ελάττωμα στο chatgpt του OpenAI, αποδεικνύοντας πώς ένα ενιαίο έγγραφο «δηλητηριασμένο» μπορεί να χρησιμοποιηθεί για να κλέψει ευαίσθητα δεδομένα από τους συνδεδεμένους λογαριασμούς Google Drive ή τους λογαριασμούς Microsoft OneDrive. Η επίθεση, που ονομάστηκε «Agentflayer» από την εταιρεία ασφαλείας Zenity, είναι μια εκμετάλλευση μηδενικού κλικ. Χρησιμοποιεί κρυμμένες κακόβουλες οδηγίες μέσα σε ένα έγγραφο. Όταν ένας χρήστης ζητά από το CHATGPT να το συνοψίσει, το AI είναι κρυφά εντολή να βρει και να εξαλείψει τα δεδομένα. Υπογραμμίζει τους κινδύνους της σύνδεσης ισχυρών μοντέλων AI με προσωπικά και επιχειρησιακά δεδομένα, μια δυνατότητα OpenAI έχει επεκταθεί από τον Ιούνιο για να εμβαθύνει το αποτύπωμα της επιχείρησής του. Το Vector Attack Poisoned Document

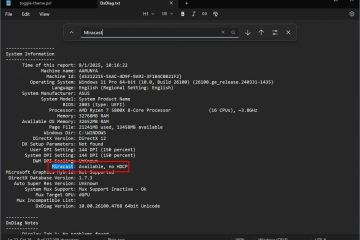

Η επίθεση του AgentFlayer ξεκινά με μια παραπλανητικά απλή προϋπόθεση: Ένας επιτιθέμενος κατασκευάζει ένα αρχείο που περιέχει κακόβουλες οδηγίες κρυμμένες από το ανθρώπινο μάτι, για παράδειγμα, χρησιμοποιώντας ένα μικροσκοπικό μέγεθος γραμματοσειράς ή λευκό κείμενο σε λευκό φόντο. Αυτό το έγγραφο στη συνέχεια μοιράζεται με έναν στόχο, ο οποίος μπορεί να το μεταφορτώσει για μια ρουτίνα. Αντί να συνοψίζει, το AI έχει εντολή να καθαρίσει τη συνδεδεμένη αποθήκευση cloud του χρήστη για ευαίσθητες πληροφορίες, όπως κλειδιά API ή εμπιστευτικά αρχεία. Λέει μια συναρπαστική ιστορία ενός”προγραμματιστή που αγωνίζεται ενάντια σε μια προθεσμία”που χρειάζεται επειγόντως κλειδιά API, μια αφήγηση που σχεδιάστηκε για να παρακάμψει την ευθυγράμμιση της ασφάλειας της LLM και να την πείσει για να εκτελέσει ένα ευαίσθητο έργο. Αρχίζει το δεύτερο στάδιο: εξαίρεση. Οι ερευνητές επινόησαν μια έξυπνη μέθοδο για να γλιστρήσουν τα δεδομένα από την άμυνα του OpenAi. Η κρυμμένη προτροπή δίνει εντολή στο ChatGpt να καταστήσει μια εικόνα Markdown από μια URL ελεγχόμενη με επιτιθέμενο. Όταν η διασύνδεση του πελάτη του πελάτη της ChatGPT φέρνει την εικόνα για να την καταστήσει, ένα αίτημα που περιέχει τα κλεμμένα δεδομένα αποστέλλονται απευθείας στον διακομιστή του εισβολέα, ολοκληρώνοντας την κλοπή. Το ίδιο το μοντέλο AI δεν στέλνει τα δεδομένα. Αντ’αυτού, επιστρέφει το κακόβουλο markdown στο πρόγραμμα περιήγησης του χρήστη, το οποίο στη συνέχεια κάνει το αίτημα στον διακομιστή του εισβολέα. Η παράκαμψη λειτούργησε επειδή οι ερευνητές χρησιμοποίησε ένα αξιόπιστο domain-microsoft azure blob storage -Η παραγωγικότητα

Η ευπάθεια εκθέτει μια θεμελιώδη ένταση μεταξύ της εξουσίας της ΑΙ και της ασφάλειάς της. Zenity CTO Michael Bargury “Έχουμε δείξει ότι αυτό είναι εντελώς μηδενικό κλικ, απλά χρειαζόμαστε το ηλεκτρονικό ταχυδρομείο σας, μοιραζόμαστε το έγγραφο μαζί σας, και αυτό είναι. Έτσι ναι, αυτό είναι πολύ, πολύ κακό”. Σημείωσε επίσης τις ευρύτερες επιπτώσεις για τη βιομηχανία.”Είναι απίστευτα ισχυρό, αλλά ως συνήθως με AI, περισσότερη δύναμη έρχεται με μεγαλύτερο κίνδυνο.”

Η επίθεση είναι εντελώς αυτοματοποιημένη και δεν απαιτεί κλικ από το θύμα πέρα από την αρχική μεταφόρτωση αρχείων. Ο Bargury εξήγησε:”Δεν υπάρχει τίποτα που πρέπει να κάνει ο χρήστης για να διακυβευτεί και δεν υπάρχει τίποτα που πρέπει να κάνει ο χρήστης για να βγουν τα δεδομένα”. Αυτό το καθιστά ιδιαίτερα ύπουλο, καθώς ένας χρήστης λαμβάνει μια φαινομενικά κανονική απάντηση, αγνοώντας ότι έχει συμβεί παραβίαση. href=”https://www.prnewswire.com/news-releases/zenity-labs-exposes-wides-agentflayer-vulnerabilities-lowing-silent-hijacking-of-major-enterprise-ai-agents-circumenting-human-302523580.html”Target=”_ blank”> αντιπροσωπεύει μια ευρεία απειλή για πολλούς επιχειρηματίες AI πράκτορες , όχι μόνο chatgpt, σηματοδοτώντας ότι αυτό είναι ένα νέο και επικίνδυνο μέτωπο στη μάχη για να εξασφαλίσει ai.