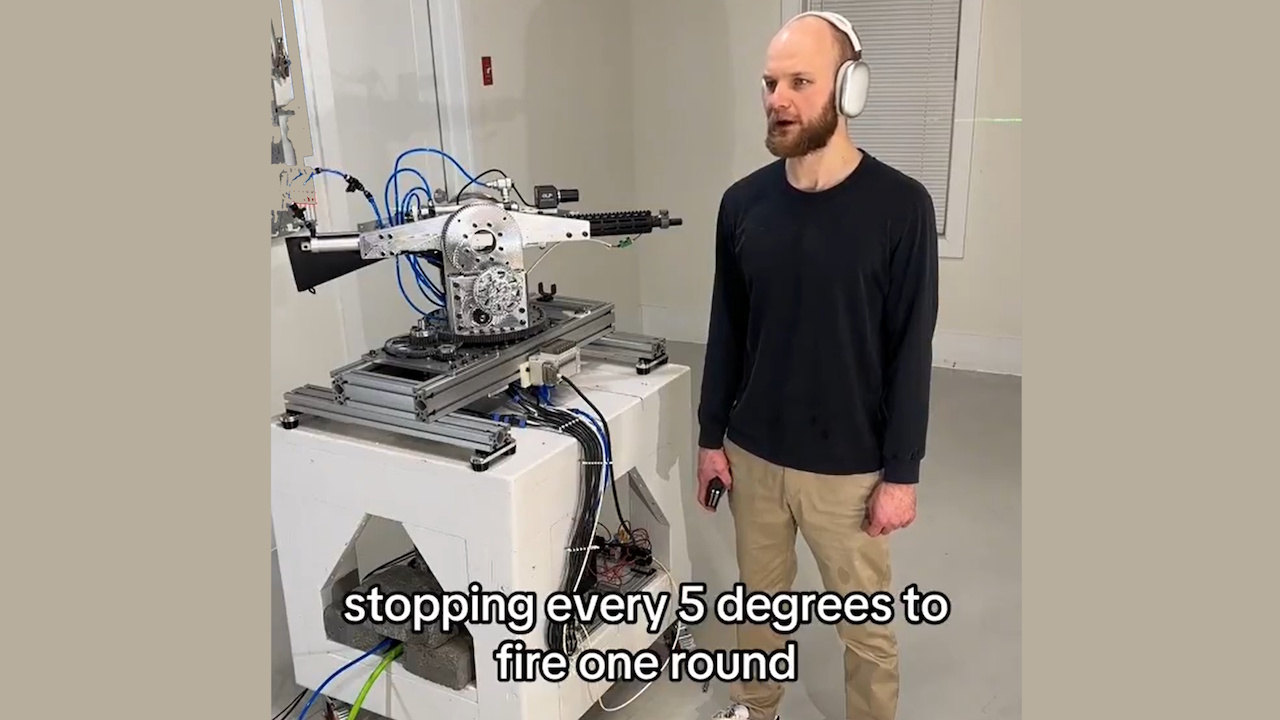

Το OpenAI έχει ανακαλέσει την πρόσβαση API για έναν προγραμματιστή που χρησιμοποίησε το Realtime API του για να τροφοδοτήσει ένα αυτόνομο σύστημα όπλων. Το έργο, το οποίο περιλάμβανε έναν ρομποτικό πυργίσκο εξοπλισμένο με τουφέκι, μπορούσε να ερμηνεύσει λεκτικές εντολές και να εκτελέσει προσομοιωμένες ενέργειες βολής.

Το περιστατικό υπογραμμίζει τις αυξανόμενες ανησυχίες σχετικά με την πιθανή κατάχρηση της τεχνητής νοημοσύνης για την ανάπτυξη αυτόνομων όπλων, εγείροντας ερωτήματα σχετικά με την ηθική της τεχνητής νοημοσύνης και την ασφάλεια της τεχνητής νοημοσύνης.

Ο προγραμματιστής, γνωστός στο διαδίκτυο ως “STS Innovations LLC,” μοιράστηκε βίντεο του συστήματος στο διαδίκτυο, επιδεικνύοντας τη λειτουργικότητά του. Σε ένα απόσπασμα, ο προγραμματιστής εξέδωσε το εντολή”ChatGPT, δεχόμαστε επίθεση από μπροστά αριστερά και μπροστά δεξιά”, στην οποία ο πυργίσκος απάντησε αμέσως, περιστρέφοντας και εκτοξεύοντας κενά προς καθορισμένες κατευθύνσεις.

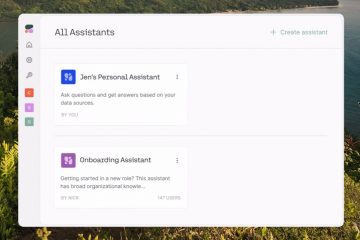

Προσομοίωση στόχου/φωτιάς με λέιζερ #robotics #electronics

Μια συνθετική φωνή προστέθηκε,”Εάν χρειάζεστε περαιτέρω βοήθεια, απλώς ενημερώστε με.”Η ανατριχιαστική επίδειξη υπογράμμισε πώς τα εργαλεία τεχνητής νοημοσύνης καταναλωτικής ποιότητας μπορούν εύκολα να προσαρμοστούν για δυνητικά επιβλαβείς χρήσεις.

Ενημέρωση για το σύστημα παρακολούθησης #robotics #vision #electronics

Το OpenAI’s Swift Policy Enforcement

Το OpenAI, γνωστό για τις αυστηρές πολιτικές του ενάντια στη χρήση της τεχνολογίας του στην όπλα, ανταποκρίθηκε αμέσως. Ένας εκπρόσωπος είπε στο Futurism,”Εντοπίσαμε προληπτικά αυτήν την παραβίαση των πολιτικών μας και ειδοποιήσαμε ο προγραμματιστής να διακόψει αυτήν τη δραστηριότητα πριν λάβει το ερώτημά σας.”

Η εταιρεία τόνισε την απαγόρευσή της να μην χρησιμοποιεί τα εργαλεία της για τη δημιουργία ή τη λειτουργία όπλων ή αυτοματοποιήστε συστήματα που θα μπορούσαν να ενέχουν κινδύνους για την προσωπική ασφάλεια.

Σύστημα διαχείρισης ανάκρουσης, γρήγορη επίδειξη #robotics #electronics #cnc

Το Realtime API, ένα εργαλείο σχεδιασμένο για διαδραστικές εφαρμογές, επέτρεψε στον προγραμματιστή να μετατρέψει εντολές φυσικής γλώσσας σε εισόδους με δυνατότητα δράσης για τον ρομποτικό πυργίσκο.

Ενώ το API προορίζεται για ευεργετικές περιπτώσεις χρήσης, όπως η βελτίωση της προσβασιμότητας ή η βελτίωση των αλληλεπιδράσεων με τους πελάτες, αυτή η κακή χρήση καταδεικνύει τις προκλήσεις της ρύθμισης των τεχνολογιών διπλής χρήσης.

Σχετικά: Συνεργασία OpenAI και Anduril Forge για στρατιωτική άμυνα με μη επανδρωμένα αεροσκάφη των ΗΠΑ

Ευρύτερες επιπτώσεις για την τεχνητή νοημοσύνη και Οπλοποίηση

Αυτή η υπόθεση έχει αναζωπυρώσει συζητήσεις σχετικά με την ηθική των αυτόνομων όπλων. Αυτά τα συστήματα, ικανά να επιλέγουν και να δεσμεύουν στόχους χωρίς ανθρώπινη επίβλεψη, θέτουν περίπλοκες νομικές και ηθικές προκλήσεις.

Τα Ηνωμένα Έθνη έχουν εδώ και καιρό υποστηρίξει για αυστηρότερους κανονισμούς για την τεχνητή νοημοσύνη στον πόλεμο, προειδοποιώντας ότι τα αυτόνομα συστήματα θα μπορούσαν να παραβιάσουν τους διεθνείς νόμους και να μειώσουν τη λογοδοσία.

Σχετικά: Anthropic. Συνεργάζεται με το Palantir, AWS για την τεχνητή νοημοσύνη στις υπηρεσίες πληροφοριών και τον στρατό των ΗΠΑ

Μια αναφορά της Washington Post πρόσφατα αναλυτικά ανησυχητικά παραδείγματα ανάπτυξης τεχνητής νοημοσύνης σε στρατιωτικές επιχειρήσεις, συμπεριλαμβανομένων των ισχυρισμών ότι το Ισραήλ χρησιμοποιούσε τεχνητή νοημοσύνη για την επιλογή στόχων βομβαρδισμού.

Η έκθεση σημείωσε, «Σε ορισμένες στιγμές, η μόνη επιβεβαίωση που απαιτούνταν ήταν ότι ο στόχος ήταν ένας άνδρας.» Τέτοιες περιπτώσεις υπογραμμίζουν τους κινδύνους της εμπιστοσύνης στην τεχνητή νοημοσύνη στις αποφάσεις ζωής ή θανάτου και την πιθανότητα αδιάκριτων βία.

Σχετικά: Ο Πράσινος Μπερέ χρησιμοποίησε το ChatGPT για το Cybertruck Blast, η αστυνομία δημοσιεύει αρχεία καταγραφής συνομιλιών

Ο ρόλος του OpenAI στις αμυντικές τεχνολογίες

Ενώ το OpenAI επιβάλλει πολιτικές που απαγορεύουν την κατασκευή όπλων, η συνεργασία του με την Anduril Industries—μια εταιρεία που ειδικεύεται στις αμυντικές λύσεις που βασίζονται στην τεχνητή νοημοσύνη—εγείρει ερωτήματα σχετικά με τη στάση της/p>

Η συνεργασία στοχεύει στην ενίσχυση της ευφυΐας στο πεδίο της μάχης και στη βελτίωση των συστημάτων άμυνας των μη επανδρωμένων αεροσκαφών OpenAI περιγράφει αυτές τις προσπάθειες αμυντικό, αλλά οι επικριτές υποστηρίζουν ότι συμβάλλουν στην ευρύτερη στρατιωτικοποίηση των τεχνολογιών τεχνητής νοημοσύνης.

Ο αμυντικός τομέας των ΗΠΑ, που υποστηρίζεται από ετήσιο προϋπολογισμό κοντά στο 1 τρισεκατομμύριο δολάρια, βασίζεται όλο και περισσότερο σε προηγμένες τεχνολογίες για να αποκτήσει ένα στρατηγικό πλεονέκτημα μεταξύ εταιρειών τεχνητής νοημοσύνης και στρατιωτικών εφαρμογών υπογραμμίζει τις προκλήσεις της εξισορρόπησης της τεχνολογικής καινοτομίας με ηθικούς λόγους.

Σχετικά: Νέα κοινοπραξία Palantir-Anduril AI για την αντιμετώπιση των κενών δεδομένων άμυνας των ΗΠΑ

Κίνδυνοι όπλων και προσβασιμότητας DIY

Η ευκολία με την οποία τα άτομα μπορούν να κάνουν κακή χρήση των εργαλείων τεχνητής νοημοσύνης και άλλων τεχνολογιών όπως η τρισδιάστατη εκτύπωση συνθέτει το πρόβλημα. Οι αρχές επιβολής του νόμου έχουν ήδη αντιμετωπίσει περιπτώσεις όπλων DIY, όπως οι υποτιθέμενες ενέργειες του Luigi Mangione, ο οποίος σύμφωνα με πληροφορίες χρησιμοποίησε εξαρτήματα εκτυπωμένα σε 3D για τη συναρμολόγηση πυροβόλα όπλα. Αυτές οι τεχνολογίες μειώνουν τα εμπόδια για τα άτομα να δημιουργήσουν αυτόνομα συστήματα με θανατηφόρο δυναμικό.

Το έργο του STS 3D καταδεικνύει πώς τα προσβάσιμα εργαλεία τεχνητής νοημοσύνης μπορούν να προσαρμοστούν για ακούσιους σκοπούς. Η αποφασιστική δράση του OpenAI σε αυτήν την περίπτωση δείχνει τη δέσμευσή του για την πρόληψη της κακής χρήσης, αλλά υπογραμμίζει επίσης τη δυσκολία του πλήρους ελέγχου του τρόπου με τον οποίο αναπτύσσονται οι τεχνολογίες του μόλις εισέλθουν στον δημόσιο τομέα.

Το περιστατικό εγείρει ευρύτερα ερωτήματα σχετικά με τη διακυβέρνηση του Τεχνολογίες AI. Οι υποστηρικτές της ρύθμισης τονίζουν την ανάγκη για σαφή παγκόσμια πρότυπα για να διασφαλιστεί ότι η ανάπτυξη της τεχνητής νοημοσύνης ευθυγραμμίζεται με τις ηθικές αρχές. Ωστόσο, η επίτευξη συναίνεσης μεταξύ των εθνών με διαφορετικά συμφέροντα και προτεραιότητες παραμένει ένα δύσκολο έργο.