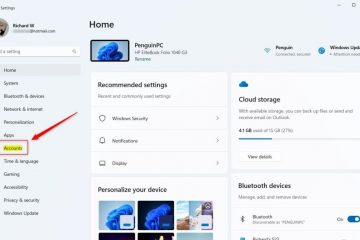

Google nutzt die virale Dynamik seines viralen „Nano Banana“-Modells und hat das Tool offiziell als Gemini 3 Pro Image auf den Markt gebracht und so ein Meme in eine zentrale Enterprise-Engine verwandelt.

Die Veröffentlichung wird am Donnerstag für Google AI Studio, die Gemini App, die neue Antigravity IDE, die Gemini API und Google Ads eingeführt und integriert „Deep Think“-Argumentation, um Entwicklern und Vermarktern eine detaillierte Kontrolle über Physik, Beleuchtung und Textwiedergabe zu ermöglichen.

Durch die direkte Einbettung dieser Funktionen in professionelle Arbeitsabläufe geht Google über die einfache Bildgenerierung hinaus und fordert Adobe und Midjourney mit einem Tool heraus, das für die komplexe, logikgesteuerte Erstellung kommerzieller Assets entwickelt wurde.

Dieses Update erscheint nur wenige Tage nach der Einführung von Gemini 3 Pro und der Antigravity IDE und bestätigt den aggressiven Veröffentlichungsplan, der Anfang dieses Monats durchgesickert ist.

Während die zugrunde liegende Technologie offiziell Gemini 3 Pro Image heißt, hat Google das von der Community betriebene „Nano Banana Pro“-Branding übernommen und damit die seltene Bereitschaft signalisiert, die Internetkultur zu übernehmen, um die Akzeptanz voranzutreiben.

Deep Think: Reasoning Meets Pixel Physik

Gemini 3 Pro Image geht über frühere Iterationen hinaus, die ausschließlich auf der Pixelwahrscheinlichkeit beruhten, und integriert die erstmals im Gemini 3-Textmodell eingeführten „Deep Think“-Argumentationsfunktionen.

Eine solche Architektur wendet logische Konsistenz auf die visuelle Physik an und ermöglicht es dem Modell, die zu verstehen und zu manipulieren zugrunde liegende Eigenschaften einer Szene, anstatt nur ein statisches Bild zu erzeugen.

Benutzer können jetzt eine detaillierte Kontrolle über Umgebungsfaktoren ausüben, die Beleuchtungsrichtung manipulieren, Kamerawinkel anpassen, die Bokeh-Tiefe modifizieren und spezifische Farbabstufungen mit einer Präzision anwenden, die physische Fotografie nachahmt.

Alisa Fortin, Produktmanagerin bei DeepMind, erklärte: „Mit Gemini 3 Pro Image haben Sie die Kontrolle über die Physik … und die Komposition des Bildes, um Ergebnisse in professioneller Qualität zu gewährleisten.“

Über die Umgebungskontrollen hinaus wurde die Kompositions-Engine des Modells erheblich erweitert. Das Zusammenfügen von bis zu 14 verschiedenen Eingabebildern zu einer einzigen zusammenhängenden Szene wird jetzt unterstützt. Diese Funktion soll die Erstellung komplexer Marketing-Assets optimieren, die mehrere Produktaufnahmen und Hintergrundelemente erfordern.

[eingebetteter Inhalt]

Die Zeichenkonsistenz, ein historisches Problem der generativen KI, wurde ebenfalls behoben. Es ist jetzt möglich, die Ähnlichkeit von bis zu fünf separaten Motiven in einem einzigen Bild beizubehalten, was die Erstellung aufeinanderfolgender Erzählungen oder Gruppenaufnahmen ohne die unheimliche Drift ermöglicht, die oft bei KI-generierten Charakteren auftritt.

Die Textwiedergabe wurde grundlegend überarbeitet und zielt auf eine bestimmte Schwachstelle in älteren Modellen ab. Getreuer, lesbarer Text in mehreren Sprachen ist jetzt ein Kernmerkmal.

In einer Demonstration übersetzte das Modell erfolgreich Etiketten auf einer Getränkedose und behielt dabei die ursprüngliche Beleuchtung, Krümmung und Textur des Behälters bei, eine Aufgabe, die normalerweise eine manuelle Nachbearbeitung in Tools wie Photoshop erfordert.

Lokale Bearbeitungsfunktionen verbessern diesen Workflow zusätzlich. Eine neue Funktion zum „Auswählen, Verfeinern, Transformieren“ ermöglicht es Erstellern, bestimmte Elemente zu modifizieren, z. B. die Farbe einer Krawatte zu ändern oder ein Hintergrundobjekt zu entfernen, ohne das gesamte Bild neu zu generieren.

Ein solcher zerstörungsfreier Ansatz passt das Tool eher zu herkömmlicher Bearbeitungssoftware als zum „Spielautomaten“-Stil früher generativer Modelle.

Antigravity und der Enterprise Pivot

Entwickler arbeiten am neuen Antigravity Die Umgebung wird im Modell sofort von Nutzen sein. Unter Umgehung einer rein verbraucherorientierten Einführung stellt die Rollout-Strategie das Modell direkt in der neuen Agenten-IDE von Google bereit. Programmieragenten in dieser Umgebung können das Modell nutzen, um detaillierte UI-Modelle und visuelle Assets direkt aus Codekommentaren oder Dokumentation zu generieren.

Die Optimierung der Design-to-Code-Pipeline ist das Hauptziel, damit Entwickler Schnittstellenelemente visualisieren können, bevor sie die Frontend-Implementierung schreiben. Durch die Google Ads-Integration wird das Modell direkt in die Hände von Vermarktern gelegt und die Erstellung von Kampagnen-Assets automatisiert, die bestimmten Markenrichtlinien entsprechen.

Workspace-Benutzer in Google Slides und Vids erhalten außerdem Zugriff auf das Modell zum Generieren von Präsentationsvisualisierungen und Storyboard-Assets. Durch die Einbettung dieser Funktionen in den Unternehmens-Stack wird Gemini 3 Pro Image zu einer Infrastrukturkomponente und nicht zu einem eigenständigen Kreativtool.

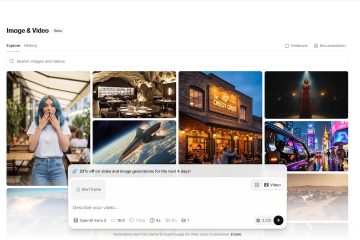

Der Zugriff auf das Modell ist aggressiv abgestuft. Eine begrenzte kostenlose Testversion ist über die Modellauswahl „Thinking“ in der Gemini-App verfügbar, für die dauerhafte Nutzung ist jedoch ein AI Plus-, Pro-oder Ultra-Abonnement erforderlich. Entwickler können über Vertex AI und Entwicklerdokumentation sofort auf das Modell zugreifen, mit spezifischen Endpunkten, die für die kommerzielle Generierung großer Mengen konzipiert sind.

Zur Demonstration dieser Fähigkeiten hat Google Referenzimplementierungen veröffentlicht, darunter einen Comic-Generator und einen Infografik-Ersteller. Diese Beispiele zeigen die Fähigkeit des Modells, sequentielle Logik und Datenvisualisierung zu bewältigen, Aufgaben, die ein höheres Maß an Argumentation erfordern als die Standardbildgenerierung.

Die unsichtbare Leitplanke: SynthID und Sicherheit

Um die Reibung zwischen strengen Sicherheitsprotokollen und professionellem Nutzen zu beseitigen, hat Google eine zweigeteilte Sicherheitsstrategie implementiert. Zum ersten Mal wird das sichtbare „Gemini Sparkle“-Wasserzeichen für Google AI Ultra-und Enterprise-Abonnenten entfernt.

Professionelle Ersteller hatten sich häufig darüber beschwert, dass die sichtbare Markierung Bilder für die endgültige kommerzielle Produktion unbrauchbar machte.

Trotz der Entfernung sichtbarer Markierungen bleibt die unsichtbare SynthID-Wasserzeichentechnologie auf allen Ebenen obligatorisch. Dieses System bettet kryptografische Signaturen direkt in die Pixelwerte ein und stellt so sicher, dass die Herkunft auch dann verfolgt werden kann, wenn das Bild zugeschnitten oder verändert wird.

„Wir haben digitale SynthID-Wasserzeichen direkt in jedes mit Gemini 3 Pro Image erstellte oder bearbeitete Bild integriert, um dessen KI-generierte oder bearbeitete Herkunft zu kennzeichnen“, sagte Fortin.

Die zentrale Herausforderung besteht hier darin, den Bedarf an „sauberen“ kommerziellen Vermögenswerten mit der wachsenden Nachfrage nach Herkunft und Deepfake-Erkennung in Einklang zu bringen. Der Gemini-App wurde eine neue „@SynthID“-Erweiterung hinzugefügt, mit der Benutzer die Herkunft eines Bildes überprüfen können, indem sie nach diesen unsichtbaren Artefakten suchen.

Eine solche Änderung der Richtlinien stellt ein kalkuliertes Risiko dar, da die kryptografische Überprüfung robust genug ist, um einen polizeilichen Missbrauch ohne die visuelle Unordnung eines eingeprägten Wasserzeichens zu ermöglichen.