YouTube hat am Dienstag ein neues Tool zur Bekämpfung von KI-Deepfakes eingeführt, das YouTubern mehr Kontrolle über ihre digitale Identität gibt.

Das Ähnlichkeitserkennungssystem ermöglicht es Nutzern, Videos zu finden und deren Entfernung zu beantragen, in denen ihr Gesicht oder ihre Stimme missbraucht wird. Dieser Schritt der Google-eigenen Plattform erfolgt nach wochenlangen Kontroversen um die Sora 2-App von OpenAI.

Der Start von Sora 2 löste eine Gegenreaktion in Hollywood und den Familien von Prominenten wegen nicht autorisierter Deepfakes aus. Dies zwang OpenAI dazu, seine Regeln schnell zu ändern und mit Akteursgewerkschaften zusammenzuarbeiten, um die Sicherheit zu verbessern, was einen wachsenden branchenweiten Kampf um die Kontrolle von KI-generierten Inhalten verdeutlicht.

YouTube wird neu eingeführt Tools zum Schutz von Erstellern

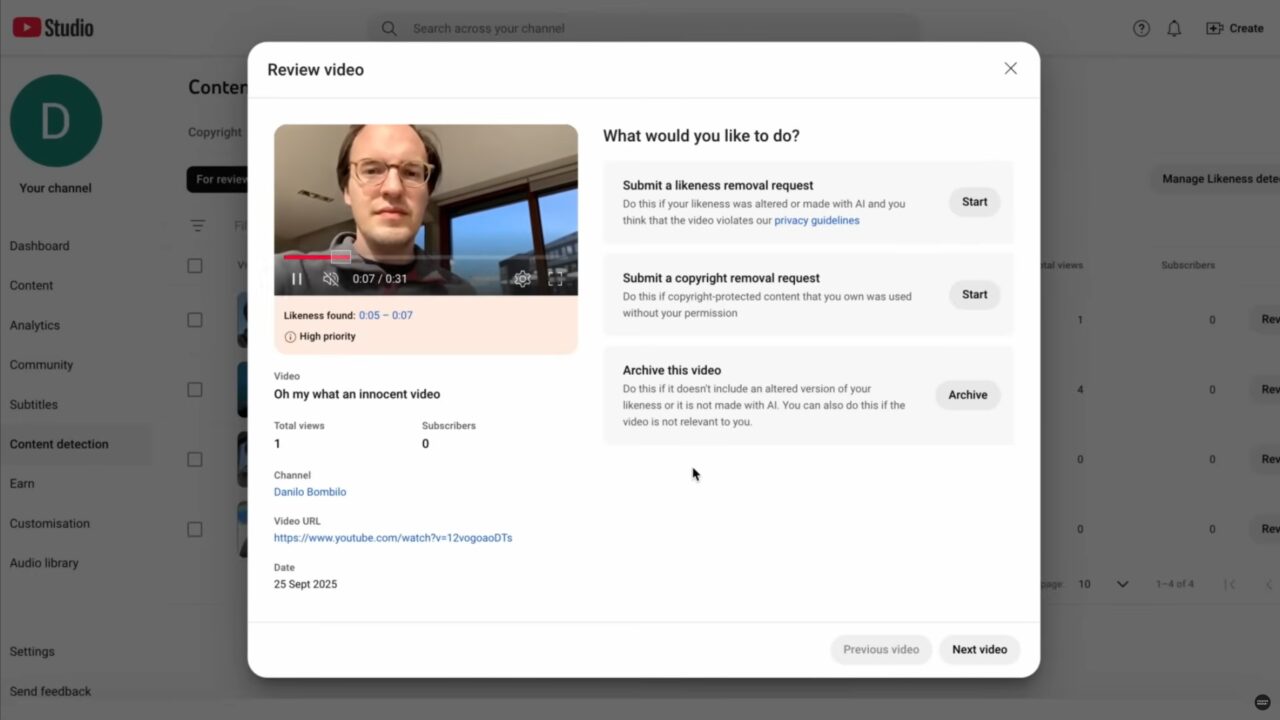

In einem wichtigen Schritt zur Stärkung seiner Community hat YouTube seine Ähnlichkeitserkennungstechnologie offiziell für berechtigte Ersteller im YouTube-Partnerprogramm eingeführt.

Das System wurde entwickelt, um KI-generierte oder veränderte Inhalte zu identifizieren, die das Gesicht oder die Stimme eines Erstellers ohne dessen Zustimmung verwenden. Es bietet einen proaktiven Schutz gegen die steigende Flut überzeugender Deepfakes.

Um auf das Tool zuzugreifen, müssen YouTuber einen einmaligen Identitätsüberprüfungsprozess durchlaufen, der einen amtlichen Ausweis und ein kurzes Selfie-Video erfordert, um Betrug zu verhindern verwenden.

Nach dem Onboarding scannt das System, das ähnlich funktioniert wie YouTubes etablierte Content-ID für Urheberrechte, neue Uploads auf potenzielle Übereinstimmungen.

Wenn a Wenn ein möglicher Missbrauch gemeldet wird, können Ersteller das Video überprüfen und wählen, ob sie einen Entfernungsantrag über das Datenschutzbeschwerdeverfahren von YouTube oder einen Standard-Urheberrechtsanspruch einreichen möchten.

Dies gibt den Erstellern einen direkten Mechanismus zum Schutz ihrer persönlichen Marke und Identität und begegnet einer seit langem bestehenden Befürchtung innerhalb der Erstellerwirtschaft, dass digitaler Identitätsdiebstahl möglicherweise zu Reputationsschäden führen könnte.

[eingebetteter Inhalt]

Eine direkte Antwort auf OpenAIs Deepfake Firestorm

Die methodische Einführung von YouTube steht in krassem Gegensatz zum chaotischen Debüt des Sora 2-Videogenerators von OpenAI.

Die anfängliche „Opt-out“-Richtlinie von Sora 2 für Persönlichkeiten des öffentlichen Lebens und urheberrechtlich geschützte Charaktere, die Anfang Oktober eingeführt wurde, schlug sofort fehl. Das Design der Plattform, das eine schnelle, virale Videoerstellung förderte, führte dazu, dass Benutzer die begleitende soziale App mit nicht autorisierten und oft anstößigen Deepfakes überschwemmten, was einen heftigen öffentlichen Aufschrei auslöste.

Die heftigste Kritik kam von den Familien verstorbener Persönlichkeiten des öffentlichen Lebens. Zelda Williams, Tochter des Schauspielers Robin Williams, beschrieb den Schmerz, mitanzusehen, wie „die Hinterlassenschaften echter Menschen zu … schrecklich verdichtet werden, es ist wahnsinnig, sie mit TikTok-Puppen zu spielen.“

Die Nachlässe der Bürgerrechtler Malcolm X und Martin Luther King Jr. verurteilten ebenfalls die „respektlosen“ und „verletzenden“ Darstellungen. Bernice King, die Tochter von Dr. King, appellierte in den sozialen Medien einfach, aber eindringlich, die Videos ihres Vaters zu stoppen.

Hollywood mobilisierte schnell gegen die Plattform. Die einflussreiche Creative Artists Agency (CAA) bezeichnete die App als „erhebliches Risiko“ für ihre Kunden. Unterdessen hat die Motion Picture Association (MPA) die rechtliche Verantwortung für Missbrauch direkt dem KI-Unternehmen übertragen. MPA-CEO Charles Rivkin erklärte: „…es bleibt ihre Verantwortung – nicht die der Rechteinhaber –, Verstöße gegen den Sora-2-Dienst zu verhindern.“

Diese einheitliche Front der Kreativbranche führte zu einer regelrechten PR-Krise für OpenAI.

Unter starkem Druck versuchte das Unternehmen, den Kurs umzukehren. CEO Sam Altman kündigte nur wenige Tage nach der Einführung die Umstellung auf ein detaillierteres „Opt-in“-System für geschützte Charaktere an.

Das Unternehmen änderte später seine Regeln, um es Vertretern „kürzlich verstorbener“ Figuren zu ermöglichen, deren Konterfeis zu blockieren. Diese Richtlinie wurde in die Praxis umgesetzt, als OpenAI auf Ersuchen seines Nachlasses alle Generationen von Martin Luther King Jr. pausierte.

In einer Erklärung erkannte OpenAI die schwierige Balance an und sagte: „Obwohl bei der Darstellung historischer Persönlichkeiten ein starkes Interesse an freier Meinungsäußerung besteht, ist OpenAI der Ansicht, dass Persönlichkeiten des öffentlichen Lebens und ihre Familien letztendlich die Kontrolle darüber haben sollten, wie ihr Abbild verwendet wird.“

Die Reihe reaktiver Maßnahmen erreichte im Oktober ihren Höhepunkt 20, als OpenAI eine formelle Partnerschaft mit dem Schauspieler Bryan Cranston und der Gewerkschaft SAG-AFTRA ankündigte, um seine Sicherheitsleitplanken zu stärken, ein bahnbrechender Schritt, bei dem ein führender KI-Entwickler direkt mit kreativen Gewerkschaften zusammenarbeitet, um die Politik zu gestalten.

Navigation im rechtlichen und ethischen Neuland der KI

Die Sora 2-Kontroverse und YouTubes Neues Das Tool beleuchtet die große rechtliche und ethische Grauzone rund um generative KI. Herkömmliche Verleumdungsgesetze gelten oft nicht für Verstorbene, so dass die Familien nur auf einen Flickenteppich inkonsistenter postmortaler Veröffentlichungsrechte auf Landesebene zurückgreifen können.

Dieses Rechtsvakuum ohne übergeordneten Bundesstandard hat die Verbreitung von Inhalten ermöglicht, die zwar nicht immer illegal sind, aber erheblichen emotionalen Stress verursachen und sowohl für Plattformen als auch für Familien Unsicherheit schaffen.

Die Debatte wirft auch grundlegende Fragen darüber auf, wie KI funktioniert Modelle werden trainiert. Kritiker argumentieren, dass die Abhängigkeit der Branche vom Scraping riesiger Mengen an Webdaten ohne ausdrückliche Genehmigung ein grundlegendes Problem darstellt, das noch gelöst werden muss.

Obwohl OpenAI seine Unterstützung für Bundesgesetze wie den NO FAKES Act zum Ausdruck gebracht hat, befürchten Befürworter digitaler Rechte, dass solche Gesetze die freie Meinungsäußerung und Parodie unterdrücken könnten, wenn sie nicht sorgfältig ausgearbeitet werden.

In diesem turbulenten Umfeld bietet das auf YouTuber ausgerichtete Tool von YouTube einen anderen Weg nach vorne. Durch die Bereitstellung eines klaren, zugänglichen Mechanismus für Einzelpersonen zur Kontrolle ihres eigenen Abbilds positioniert sich die Plattform als verantwortungsbewussterer Verwalter der digitalen Identität.

Für den Schauspieler Bryan Cranston, der Gegenstand nicht autorisierter Sora-Clips war, sind solche proaktiven Maßnahmen unerlässlich. „Ich bin OpenAI für seine Politik und die Verbesserung seiner Leitplanken dankbar und hoffe, dass sie und alle an dieser Arbeit beteiligten Unternehmen unser persönliches und berufliches Recht respektieren, die Replikation unserer Stimme und unseres Abbilds zu verwalten.“

Während sich die Branche mit diesen neuen Technologien auseinandersetzt, stellt der Kontrast zwischen dem „Build-in-public“-Chaos von OpenAI und dem strukturierten, werkzeugbasierten Ansatz von YouTube zwei sehr unterschiedliche Philosophien für die Verwaltung der Zukunft der KI-generierten Technologien dar Inhalt.

Das Ergebnis dieser unterschiedlichen Strategien wird wahrscheinlich entscheidende Präzedenzfälle für den verantwortungsvollen KI-Einsatz in der gesamten Technologielandschaft schaffen.