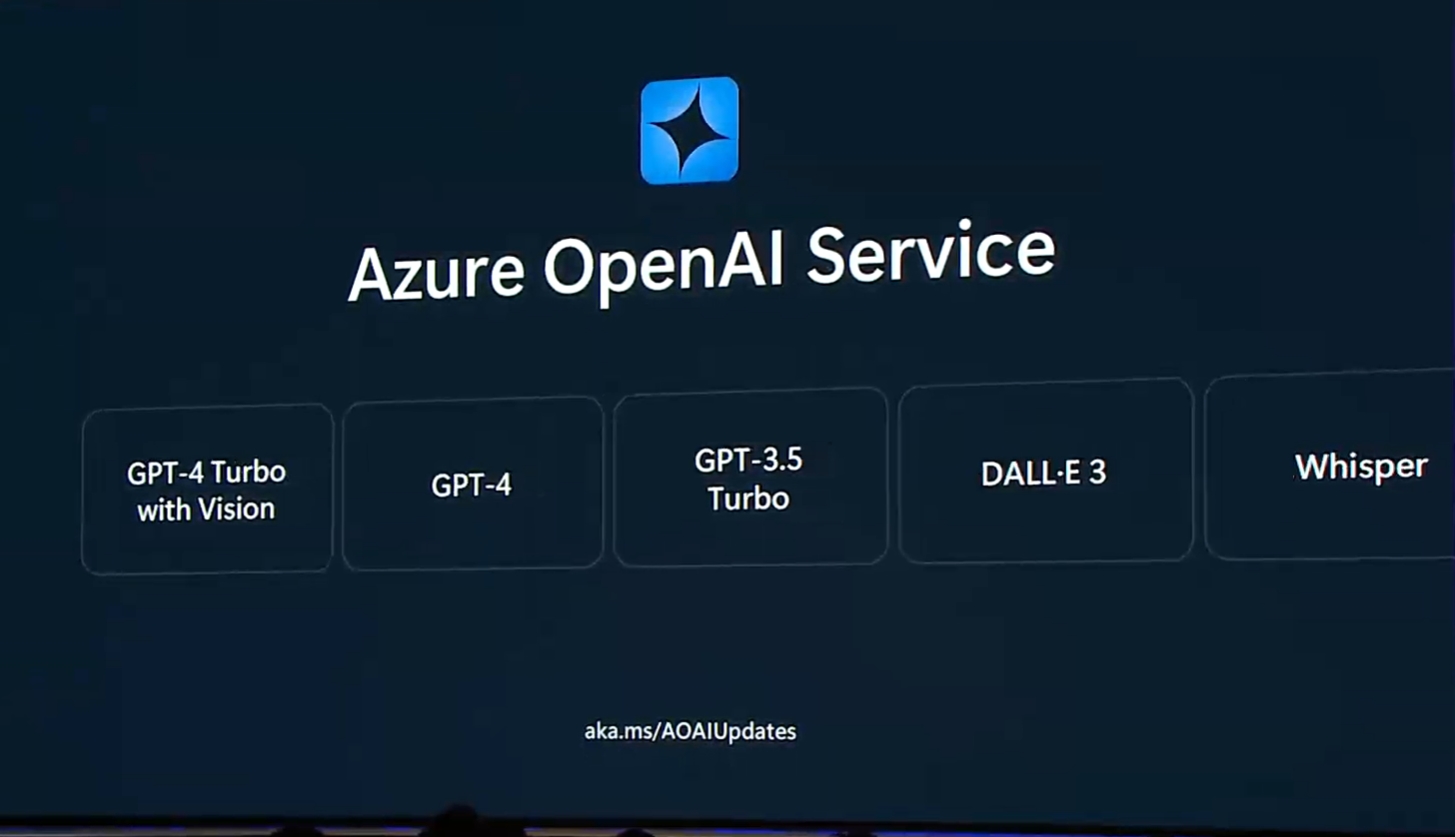

Microsoft hat eine Bundesklage gegen eine nicht identifizierte Gruppe von Cyberkriminellen eingereicht, denen vorgeworfen wird, gestohlene API-Schlüssel zur Umgehung von Sicherheitsprotokollen in seinem Azure OpenAI-Dienst verwendet zu haben.

Laut der Beschwerde Die beim US-Bezirksgericht für den östlichen Bezirk von Virginia eingereichte Klage, die als „Does 1–10“ bezeichnet wird, soll angeblich Tools entwickelt und vertrieben haben um die Systeme von Microsoft auszunutzen und unter Verstoß gegen die Richtlinien schädliche Inhalte zu generieren.

Die rechtlichen Ansprüche umfassen Verstöße gegen den Computerbetrug and Abuse Act (CFAA), dem Digital Millennium Copyright Act (DMCA) und dem Racketeer Influenced and Corrupt Organizations (RICO) Act.

Der Technologieriese behauptet, dass die Gruppe ein ausgeklügeltes Hacking-System betrieben habe, Monetarisierung des unbefugten Zugriffs auf den Azure OpenAI-Dienst durch die Verteilung kundenspezifischer Software, einschließlich einer clientseitigen Anwendung namens „de3u“ und eines Reverse-Proxy-Systems namens „oai Reverse Proxy“.

Mit diesen Tools konnten Benutzer gestohlene Anmeldeinformationen ausnutzen und die erweiterten Sicherheitsmaßnahmen von Microsoft umgehen.

Verwandt: Microsoft sperrt chinesischen Entwicklern den Zugriff auf Azure OpenAI

Die Untersuchung von Microsoft begann im Juli 2024, als das Unternehmen feststellte, dass API-Schlüssel – eindeutige Kennungen zur Authentifizierung von Benutzeranfragen –, die an legitime Azure OpenAI-Kunden ausgegeben wurden, verwendet wurden, um ohne Autorisierung auf seine Systeme zuzugreifen.

Das Unternehmen führte die Aktivität auf eine koordinierte Operation zurück, die auf mehrere Kunden abzielte, darunter mehrere in den USA ansässige Unternehmen.

„Die genaue Art und Weise, wie die Beklagten alle API-Schlüssel erhielten, die sie trugen.“ „Das in dieser Klage beschriebene Fehlverhalten ist unbekannt“, erklärte Microsoft in seiner Einreichung, „aber es scheint, dass die Beklagten sich an einem Muster des systematischen API-Schlüsseldiebstahls beteiligt haben, der es ihnen ermöglicht hat, Microsoft-API-Schlüssel von mehreren Microsoft-Kunden zu stehlen.“

Verwandt: KI-gesteuerte Cyberangriffe nehmen auf über 600 Millionen tägliche Vorfälle zu

Im Plan verwendete Tools

Die Die Beklagten haben angeblich die de3u-Software entwickelt, um die unbefugte Nutzung des Azure OpenAI-Dienstes zu erleichtern. Dieses Tool bot eine benutzerfreundliche Schnittstelle zum Generieren von Bildern über das DALL-E-Modell von OpenAI.

Es kommunizierte mit den Azure-Systemen, indem es legitime API-Anfragen nachahmte und gestohlene Anmeldeinformationen ausnutzte, um integrierte Sicherheitsmaßnahmen zu umgehen. Das Reverse-Proxy-System ermöglichte diesen Missbrauch zusätzlich, indem es nicht autorisierten Datenverkehr durch Cloudflare-Tunnel umleitete, was die Aktivitäten verschleierte und ihre Erkennung erschwerte.

Microsofts Beschwerde beschreibt die Tools im Detail: „Die de3u-Anwendung der Beklagten kommuniziert mit Azure Computer, die undokumentierte Microsoft-Netzwerk-APIs verwenden, um Anfragen zu senden, die legitime Azure OpenAI Service API-Anfragen nachahmen sollen. Das OAI-Reverse-Proxy-System ermöglichte es Benutzern, Kommunikationen durch Cloudflare-Tunnel in Azure-Systeme zu leiten und Ausgaben zu empfangen, die Sicherheitsbeschränkungen umgingen

Nach der Entdeckung durch Microsoft versuchten die Beklagten Berichten zufolge, wichtige Infrastruktur zu löschen, darunter Rentry.org-Seiten, das GitHub-Repository für de3u und Elemente des Reverse-Proxys System.

Umfassenderer Kontext und branchenweite Auswirkungen

Die Klage kommt zu einer Zeit, in der generative KI-Technologien verstärkt auf ihren möglichen Missbrauch hin untersucht werden wie DALL-E und ChatGPT von OpenAI haben die Erstellung von Inhalten verändert, wurden aber auch für Desinformation, Malware-Entwicklung und schädliche Bilder missbraucht.

Die rechtlichen Schritte von Microsoft unterstreichen die anhaltenden Herausforderungen von KI-Anbietern beim Schutz ihrer Systeme.

Microsoft hat betont, dass die in Azure OpenAI Service integrierten Sicherheitsmaßnahmen robust sind und neuronale Multiklassen-Klassifizierungsmodelle und Metadatenschutz verwenden. Diese Systeme sind darauf ausgelegt, schädliche Inhalte zu blockieren und KI-generierte Ausgaben bis zu ihren Quellen zurückzuverfolgen.

Wie dieser Fall jedoch zeigt, können selbst die fortschrittlichsten Schutzmaßnahmen von entschlossenen Akteuren umgangen werden. „Trotz der verschiedenen Sicherheitsmaßnahmen von Microsoft und OpenAI haben raffinierte Kriminelle Wege gefunden, sich unrechtmäßigen Zugriff auf die Systeme von Microsoft zu verschaffen“, heißt es in der Beschwerde.

Die von Microsoft angegriffene Gruppe darf in ihren Aktivitäten nicht isoliert sein. Das Unternehmen behauptet, dass dieselben Akteure wahrscheinlich andere KI-Dienstleister ausgenutzt haben, was einen breiteren Trend des Missbrauchs im KI-Bereich widerspiegelt. Dies unterstreicht die systemischen Schwachstellen generativer KI-Technologien und die Notwendigkeit einer branchenweiten Zusammenarbeit Bewältigen Sie diese Bedrohungen.

Rechtliche Schritte und Gegenmaßnahmen

Um die Ausnutzung zu bekämpfen, hat Microsoft alle gestohlenen Anmeldeinformationen ungültig gemacht und zusätzliche Sicherheitsmaßnahmen implementiert, um ähnliche Verstöße zu verhindern. Das Unternehmen erwirkte außerdem eine gerichtliche Anordnung zur Beschlagnahme von mit den Beklagten in Verbindung stehenden Domains, darunter „aitism.net“, das für ihre Geschäftstätigkeit von zentraler Bedeutung war.

Diese Maßnahmen ermöglichen es der Digital Crimes Unit von Microsoft, die Kommunikation von diesen Domänen zur weiteren Untersuchung in kontrollierte Umgebungen umzuleiten.

In der Klage wird auch die Absicht von Microsoft dargelegt, Schadensersatz und Unterlassungsansprüche zu fordern, um die Beklagten auszuschalten’Infrastruktur. Durch die Einleitung rechtlicher Schritte möchte das Unternehmen einen Präzedenzfall dafür schaffen, den Missbrauch von KI-Technologien zu bekämpfen und böswillige Akteure zur Rechenschaft zu ziehen.

Auswirkungen auf die Zukunft der KI-Sicherheit

Der Fall veranschaulicht die zunehmende Raffinesse von Cyberkriminellen, die KI-Systeme ausnutzen. Da generative KI immer stärker in Geschäfts-und Verbraucheranwendungen integriert wird, nehmen die Risiken eines Missbrauchs zu. Dieser Vorfall unterstreicht die Bedeutung kontinuierlicher Investitionen in Sicherheitstechnologien und die Notwendigkeit rechtlicher Rahmenbedingungen zur Bewältigung neu auftretender Bedrohungen.

Mit der Verfolgung dieser Klage behebt Microsoft nicht nur unmittelbare Schwachstellen, sondern bekräftigt auch sein Engagement für eine verantwortungsvolle KI-Entwicklung.