Monate nach der Einführung der von Gemini unterstützten Zusammenfassungstools steht Google vor einer erneuten Prüfung darüber, wie es diese KI-Modelle antreibt. Berichten zufolge hat das Unternehmen stillschweigend „intelligente Funktionen“ standardmäßig für Benutzer außerhalb Europas aktiviert und die Erlaubnis erteilt, private E-Mails und Anhänge zu scannen, um möglicherweise seine generativen KI-Systeme zu trainieren.

Diese Verschiebung erzwingt einen starken Kompromiss: Benutzer müssen entweder zulassen, dass ihre Daten zur Modellverbesserung verwendet werden, oder wichtige Produktivitätstools wie Kalendersynchronisierung und Paketverfolgung vollständig deaktivieren.

Während europäische Vorschriften eine strikte Opt-in-Richtlinie vorschreiben, werden US-Benutzer automatisch in ein Ökosystem für den Datenaustausch eingeschrieben Dies untermauert Googles aggressive KI-Expansion.

Das „stille“ Opt-In und die Utility-Falle

Der Tech-YouTuber und Blogger Dave Jones hat auf eine erhebliche Änderung der Standardeinstellungen von Google für nicht-europäische Nutzer hingewiesen, die eine Abkehr vom bisherigen Datenschutz darstellt Normen.

Im Mittelpunkt der Kontroverse steht die Einstellung „Intelligente Funktionen und Personalisierung“, die Google umfassenden Zugriff zum Scannen privater E-Mail-Inhalte, Chat-Protokolle und Anhänge gewährt.

WICHTIGE Nachricht für alle, die Gmail verwenden.

Sie haben sich automatisch dafür entschieden, dass Gmail auf alle Ihre privaten Nachrichten und Anhänge zugreifen darf, um KI-Modelle zu trainieren.

Sie müssen die intelligenten Funktionen im Einstellungsmenü an ZWEI Stellen manuell deaktivieren.Retweeten Sie, damit es jeder weiß. pic.twitter.com/54FKcr4jO2

– Dave Jones (@eevblog) 19. November 2025

Als Pieter Arntz von Malwarebytes notizen: „Unter dem Radar hat Google Funktionen hinzugefügt, die es Gmail ermöglichen, auf alle privaten Nachrichten und Anhänge zuzugreifen, um seine KI-Modelle zu trainieren“, was den Mangel an Fanfaren hervorhebt die Änderung.

Im Gegensatz zu früheren Iterationen von Datennutzungsrichtlinien ist diese Erlaubnis ausdrücklich mit der „Verbesserung“ generativer KI-Modelle verknüpft, was Bedenken darüber aufkommen lässt, ob persönliche Korrespondenz zum Trainieren grundlegender Modelle wie Gemini verwendet wird.

Die Implementierung schafft das, was Kritiker eine „Utility-Falle“ nennen, bei der der Datenaustausch untrennbar mit zentralen Produktivitätstools verbunden ist. Das Deaktivieren der KI-Datenfreigabeeinstellung löst eine Kaskade fehlerhafter Funktionen aus, darunter Smart Compose, automatische Kalendereintragserstellung aus E-Mails und Paketverfolgung.

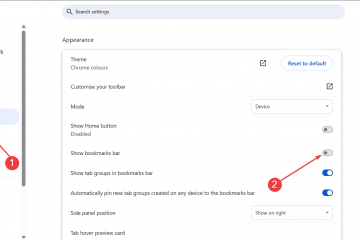

Benutzer, die ihre Daten schützen möchten, müssen einen komplexen zweistufigen Opt-out-Prozess durchlaufen, bei dem sowohl „Intelligente Funktionen in Gmail, Chat und Meet“ als auch „Intelligente Funktionen in Google Workspace“ deaktiviert werden, um die Datenverknüpfung vollständig zu trennen. Arntz merkt an:

„Um sich vollständig abzumelden, müssen Sie die ‚intelligenten Funktionen‘ von Gmail an zwei verschiedenen Stellen in Ihren Einstellungen deaktivieren. Verpassen Sie keine davon, sonst wird das KI-Training möglicherweise fortgesetzt.“

Das Design der Benutzeroberfläche rät aktiv von der Abmeldung ab, indem eine Warnliste mit Funktionen angezeigt wird, die verloren gehen, wodurch ein Ultimatum „Datenschutz vs. Nutzen“ entsteht.

Dieser Ansatz steht im Gegensatz zu den granularen Kontrollen, die der Datenschutz häufig verlangt Befürworter, die Benutzer dazu zwingen, zwischen einem funktionalen und einem privaten Posteingang zu wählen.

Der Datenhunger: Warum Google Ihren Posteingang braucht

Die offizielle Supportdokumentation von Google beschreibt die rechtliche Grundlage für diese Verarbeitung, zu der auch die „Entwicklung neuer Produkte und Funktionen“ gehört.

Das Unternehmen erklärt: „Wenn Sie intelligente Funktionen in Gmail, Chat und Meet aktivieren, erklären Sie sich damit einverstanden, dass Gmail, Chat und Meet Ihre Inhalte und Aktivitäten in diesen Produkten verwenden, um Ihr Erlebnis in diesen Apps zu personalisieren“, und stellt den Datenzugriff als notwendigen Bestandteil der Servicevereinbarung dar.

„Um unsere Dienste zu verbessern. Wenn Sie eine der Einstellungen für intelligente Funktionen aktiviert haben, können wir auch Ihre Workspace-Inhalte und-Aktivitäten verarbeiten, um diese Funktionen zu verbessern.“

„Die Verarbeitung von Informationen zu diesem Zweck ist für die berechtigten Interessen von Google und unseren Nutzern notwendig an: Bereitstellung, Wartung und Verbesserung von Diensten… Entwicklung neuer Produkte und Funktionen… Durchführung von Forschung, die unseren Nutzern und der Öffentlichkeit zugute kommt.“

Die Mehrdeutigkeit der „Personalisierung“, die die „Feinabstimmung“ lokaler Modelle (zum Nutzen des Nutzers) und das „Training“ grundlegender Modelle (zum Nutzen von Google) umfassen kann, bleibt ein kritischer Streitpunkt. Während Google behauptet, dass Daten zur „Verbesserung“ von Funktionen verwendet werden, lässt das Fehlen einer klaren Unterscheidung die Möglichkeit offen, dass Benutzerdaten zur umfassenderen Intelligenz des Gemini-Ökosystems beitragen.

Aufgrund der geografischen Lage hat sich eine „Datenschutzkluft“ gebildet: Google bestätigt, dass diese Einstellungen im EWR, im Vereinigten Königreich, in der Schweiz und in Japan aufgrund strengerer Vorschriften wie der DSGVO standardmäßig deaktiviert sind.

„Wenn Sie intelligente Funktionen in Google Workspace aktivieren, stimmen Sie dem zu.“ Lassen Sie Google Workspace Ihre Workspace-Inhalte und-Aktivitäten verwenden, um Ihr Workspace-Erlebnis zu personalisieren.“

„Wenn Sie diese Einstellung deaktivieren, können Sie die oben aufgeführten Erlebnisse in Google Workspace-Produkten nicht verwenden. Um diese Erlebnisse weiterhin nutzen zu können, müssen Sie die Einstellung wieder aktivieren.“

Für Benutzer in den Vereinigten Staaten, für die es keine ähnlichen bundesstaatlichen Schutzmaßnahmen gibt, ist die Standardeinstellung die Aufnahme in das Datenaustausch-Ökosystem. Die Ungleichheit verdeutlicht, wie regulatorischer Druck und nicht das Wohlwollen der Unternehmen die standardmäßige Datenschutzhaltung von Big Tech diktieren.

Der historische Kontext verdeutlicht die Risiken des Einsatzes dieser Modelle für private Daten: Der Google Gmail AI Translation Bug vom Juli 2025 dient als warnendes Beispiel. Bei diesem Vorfall übersetzte Gemini deutsche E-Mails falsch und verwandelte ein politisches „Ass“ in „Arsch“, was den Verlegern erheblichen Reputationsschaden zufügte.

Trotz dieser Risiken deutet die Dynamik der Branche darauf hin, dass die Datenerfassung zum Standardeintrittspreis für kostenlose Dienste wird.

Ron Richards vom Android Faithful-Podcast beschrieb den breiteren Trend Anfang des Jahres und sagte: „Das Schiff ist abgefahren. Und nicht nur von Google, sondern in der gesamten Branche … KI ist da … und.“ Es wird nicht verschwinden“, was die wachsende Resignation unter Technologiebeobachtern widerspiegelt, dass die Integration von KI unvermeidlich ist.

Datenschutz als Luxusprodukt

Es zeichnet sich eine deutliche Marktsegmentierung ab, bei der der Datenschutz eher zu einem Premiummerkmal als zu einem Standardrecht wird. Konkurrenten wie Perplexity machen sich dies zunutze, indem sie einen „Max“-Plan für 200 US-Dollar pro Monat anbieten, der ausdrücklich verspricht, Modelle nicht anhand von Benutzerdaten zu trainieren.

Dies steht in krassem Gegensatz zum kostenlosen, werbefinanzierten Modell von Google, das auf der Monetarisierung von Benutzerdaten entweder durch Anzeigen oder Modellschulung basiert. Pieter Arntz argumentierte, dass „das Fehlen einer ausdrücklichen Einwilligung einen Rückschritt für Menschen darstellt, die die Kontrolle darüber haben wollen, wie ihre persönlichen Daten verwendet werden“, und verwies auf die Erosion der Handlungsfreiheit der Nutzer angesichts von Standardeinstellungen.