ElevenLabs wandelt sich von einem spezialisierten Sprach-KI-Anbieter zu einem umfassenden multimodalen Produktionszentrum und integriert High-End-Videomodelle von OpenAI, Google und Kling in seine Studio-Plattform.

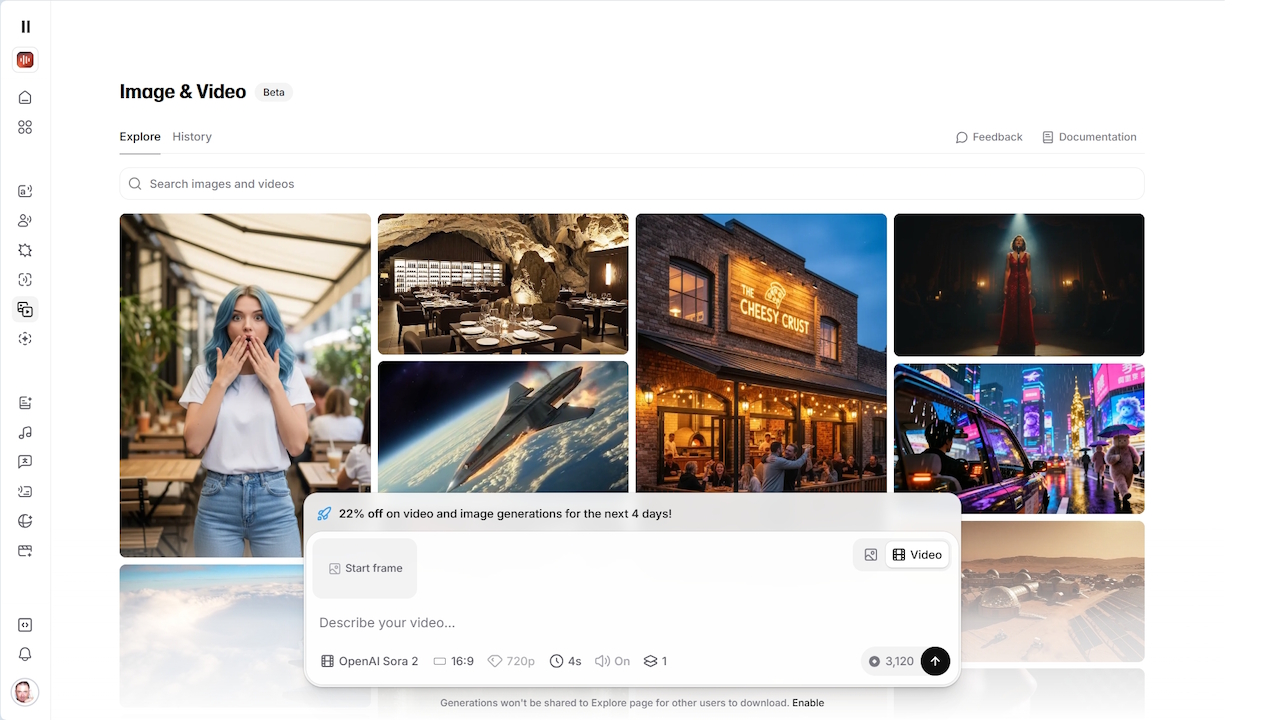

Das heute angekündigte Update ermöglicht Entwicklern die Generierung von Bildern mit eingeschränkten Unternehmensmodellen, darunter Sora 2 Pro von OpenAI und Veo 3.1 von Google, direkt neben den nativen Audio-Tools von ElevenLabs.

In einer Erklärung sagte das Das ElevenLabs-Team betonte, dass das Update „die fortschrittlichsten KI-Modelle mit unseren branchenführenden Sprach-, Ton-und Musiktools vereint“ und so die erstklassigen generativen Fähigkeiten effektiv in einem einzigen Abonnement konsolidiert.

Durch die Zusammenfassung von Videogeneratoren von Drittanbietern in einem einzigen Timeline-Editor Das Unternehmen positioniert sein Studio als einheitliches „Adobe für KI“ und fordert fragmentierte Arbeitsabläufe heraus, die Benutzer dazu zwingen, separate Apps für die Skript-, Sprach-und Videoproduktion zu jonglieren.

Die Giganten zusammenfassen: Eine neue multimodale Strategie

ElevenLabs hat seine „Studio“-Plattform offiziell um die Bild-und Videogenerierung erweitert und markiert damit einen entscheidenden Wandel von seinen Wurzeln als reines Audio-KI-Unternehmen.

Anstatt es zu versuchen Um von Grund auf proprietäre Videomodelle zu entwickeln, um direkt mit etablierten Anbietern wie Runway oder Luma zu konkurrieren, hat das Unternehmen eine Aggregatorstrategie übernommen. Dieser Ansatz positioniert ElevenLabs als einheitliche Schnittstellenschicht für Drittanbieter und optimiert den Zugriff auf fragmentierte Tools.

In der Integration sind einige der begehrtesten und eingeschränktesten Modelle der Branche enthalten. Benutzer können jetzt auf OpenAIs Sora 2 Pro und Googles Veo 3.1 zugreifen, Modelle, die außerhalb ausgewählter Partnerprogramme nur begrenzt öffentlich eingesetzt werden.

[eingebetteter Inhalt]

Dieser Schritt positioniert ElevenLabs Studio als direkten Konkurrenten zu traditionellen nichtlinearen Editoren (NLEs) wie Adobe Premiere, jedoch mit einem generativen Workflow, der Skript, Sprache, Soundeffekte und visuelle Elemente in einer Zeitleiste kombiniert.

Durch deren Zentralisierung Tools befasst sich das Unternehmen mit den Reibungspunkten des aktuellen KI-Kreativ-Stacks. Normalerweise müssen Ersteller Assets über Discord, verschiedene Web-Apps und lokale Software generieren, bevor sie sie an anderer Stelle zusammenstellen.

Die Plattform unterstützt jetzt einen nahtlosen Übergang von der Texteingabe zum endgültigen Videoexport innerhalb einer einzigen Umgebung.

Der Pivot stimmt mit CEO Mati überein Staniszewskis erklärte Vision, ein „Generationenunternehmen“ aufzubauen, das über die Kommerzialisierungsrisiken eigenständiger Text-to-Speech-Dienste hinausgeht.

Die Expansion baut auf einem Jahr des schnellen Wachstums und der Produktdiversifizierung des Unternehmens auf. Wie zuvor von Winbuzzer berichtet, verdoppelte ElevenLabs kürzlich seinen Wert auf 6,6 Milliarden US-Dollar nach einem Übernahmeangebot für Mitarbeiter in Höhe von 100 Millionen US-Dollar, was ein starkes Vertrauen der Investoren in seine umfassendere Plattformstrategie signalisiert.

Unter der Haube: Sora-, Veo-und Kling-Integration

Für Entwickler liegt der Hauptreiz in den spezifischen Fähigkeiten der integrierten Modelle. OpenAI Sora 2 Pro ist das Flaggschiff-Videomodell und bietet eine High-Fidelity-Ausgabe mit Auflösungen von 720p oder 1080p.

Es unterstützt feste Dauern von 4, 8 oder 12 Sekunden und ist für filmische Ergebnisse und komplexe Bewegungen optimiert. Allerdings ist diese Leistung mit hohen Kosten von 12.000 Credits pro Generation verbunden und es fehlt derzeit die Unterstützung für End-Frame-Referenzen.

Google Veo 3.1 bietet eine professionelle Alternative, die sich auf kreative Kontrolle konzentriert. Es bietet Funktionen wie negative Ansagen und eine spezielle Tonsteuerung für 4–8 Sekunden lange Clips zum Preis von 8.000 Credits. Dieses Modell eignet sich besonders für Benutzer, die eine präzise Richtung der visuellen Ausgabe und nicht nur rohe Wiedergabetreue benötigen.

Kling 2.5 ist aufgrund seiner Stärken in der Physiksimulation und der Fluiddynamik enthalten. Es generiert 1080p-Videos in 5-oder 10-Sekunden-Serien für 3.500 Credits. Auch wenn ihr die Tonkontrolle der Google-Modelle fehlt, ist sie aufgrund ihrer geringeren Kreditkosten und spezifischen physikalischen Fähigkeiten eine praktikable Option für dynamische Szenen.

Über Video hinaus integriert die Plattform eine Vielzahl von Bildmodellen. Flux 1 Kontext Pro bietet erweiterte Stilkontrolle, während Google Nano Banana auf Geschwindigkeit optimiert ist. Seedream 4 ist für die Generierung konsistenter Multi-Shot-Sequenzen verfügbar, die für Storytelling-Projekte von entscheidender Bedeutung sind.

Um sicherzustellen, dass diese Assets für hochauflösende Displays geeignet sind, können Benutzer die Ausgaben mithilfe von Topaz Upscale-Modellen um das bis zu Vierfache hochskalieren. Die Suite umfasst außerdem spezielle Dienstprogramme wie Omnihuman 1.5 zum Animieren statischer Bilder und Veed LipSync zum Überspielen vorhandener Videos.

Diese Tools schließen die Lücke zwischen der visuellen Generierung und der Kern-Audiotechnologie von ElevenLabs, zu der das kürzlich eingeführte Scribe v2 Realtime Speech-to-Text-Modell gehört.

Studio-Workflow und die Kosten der Erstellung

Die Studio-Schnittstelle führt eine einheitliche Zeitleiste ein, die den Benutzern zur Verfügung steht Laden Sie ein Video hoch, um automatisch ein Skript zu generieren, oder schreiben Sie ein Skript, um entsprechende visuelle Elemente zu generieren.

Eine wichtige Funktion ist der „Sprachkorrektur“-Workflow, bei dem durch Bearbeiten des Texttranskripts automatisch das entsprechende Voiceover-Segment neu generiert wird. Diese Funktion rationalisiert den Überarbeitungsprozess erheblich und macht das erneute Aufnehmen oder manuelle Zusammenfügen von Audio überflüssig.

Der Credit-Verbrauch schwankt stark, was zu einer komplexen Wirtschaftlichkeit für die Benutzer führt. Eine einzelne High-End-Videogenerierung mit Sora 2 Pro kostet 12.000 Credits, deutlich mehr als Standard-Audio-oder Bildaufgaben.

Im Produkthandbuch heißt es, dass „die Videogenerierung nur bei kostenpflichtigen Plänen verfügbar ist“, was bedeutet, dass kostenlose Benutzer auf die Funktionen zur Bildgenerierung beschränkt sind.

Die Exportoptionen sind robust, Unterstützt MP4-Downloads mit H.264/H.265-Codecs und PNG für Bilder. Alternativ können Assets zur weiteren Bearbeitung direkt wieder in Studio-Projekte importiert werden. Die Plattform unterstützt auch „Image-to-Video“-Workflows, sodass Benutzer generierte Bilder als Startbilder verwenden können, um die visuelle Konsistenz über Videoclips hinweg aufrechtzuerhalten.

Diese Aggregationsstrategie ermöglicht es ElevenLabs, „Best-in-Class“-Leistung über alle Modalitäten hinweg anzubieten, ohne die enormen Forschungs-und Entwicklungskosten für das Training grundlegender Videomodelle selbst tragen zu müssen.

Sie ergänzt ihr bestehendes Portfolio, zu dem das Eleven Music-Generierungstool und die Voice Isolator API gehören, und schafft so ein umfassendes Ökosystem für KI-gesteuerte Medien Produktion.