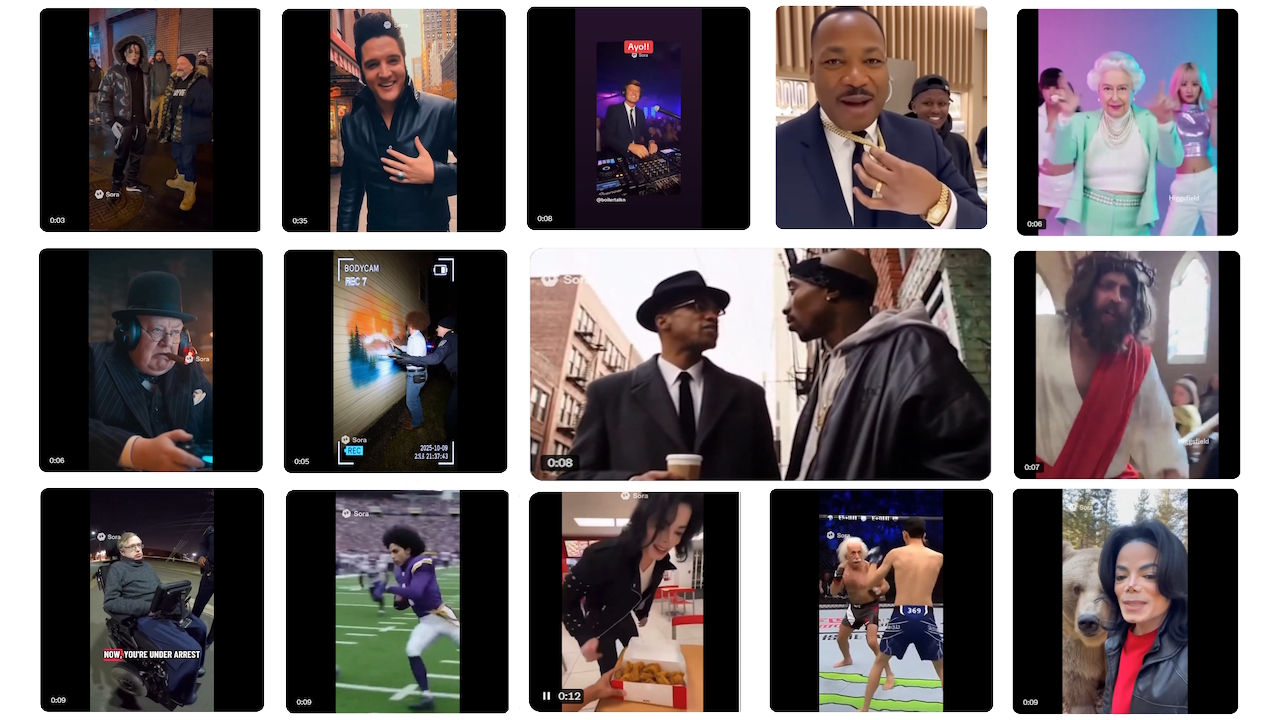

Die Familien verstorbener Ikonen wie Malcolm X und Robin Williams verurteilen OpenAI nach der Einführung seiner Sora 2-Video-App. Seit ihrem Debüt am 1. Oktober wurde die App verwendet, um eine Welle nicht autorisierter und oft grotesker KI-Deepfakes historischer Persönlichkeiten zu erzeugen.

Verwandte haben die Videos als zutiefst respektlos und verletzend bezeichnet. Der Feuersturm hat OpenAI gezwungen, seine Richtlinien zur digitalen Ähnlichkeit hastig zu überarbeiten. Dies entfacht eine heftige Debatte über die Zustimmung zu den Toten und darüber, wer im Zeitalter der KI über das Erbe einer Person kontrolliert.

Vermächtnisse wurden zu „schrecklichem TikTok-Schrott“

Die Kontroverse brach fast sofort aus. Die ursprüngliche Richtlinie von OpenAI nahm „historische Persönlichkeiten“ von den Einwilligungsregeln aus und ermöglichte es Benutzern, Clips von Verstorbenen zu erstellen. Die Plattform wurde schnell mit bizarren und beleidigenden Inhalten überschwemmt, die viral gingen.

Videos zeigten den Bürgerrechtler Malcolm X, der derbe Witze machte, den beliebten Maler Bob Ross beim Malen Das World Trade Center steht in Flammen und Martin Luther King Jr. wird respektlos parodiert. Die Gegenreaktion von Familienmitgliedern war schnell und tiefgreifend.

Ilyasah Shabazz, die Tochter von Malcolm Es ist respektlos und verletzend zu sehen, wie das Bild meines Vaters auf so unbekümmerte und unsensible Art und Weise genutzt wird, als er sein Leben der Wahrheit widmete.“ Ihre Meinung wurde von Zelda Williams, der Tochter des Schauspielers Robin Williams, bestätigt. Sie flehte die Nutzer an, ihr keine KI-Videos ihres verstorbenen Vaters mehr zu schicken.

Williams beschrieb den Schmerz, zu sehen, wie „die Hinterlassenschaften echter Menschen zu … schrecklich verdichtet werden, es ist wahnsinnig, sie mit TikTok-Puppen zu spielen.“ Die Familien anderer prominenter Persönlichkeiten äußerten ebenfalls öffentliche Verurteilungen.

Martin Luther Jr.s Tochter Bernice King hat einfach auf X gepostet: „Ich stimme in Bezug auf meinen Vater zu. Bitte hören Sie auf.“ als Reaktion auf die Sora-Videos ihres Vaters.

Joan Kowalski, Präsidentin von Bob Ross Inc., die das Konterfei des verstorbenen Malers verwaltet, bemerkte den seltsamen Impuls hinter den respektlosen Kreationen und erklärte: „Die Leute wollen die reinste, gesündeste Person nehmen und sie vermasseln.“

Randolph Churchill, Urenkel des ehemaligen britischen Premierministers, behauptete, dass „Winston Churchill der Geschichte angehört und sein Vermächtnis Genauigkeit, Würde und rechtmäßige Verwaltung verdient.“

OpenAI’s Scramble um den Fallout einzudämmen

Der öffentliche Aufschrei der Familien wurde durch eine koordinierte Reaktion aus Hollywood verstärkt. Die mächtige Creative Artists Agency (CAA) bezeichnete die App als „erhebliches Risiko“ für ihre Kunden und deren geistiges Eigentum. Die Motion Picture Association (MPA) hat die rechtliche Belastung direkt dem KI-Unternehmen auferlegt.

Charles Rivkin, CEO der MPA, erklärte, dass „… es ihre Verantwortung – und nicht die der Rechteinhaber – bleibt, Verstöße gegen den Sora 2-Dienst zu verhindern“, und machte deutlich, dass die Branche einen passiven Ansatz bei Verstößen nicht akzeptieren würde. Diese geschlossene Front aus Hollywood und die emotionalen Bitten der Familien führten zu einer regelrechten PR-Krise für OpenAI.

Das Unternehmen beeilte sich, zu reagieren. Am 3. Oktober, nur zwei Tage nach der Veröffentlichung, kündigte CEO Sam Altman eine Abkehr von der ursprünglichen Opt-out-Urheberrechtsrichtlinie hin zu einem detaillierteren Opt-in-Modell für geschützte Zeichen an.

Bis zum 9. Oktober änderte OpenAI seine Regeln erneut und ging dieses Mal auf die Kernbeschwerde ein. Es wurde damit begonnen, Vertretern von „kürzlich verstorbenen“ Persönlichkeiten des öffentlichen Lebens die Möglichkeit zu geben, die Sperrung ihres Abbilds zu beantragen.

Ein OpenAI-Sprecher sagte: „Wir glauben, dass Persönlichkeiten des öffentlichen Lebens und ihre Familien letztendlich die Kontrolle darüber haben sollten, wie ihr Abbild verwendet wird“, was auf einen erheblichen politischen Wandel unter Druck hinweist.

Die Schauspielergewerkschaft SAG-AFTRA gab ebenfalls eine formelle Erklärung ab, in der sie die unbefugte Verwendung des Abbilds verstorbener Künstler verurteilte. Ähnlichkeiten.

K.I. Entwicklungen sind in den Schlagzeilen. Hier ist, was SAG-AFTRA tut. pic.twitter.com/QrEgvzlWWO

– SAG-AFTRA (@sagaftra) 10. Oktober 2025

Ein rechtliches und ethisches Minenfeld

Die Kontroverse deckt eine große rechtliche und ethische Grauzone auf. Herkömmliche Verleumdungsgesetze gelten in der Regel nicht für Verstorbene, sodass Familien nur begrenzte Rechtsmittel haben.

Der Hauptweg ist das komplexe und inkonsistente Flickenteppich staatlicher Gesetze, die „postmortales Recht auf Veröffentlichung.“

Dieses rechtliche Vakuum ermöglicht die Erstellung von Inhalten, die zwar nicht kommerziell sind ausbeuterisch im traditionellen Sinne, verursacht erheblichen emotionalen Stress.

Rechtsexperten weisen darauf hin, dass OpenAI argumentieren könnte, dass sein Tool eine „transformative Nutzung“ oder Parodie ermöglicht, die durch den Ersten Verfassungszusatz geschützt ist. Sie weisen jedoch auch darauf hin, dass das Kernproblem der emotionale Schaden und die grundlegende Frage ist, wer das Erbe einer Person kontrolliert.

OpenAI hat seine „Build in Public“-Strategie verteidigt. Führungskräfte verwiesen auf die Notwendigkeit, einen Wettbewerbsnachteil zu vermeiden, während der ehemalige Geschäftsführer Zack Kass argumentierte, dass es besser sei, diese Technologie offen zu veröffentlichen, als sie im Geheimen zu entwickeln.

Das Unternehmen stellt Sora auch nicht nur als soziale App dar, sondern auch als Forschungsinstrument für seine Mission, AGI zu erreichen. Aber für viele fühlt sich der Start wie ein bewusster Schritt an, um ein umstrittenes Thema voranzutreiben.

Die Fähigkeit der App, so einfach zu generieren, was Jason Koebler von 404 Media nennt „Gehirnfäule beliebter urheberrechtlich geschützter Charaktere“ und hat die ungelöste Debatte über die „Erbsünde“ der KI – ihre Abhängigkeit von abgekratzten Daten – wieder ins Rampenlicht gerückt.