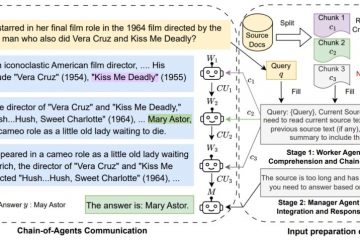

OpenAI hat ein großes Update für seine Canvas-Funktion innerhalb von ChatGPT vorgestellt und die Möglichkeit eingeführt, Canvas mit OpenAs O1-Argumentationsmodell zu verwenden und HTML und React Code interaktiv zu rendern.

Die Ankündigung, die über X geteilt wird, markiert einen wichtigen Schritt, um Leinwand aus einem allgemeinen Text-Editing-Tool in eine robuste Plattform für Entwickler und Designer zu verwandeln.

Durch Aktivieren von Live-Vorschau von Code direkt innerhalb des Arbeitsbereichs zielt OpenAI darauf ab, auf ein breiteres Spektrum von Benutzern zu geraten, einschließlich Webentwicklern, Inhaltserstellern und Software-Ingenieuren.://winbuzer.com/wp-content/uploads/2025/01/openai-chatgpt-canvas-official-scaled.jpg”>

Chatgpt mit Canvas funktioniert jetzt mit Openai O1-und kann HTML und Can Rendern HTML und Can rendern und html und können HTML und Can rendern Reagieren. pic.twitter.com/d3t6hlyd0h

-OpenAI-Entwickler (@openaidevs) 24. Januar 2025

Die Fähigkeit, Webkomponenten wie HTML und React zu rendern bietet auch interaktive Codierungsfunktionen. Das Update von

OpenAI verbindet auch seine breitere Strategie, Leinwand als multifunktionaler Arbeitsbereich zu erweitern. Das jüngste Update für Chatgpt-Leinwand folgt mehreren früheren Verbesserungen, einschließlich Python-Ausführungsfunktionen und der Integration benutzerdefinierter GPTs. > Mit den neu eingeführten HTML-und React-Rendering-Funktionen können Benutzer den Code direkt in der Canvas-Schnittstelle visualisieren, eine Ergänzung, die den Dienstprogramm dramatisch erweitert.

react , eine beliebte JavaScript-Bibliothek zum Erstellen von Benutzeroberflächen, endet verwendet, verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet verwendet, und verwendet, verwendet, und verwendet, verwendet, und verwendet, verwendet, und verwendet, verwendet, und verwendet, verwendet, und verwendet eine beliebte JavaScript-Bibliothek Javascript XML (JSX) , das HTML-like-Tags mit JavaScript kombiniert, um dynamische und interaktive Komponenten zu erstellen. Mit diesem Update können Entwickler mit JSX direkt in Leinwand experimentieren und Live-Ergebnisse anzeigen, ohne sich auf externe Tools zu verlassen. Benutzer berichten über die Möglichkeit, externe Bibliotheken über Inhaltsdeliefer-Netzwerke (CDNs) zu importieren, um die Funktionalität von React zu erweitern. OpenAI hat jedoch noch nicht detailliert dargestellt, welche CDNs unterstützt werden oder wie sie konfiguriert werden.

Einige Benutzer haben auch während der JSX-Kompilierung , einschließlich eines Problems, bei dem das System die Meldung angezeigt hat: „Erstellen Sie mit 1 Fehler: Interne: Benutzer-Komponent.JS: 10: 17: Erwartete’}’, aber gefunden’:’.”, während Leinwand ein”Fix fixiert”enthält Dieser Fehler”Helfer, seine aktuellen Funktionen werden begrenzt, sodass die fortgeschrittenen Benutzer manuell Fehler beheben. Positioniert Leinwand als direkter Rivalen zu den Claude-Artefakten von Anthropic, einem Werkzeug, das für seine Fähigkeit gelobt wurde, HTML und andere interaktive Elemente zu rendern.

[eingebetteter Inhalt]

Claude-Artefakte wurden von Entwicklern, die sich auf seine polierten Erfahrung für das Entwerfen und Testen von webbasierten Komponenten verlassen, häufig übernommen. OpenAIs Leinwand bringt jedoch zusätzliche Stärken mit, indem sie breitere Funktionen anbieten, wie z. B. Python-Ausführung und Integration mit benutzerdefinierten GPT-Modellen.”. Dieser dynamische Ansatz geht über die Webentwicklung hinaus und bietet Tools für Debugging, Datenvisualisierung und Dokumentenbearbeitung und macht es zu einer vielseitigen Option für Fachleute in mehreren Domänen. Strong>

Leinwand im Oktober 2024 als Beta-Release für Chatgpt Plus und Teams abonniert. Hervorhebung, gezielte Änderungen und Schreiben von Verknüpfungen halfen den Benutzern, Inhalte mit Präzision zu verfeinern, unabhängig davon, ob sie an Artikeln oder Debugging-Code arbeiteten. Eine breitere Einführung neben neuen Funktionen wie Echtzeit-Python-Ausführung und tieferer Integration in benutzerdefinierte GPT-Modelle. Mit

Python-Ausführung können Entwickler den Code direkt im Arbeitsbereich schreiben, testen und debuggen, um Workflows für die Datenanalyse und Softwareentwicklung zu optimieren. OpenAI präsentierte diese Fähigkeit während einer Live-Demonstration mit der Begründung: „Durch die Integration von Echtzeitausführung wollen wir die Reibung zwischen der Ideengenerierung und-implementierung verringern. Aufgaben oder Branchen.’Anwendbarkeit. Professionelle Bedürfnisse.