Meta, die Muttergesellschaft von Facebook, Instagram und Threads, nimmt eine umfassende Änderung ihrer Richtlinien zur Inhaltsmoderation vor, indem sie ihr Drittanbieter-Faktenprüfungsprogramm zugunsten eines benutzergesteuerten Systems namens Community Notes abschafft.

Der Übergang spiegelt Metas erneuerten Fokus auf die freie Meinungsäußerung wider und geht gleichzeitig auf die anhaltende Kritik an Voreingenommenheit und Überreichweite in seinen Moderationspraktiken ein.

„Wir wollen das beheben und zu unserem grundlegenden Bekenntnis zur freien Meinungsäußerung zurückkehren.“ Ausdruck“, schreibt Joel Kaplan, Metas globaler Politikchef, in einem offizielle Stellungnahme

Kaplan beschrieb frühere Moderationssysteme als übertrieben restriktiv und fügte hinzu: „So gut gemeint viele dieser Bemühungen auch waren, sie haben sich im Laufe der Zeit so weit ausgeweitet, dass wir zu viele Fehler machen, unsere Benutzer frustrieren und zu oft der von uns dargelegten freien Meinungsäußerung im Weg stehen.“ zu ermöglichen.“

Die Änderungen werden in den kommenden Monaten zunächst in den Vereinigten Staaten eingeführt, mit Plänen für eine schrittweise Ausweitung auf andere Regionen.

Ein neuer Ansatz: Was Sind Gemeinschaft Notizen?

Community Notes ist ein Moderationssystem nach dem Vorbild von X (ehemals Twitter), das den Kontext für markierte Beiträge per Crowdsourcing sammelt. Anstatt aufdringliche Warnungen auszusprechen, können Mitwirkende mit Community Notes Beiträge mit zusätzlichen Informationen versehen, sofern ein Konsens zwischen Benutzern mit unterschiedlichen Perspektiven erzielt wird. Dieser Konsensmechanismus zielt darauf ab, Voreingenommenheit zu minimieren und die Transparenz bei der Moderation von Inhalten zu fördern.

„Wir haben gesehen, dass dieser Ansatz bei X funktioniert – wo sie ihre Community in die Lage versetzen, zu entscheiden, wann Beiträge möglicherweise irreführend sind und mehr Kontext benötigen.“ Menschen mit unterschiedlichen Perspektiven entscheiden, welche Art von Kontext für andere Benutzer hilfreich ist.“

Unter diesem neuen System wird Meta Community-Notizen nicht mehr direkt schreiben oder moderieren Stattdessen werden die Mitwirkenden freiwillig basteln Anmerkungen, die vereinbarte Kriterien erfüllen, eliminiert außerdem die Vollbildwarnungen, die Benutzer zuvor daran hinderten, markierte Inhalte anzuzeigen, und ersetzt sie durch kleinere Beschriftungen, auf die Benutzer klicken können, um mehr Kontext zu erhalten.

Lockerer Beschränkungen und gezielte Durchsetzung

Gleichzeitig mit der Annahme der Community Notes lockert Meta die Beschränkungen für politisch sensible Themen wie Einwanderung und Geschlechtsidentität. Diese in der Öffentlichkeit häufig diskutierten Themen werden nicht mehr so streng moderiert. Meta wird stattdessen der Durchsetzung von Regeln zu schwerwiegenden Verstößen wie Terrorismus, Ausbeutung von Kindern und Betrug Priorität einräumen.

„Wir beseitigen eine Reihe von Beschränkungen zu Themen wie Einwanderung, Geschlechtsidentität und Geschlecht, die das sind.“ Gegenstand häufiger politischer Diskussionen und Debatten“, schreibt Kaplan. „Es ist nicht richtig, dass Dinge im Fernsehen oder im Kongress gesagt werden können, aber nicht auf unseren Plattformen.“

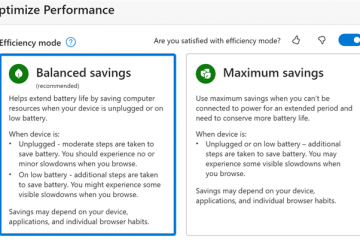

Meta reduziert auch seine Abhängigkeit davon automatisierte Moderationssysteme, die wegen falscher Klassifizierung von Inhalten kritisiert werden. Bei weniger schwerwiegenden Verstößen wird jetzt nur dann gehandelt, wenn sie von Benutzern gemeldet werden, während sich Algorithmen ausschließlich auf schwerwiegende Probleme konzentrieren.

Politische und strategische Implikationen

Der Zeitpunkt der Moderationsüberarbeitung von Meta fällt mit einem politischen Wandel in den Vereinigten Staaten zusammen, was zu Spekulationen über die Beweggründe des Unternehmens führt. Kritiker haben darauf hingewiesen, dass Meta seit langem mit Vorwürfen politischer Voreingenommenheit konfrontiert ist, insbesondere von konservativen Gruppen, die sich von früheren Richtlinien zur Moderation von Inhalten angegriffen fühlten.

Kaplan räumte die Gegenreaktion ein und erklärte, dass eine zu weitreichende Durchsetzung zu Fehlern geführt habe. „Wir glauben, dass ein bis zwei von zehn dieser Aktionen Fehler waren (d. h. der Inhalt hat möglicherweise nicht tatsächlich gegen unsere Richtlinien verstoßen)“, erklärte er und fügte hinzu, dass der neue Ansatz darauf abzielt, das Vertrauen der Nutzer im gesamten politischen Spektrum wiederherzustellen.

Das ursprüngliche Faktenprüfungsprogramm von Meta, das 2016 ins Leben gerufen wurde, war darauf ausgelegt, Fehlinformationen über Wahlen zu bekämpfen. Obwohl die Initiative darauf abzielte, den Nutzern genaue Informationen zu liefern, wurde sie wegen ihrer wahrgenommenen Einmischung in politische Debatten kritisiert Abhängigkeit von Drittorganisationen mit ihren eigenen Vorurteilen.

Die Verlagerung der Vertrauens-und Sicherheitsteams

Im Rahmen seiner umfassenderen Umstrukturierung verlegt Meta seine Vertrauens-und Sicherheitsteams von Kalifornien nach Texas und an andere US-Standorte sollen Bedenken hinsichtlich regionaler Voreingenommenheit bei Moderationsentscheidungen ausräumen und gleichzeitig eine Änderung der operativen Strategie von Meta signalisieren neue US-Regierung.

Meta erklärte, dass die Verlagerung von Vertrauens-und Sicherheitsteams die Entscheidungsfindung und Reaktionsfähigkeit auf die Bedürfnisse der Gemeinschaft verbessern würde. Das Unternehmen plant außerdem, den Einsatz fortschrittlicher Sprachmodelle auszuweiten, um die Moderation zu unterstützen und Fehler bei Durchsetzungsentscheidungen zu reduzieren.

Wiedereinführung von Bürgerinhalten mit personalisiertem Fokus

Meta überdenkt seinen Umgang mit zivilgesellschaftlichen und politischen Inhalten auf seinen Plattformen. Nachdem das Unternehmen jahrelang solche Inhalte in den Feeds der Benutzer reduziert hat, plant es, diese mit einer personalisierten Strategie wieder einzuführen. Benutzer werden mehr Kontrolle darüber haben, wie viele politische Inhalte sie sehen, basierend auf Interaktionskennzahlen wie Likes, Kommentaren und Sehgewohnheiten.

Meta gab an, dass Tests zu personalisierten zivilen Inhalten durchgeführt wurden und das Unternehmen eine Expansion plant Optionen, die Benutzern helfen, relevante Inhalte zu priorisieren. Die neue Initiative zielt darauf ab, Benutzerpräferenzen mit dem Ziel von Meta, einen robusten bürgerschaftlichen Diskurs zu fördern, in Einklang zu bringen.

Automatisierung, Beteiligung der Gemeinschaft und Zukunftsaussichten

Während die Automatisierung ein Problem bleibt Als unverzichtbares Werkzeug im Moderationsarsenal von Meta wird seine Rolle neu definiert. Large Language Models (LLMs) fungieren nun als Zweitmeinung bei Durchsetzungsentscheidungen und konzentrieren sich dabei auf schwerwiegende Verstöße. Unterdessen stellt die Umstellung auf Community Notes einen umfassenderen Versuch dar, die Inhaltsüberwachung zu dezentralisieren und Benutzer direkt in den Moderationsprozess einzubeziehen.

Zuckerberg gab an, dass die Änderungen darauf abzielen, sicherzustellen, dass Richtlinien besser mit Metas Mission, freie Meinungsäußerung zu ermöglichen, in Einklang stehen.