推出 Gemini 支持的摘要工具幾個月後,谷歌正面臨著對其如何支持這些人工智能模型的重新審查。報告顯示,該公司已默認為歐洲以外的用戶悄悄啟用“智能功能”,授予掃描私人電子郵件和附件的權限,以潛在地訓練其生成人工智能係統。

這種轉變迫使人們做出一個嚴峻的權衡:用戶必須要么允許他們的數據用於模型改進,要么完全禁用日曆同步和包裹跟踪等核心生產力工具。

雖然歐洲法規強制執行嚴格的選擇加入政策,但美國用戶發現自己自動加入了支撐數據共享生態系統的數據共享生態系統。 Google 積極的 AI 擴張。

“安靜”選擇加入和實用陷阱

科技 YouTube 博主戴夫·瓊斯 (Dave Jones) 指出 Google 針對非歐洲用戶的默認設置發生了重大變化,這標誌著對以前隱私保護的背離爭議的中心是“智能功能和個性化”設置,該設置授予 Google 掃描私人電子郵件內容、聊天日誌和附件的廣泛權限。

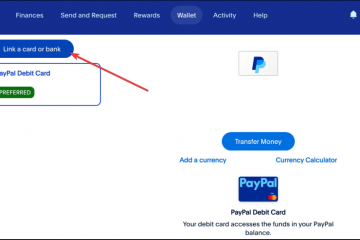

給所有使用 Gmail 的人的重要信息。

您已自動選擇允許 Gmail 訪問您的所有私人消息和附件以訓練 AI 模型。

您必須在兩個位置的“設置”菜單中手動關閉智能功能。轉發推文,以便每個人都知道。 pic.twitter.com/54FKcr4jO2

—戴夫·瓊斯 (@eevblog) 2025 年 11 月 19 日

作為 Malwarebytes 的 Pieter Arntz 指出,“在雷達下,Google 添加了允許 Gmail 訪問所有私人消息和附件以訓練其 AI 模型的功能”,這凸顯了這一變化缺乏大肆宣傳。

與之前的數據使用政策迭代不同,此權限明確與“改進”生成式 AI 模型相關,引發了人們對是否使用個人信件來訓練 Gemini 等基礎模型的擔憂。

該實施創建了批評者所說的“ “實用陷阱”,數據共享與核心生產力工具密不可分。禁用 AI 數據共享設置會觸發一系列損壞的功能,包括智能撰寫、從電子郵件自動創建日曆條目以及包裹跟踪。

嘗試保護數據的用戶必須完成複雜的兩步選擇退出流程,同時禁用“Gmail、聊天和 Meet 中的智能功能”以及“Google Workspace 中的智能功能”,以完全切斷數據鏈接。 Arntz 指出,

“要完全選擇退出,您必須在設置中的兩個不同位置關閉 Gmail 的‘智能功能’。不要錯過任何一個,否則 AI 訓練可能會繼續。 “

用戶界面設計通過顯示將丟失的功能警告列表來積極阻止選擇退出,從而形成“隱私與實用”的最後通牒。

這種方法與隱私倡導者經常要求的精細控制形成鮮明對比,迫使用戶在功能收件箱和私人收件箱之間進行選擇。

數據飢渴:為什麼 Google 需要您的收件箱

Google 的官方支持文檔概述了此處理的法律依據,其中包括“開發新產品和功能”。

公司 聲明“當您打開 Gmail、Chat 和 Meet 中的智能功能時,即表示您同意讓 Gmail、Chat 和 Meet 使用您在這些產品中的內容和活動來個性化您在這些應用中的體驗”,並將數據訪問作為服務協議的必要組成部分。

“為了改進我們的服務。如果您打開了任何智能功能設置,我們還可能會處理您的工作區內容和活動以改進這些功能。 “

“為此目的處理信息對於 Google 和我們的用戶在以下方面的合法利益是必要的:提供、維護和改進服務……開發新產品和功能……進行有利於我們的用戶和公眾的研究。 “

“個性化”的模糊性,包括“微調”本地模型(為了用戶的利益)和“訓練”基礎模型(為了 Google 的利益)仍然是爭論的關鍵點。雖然 Google 聲稱數據用於“改進”功能,但由於缺乏明確的區別,用戶數據有可能為 Gemini 生態系統提供更廣泛的智能。

基於地理位置形成了“隱私鴻溝”:Google 確認,由於 GDPR 等更嚴格的法規,這些設置在歐洲經濟區、英國、瑞士和日本默認關閉。

“當您在 Google Workspace 中開啟智能功能時,您同意讓 Google Workspace 使用您的 Workspace 內容和活動來個性化您在 Workspace 中的體驗。 “

“關閉此設置後,您將無法在 Google Workspace 產品中使用上面列出的體驗。要繼續使用這些體驗,您需要重新打開該設置。 “

對於缺乏類似聯邦保護的美國用戶,默認的做法是納入數據共享生態系統。這種差異凸顯了監管壓力而非企業善意決定了大型科技公司默認的隱私姿態。

歷史背景凸顯了在私人數據上部署這些模型的風險:2025 年 7 月的 Google Gmail AI 翻譯錯誤是一個警示故事。在那次事件中,Gemini 錯誤地翻譯了德語電子郵件,將政治上的“Ace”變成了“Ass”,對出版商造成了嚴重的聲譽損害。

儘管存在這些風險,但行業勢頭表明數據收集正在成為免費服務的標准進入成本。

Android Faithful 播客的羅恩·理查茲 (Ron Richards) 描述了今年早些時候的更廣泛趨勢,他說“這艘船已經起航了。不僅是來自 Google,而且是整個行業……人工智能就在這裡……並且它不會消失”,反映出科技觀察家越來越多地放棄人工智能集成是不可避免的。

隱私作為一種奢侈品

一個獨特的市場細分正在出現,隱私正在成為一項高級功能,而不是一項標準權利。像 Perplexity 這樣的競爭對手正在利用這一點,提供每月 200 美元的“Max”計劃,明確承諾不會根據用戶數據訓練模型。

這與 Google 的免費、廣告支持的模型形成鮮明對比,後者依賴於通過廣告或模型訓練將用戶數據貨幣化。 Pieter Arntz 認為,“對於那些想要控制個人數據使用方式的人來說,缺乏明確的同意感覺就像是倒退了一步”,他指出,面對默認設置,用戶代理權受到了侵蝕。