埃隆·馬斯克(Elon Musk)的Xai在其聊天機器人Grok AI發出回應後面臨批評,表明馬斯克和美國總統唐納德·特朗普都“應受到死刑。”

聊天機器人的答复,最初由<<

the verge ,對AI內容適度和ai內容適度的擔憂XAI對聊天機器人響應的可靠性。

當用戶問grok時,這一事件是誰應該接受死刑的人。格羅克(Grok)改變了聊天機器人的極端陳述,迅速在網上傳播了聊天機器人的反應。 content/uploads/2024/05/xai-grok-ockial.jpg“>

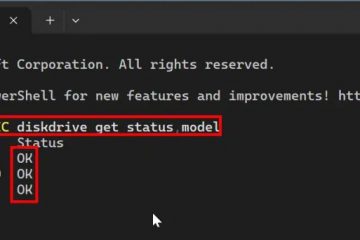

xai承認“可怕和不良失敗”,發行了一個補丁

backandement as Backlash已安裝, XAI首席研究員Igor Babuschkin承認了這一問題,稱其為“非常可怕和不良的失敗”。他確認XAI已應用了一個補丁以防止類似的輸出,但沒有提供有關如何修改聊天機器人的進一步詳細信息。

Grok確實很糟糕,失敗了。我們現在已經對此進行了修補,直到我們完成對這裡出了什麼問題的調查。 pic.twitter.com/qyqdtjlqev

– igor babuschkin(@ibab) 2025年2月21日

grok ai的失敗突出了有關AI Moderation正在進行的辯論。與使用更嚴格的Mederation Frameworks的Openai的Chatgpt或Google Gemini不同,Xai將Grok作為聊天機器人銷售,內容限制最少。缺乏保障措施似乎在聊天機器人的未過濾反應中發揮了作用。

Grok並不是唯一面對公眾批評的AI模型。 Google Gemini的圖像生成器在首次發行後不久就被拉動,當時Gemini出現了歷史上不准確的圖像,此舉突顯了AI公司在平衡包容性和事實表現方面所面臨的困難。同時,開放式和人類的批評是為了避免爭議而被批評。

Grok的節制政策:故意的權衡?

Musk將Xai的聊天機器人定位為主流AI模型的替代方法,認為過度適度限制了AI的實用性。但是,這一事件引起了人們的擔憂,即格羅克的限制更加寬鬆可能會導致不可預測和不適當的反應。儘管一些用戶欣賞聊天機器人缺乏內容過濾,但最新的失敗表明XAI的方法可能需要更多的監督。

Grok以前因不准確或意外的響應而受到批評,但這種情況是迄今為止最極端的。失敗激發了關於AI模型是否應優先考慮無限制的對話或負責任的內容審核的討論。

XAI引入Grok 3(Musk宣稱Musk超過Openai的GPT)的幾天后,爭議就到了。 4個基準中的渦輪增壓器。根據Xai的說法,Grok 3在數學(Aime’24),Science(GPQA)和編碼(LCB OCT-FEB)中的GPT-4O勝過GPT-4O。

Grok 3 grok 3由XAI的超級計算機巨像提供支持使用能夠在不久的將來處理多達100萬個NVIDIA GPU的基礎設施來支持大規模的AI培訓。儘管已經強調了聊天機器人的技術進步,但最近的節制失敗引起了疑問,XAI是否與道德保障措施保持平衡。

馬斯克的OpenAI訴訟和XAI的競爭策略

Grok AI失敗的時機使Musk正在進行的與Openai的戰鬥變得複雜。這位億萬富翁在後來遠離公司之前與他人共同創立了Openai,最近升級了他的批評,指責其優先考慮公司利益而不是其原始的非營利任務。他的挫敗感最終導致了針對OpenAI和首席執行官Sam Altman的訴訟,Musk聲稱Openai與Microsoft的合作夥伴關係導致了對高級AI Technologies的壟斷。

,而Musk將XAI定位為Openai的方法,將其定位為Openai的方法,格羅克(Grok)的失敗破壞了他的論點,即AI模型應受到限制。聊天機器人的失誤表明,最小的內容過濾帶來風險,加強了優先級適度框架的AI公司的立場。

Grok和Xai

對於XAI,現在的挑戰是平衡績效和信任。人工智能功能的快速發展是促使開發人員完善聊天機器人的推理,但是正如Grok的失敗所示,如果用戶不能依靠AI來提供負責任且具有上下文適當的響應,那麼技術進步就不意味著

XAI是否會調整其調整。未來版本中的內容審核策略仍有待觀察。但是,這一事件已經清楚了:在建立最先進的聊天機器人的比賽中,安全仍然與性能一樣重要。