OpenAI 已撤銷一名使用其實時 API 為自動步槍系統提供支援的開發人員的 API 存取權。該項目涉及配備步槍的機器人砲塔,可以解釋口頭命令並執行模擬射擊動作。

此事件凸顯了人們對人工智慧在開發自主武器中可能被濫用的日益擔憂,引發了有關人工智慧道德和人工智慧安全的問題。網路上稱為“STS Innovations LLC”在線分享了該系統的視頻,展示了其功能。命令:“ChatGPT,我們處於來自左前方和右前方的攻擊”,砲塔立即做出反應,旋轉並向指定方向發射空彈。-content/uploads/2025/01/STS-Innovations-ChatGPT-AI-Rifle.jpg”>

雷射瞄準/射擊模擬#robotics #Electronics

增加了合成語音,「如果您需要任何進一步的幫助,請讓我令人毛骨悚然的演示強調了消費級人工智慧工具如何輕鬆適應潛在的有害用途。.com/@ sts_3d?refer=embed”>@sts_3d

追蹤系統更新 #robotics #vision #Electronics

OpenAI 的Swift 策略執行

OpenAI 的Swift 策略執行 告訴Futurism,「我們主動發現了這種違反我們政策的行為,並通知了開發商在收到您的詢問之前停止此活動。 。示範#robotics #電子產品 #cnc

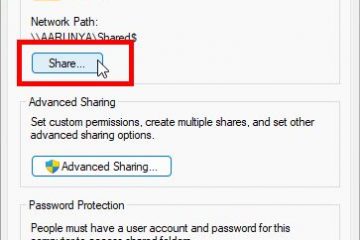

即時 API 是一款專為互動式應用程式設計的工具,它允許開發人員將自然語言命令轉換為機器人砲塔的可操作輸入。

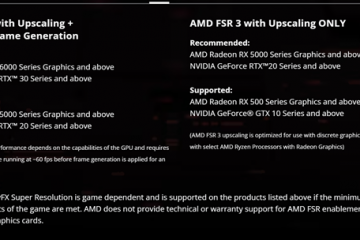

雖然API 旨在用於有益的用例,例如增強可訪問性或改善客戶交互,但這種濫用表明了監管雙重用途技術的挑戰。相關: OpenAI 和Anduril 為美國軍用無人機防禦建立合作夥伴關係

對人工智慧和武器化的更廣泛影響

此案重新引發了無人機道德的爭論自主武器。這些系統能夠在沒有人類監督的情況下選擇和攻擊目標,帶來了複雜的法律和道德挑戰。

聯合國長期以來一直主張對戰爭中的人工智慧進行更嚴格的監管,並警告自治系統可能違反國際法並削弱責任感。 >與Palantir、AWS 合作,在美國情報和軍事領域開展人工智慧

《華盛頓郵報》最近的一篇報導詳細介紹了人工智慧在軍事領域部署的令人不安的例子行動,包括聲稱以色列使用人工智慧來選擇轟炸目標。

報告指出,「在某些時候,唯一需要的證據就是目標是男性。」這類案例突顯了依賴人工智慧做出生死決定的風險以及不分青紅皂白的可能性。 p>

相關:綠色貝雷帽使用ChatGPT 進行賽博卡車爆炸,警方發布聊天日誌

OpenAI 在國防技術中的作用

雖然OpenAI 執行禁止武器化的政策,但其與專門從事人工智慧驅動的防禦解決方案的Anduril Industries 的合作卻引發了對其立場的質疑

此次合作旨在增強戰場情報。萬億美元的支持下,越來越依賴人工智慧公司與軍事應用之間不斷增長的交叉凸顯了平衡技術創新與道德考慮的挑戰。 > 新的Palantir-Anduril 人工智慧聯盟解決美國國防資料差距

DIY 武器化和可訪問性風險

個人很容易濫用人工智慧工具和3D 列印等其他技術,這使得問題變得更加複雜。執法部門已經遇到過 DIY 武器化的案例,例如 Luigi Mangione 的涉嫌行為,他 據報道使用3D 列印零件來組裝槍枝。這些技術降低了個人創建具有致命潛力的自主系統的障礙。 OpenAI 在這種情況下的果斷行動展示了其對防止濫用的承諾,但也凸顯了一旦其技術進入公共領域,完全控制其技術部署方式的難度。治理的更廣泛問題。監管倡導者強調需要製定明確的全球標準,以確保人工智慧的發展符合道德原則。然而,在具有不同利益和優先事項的國家之間達成共識仍然是一項艱鉅的任務。

即時 API 是一款專為互動式應用程式設計的工具,它允許開發人員將自然語言命令轉換為機器人砲塔的可操作輸入。

雖然API 旨在用於有益的用例,例如增強可訪問性或改善客戶交互,但這種濫用表明了監管雙重用途技術的挑戰。相關: OpenAI 和Anduril 為美國軍用無人機防禦建立合作夥伴關係

對人工智慧和武器化的更廣泛影響

此案重新引發了無人機道德的爭論自主武器。這些系統能夠在沒有人類監督的情況下選擇和攻擊目標,帶來了複雜的法律和道德挑戰。

聯合國長期以來一直主張對戰爭中的人工智慧進行更嚴格的監管,並警告自治系統可能違反國際法並削弱責任感。 >與Palantir、AWS 合作,在美國情報和軍事領域開展人工智慧

《華盛頓郵報》最近的一篇報導詳細介紹了人工智慧在軍事領域部署的令人不安的例子行動,包括聲稱以色列使用人工智慧來選擇轟炸目標。

報告指出,「在某些時候,唯一需要的證據就是目標是男性。」這類案例突顯了依賴人工智慧做出生死決定的風險以及不分青紅皂白的可能性。 p>

相關:綠色貝雷帽使用ChatGPT 進行賽博卡車爆炸,警方發布聊天日誌

OpenAI 在國防技術中的作用

雖然OpenAI 執行禁止武器化的政策,但其與專門從事人工智慧驅動的防禦解決方案的Anduril Industries 的合作卻引發了對其立場的質疑

此次合作旨在增強戰場情報。萬億美元的支持下,越來越依賴人工智慧公司與軍事應用之間不斷增長的交叉凸顯了平衡技術創新與道德考慮的挑戰。 > 新的Palantir-Anduril 人工智慧聯盟解決美國國防資料差距

DIY 武器化和可訪問性風險

個人很容易濫用人工智慧工具和3D 列印等其他技術,這使得問題變得更加複雜。執法部門已經遇到過 DIY 武器化的案例,例如 Luigi Mangione 的涉嫌行為,他 據報道使用3D 列印零件來組裝槍枝。這些技術降低了個人創建具有致命潛力的自主系統的障礙。 OpenAI 在這種情況下的果斷行動展示了其對防止濫用的承諾,但也凸顯了一旦其技術進入公共領域,完全控制其技術部署方式的難度。治理的更廣泛問題。監管倡導者強調需要製定明確的全球標準,以確保人工智慧的發展符合道德原則。然而,在具有不同利益和優先事項的國家之間達成共識仍然是一項艱鉅的任務。