O Google intensificou a corrida armamentista de IA nesta terça-feira ao lançar o Gemini 3 Pro e uma nova plataforma de codificação, o Google Antigravity. Com as melhores pontuações sobre o GPT-5.1 da OpenAI nos principais testes de raciocínio, a empresa posiciona seu modelo mais recente como uma ferramenta para planejamento autônomo, em vez de apenas geração de texto.

O lançamento é lançado imediatamente para desenvolvedores via AI Studio e Vertex AI, introduzindo recursos “Deep Think” projetados para resolver problemas complexos. Essa mudança visa mudar o trabalho de software da codificação manual para uma colaboração onde os agentes de IA cuidam do trabalho pesado.

“Gemini 3 é nosso modelo mais inteligente que ajuda você a dar vida a qualquer ideia”, disse Sundar Pichai, CEO do Google e da Alphabet.

Benchmarks e a vantagem “Deep Think”

As métricas de desempenho divulgadas pelo Google DeepMind sugerem um salto significativo nas capacidades de raciocínio. O Gemini 3 Pro agora lidera a tabela de classificação da LMArena com uma pontuação de 1501 Elo, uma métrica amplamente respeitada na comunidade para avaliar o desempenho do modelo no mundo real.

Mais notavelmente, o Google afirma que o modelo supera o GPT-5.1 no “Último Exame da Humanidade” (HLE), uma referência rigorosa para raciocínio acadêmico.

“O Gemini 3 Pro é agora o modelo mais avançado do Google para tarefas complexas e pode compreender vastos conjuntos de dados, problemas desafiadores de diferentes fontes de informação”, explicou Demis Hassabis, CEO do Google DeepMind.

Quantitativamente, o Gemini 3 Pro atinge uma pontuação de 37,5% no HLE sem ferramentas, em comparação com os 26,5% relatados pelo GPT-5.1, de acordo com o cartão modelo Gemini 3. No benchmark GPQA Diamond, que testa o conhecimento científico, a pontuação é de 91,9%.

Esses números sustentam a afirmação do Google de que o modelo não está apenas gerando texto, mas engajando-se em “raciocínio de nível de doutorado”.

Para ampliar ainda mais esses limites, o Google também apresenta o “Deep Think”, um modo de raciocínio especializado que foi lançado pela primeira vez em agosto para o Gemini 2.5. Atualmente em testes de segurança e com lançamento previsto para assinantes Ultra nas próximas semanas, o Deep Think foi projetado para solução estendida de problemas.

Ele atinge uma taxa sem precedentes de 45,1% no ARC-AGI-2 com execução de código verificada, demonstrando uma capacidade de enfrentar desafios novos e abstratos que muitas vezes atrapalham os modelos padrão.

Esse foco no raciocínio está diretamente relacionado às descobertas recentes do Google DeepMind. No início deste mês, o laboratório publicou uma pesquisa sobre o AlphaEvolve, um sistema de IA que acelera a descoberta matemática, e revelou o SIMA 2, um agente capaz de autotreinamento em ambientes 3D.

O Deep Think parece produzir os avanços subjacentes desses projetos de pesquisa, trazendo o raciocínio especializado para um modelo de uso geral.

Antigravidade: uma plataforma de desenvolvimento que prioriza o agente

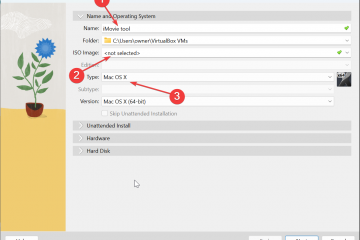

Os desenvolvedores ganham acesso imediato a um novo paradigma com o lançamento do Google Antigravity. Disponível agora para MacOS, Windows e Linux, esse ambiente de desenvolvimento integrado (IDE) foi criado especificamente para fluxos de trabalho de agentes.

Ao contrário dos assistentes de codificação tradicionais que sugerem trechos em um editor existente, o Antigravity permite que os usuários gerenciem agentes autônomos. Esses agentes planejam e executam tarefas no editor, no terminal e no navegador simultaneamente.

[conteúdo incorporado]

Ao elevar os agentes a uma superfície dedicada, o Google pretende reduzir o atrito da mudança de contexto. A plataforma apresenta uma visualização de “controle de missão”, onde os usuários podem monitorar vários agentes simultaneamente.

Esses agentes geram artefatos detalhados – trechos de código, diferenças e logs de execução – que permitem ao arquiteto humano revisar a lógica antes do compromisso final.

Os agentes podem validar independentemente seu próprio código, executar testes e iterar soluções sem intervenção humana constante. Essa abordagem “agente primeiro” se alinha às tendências recentes do setor em direção à engenharia de software autônoma, onde o desenvolvedor atua mais como um arquiteto do que como um digitador.

O sistema está fortemente acoplado aos modelos Gemini Computer Use para controle do navegador, permitindo que os agentes pesquisem documentação ou depurem aplicativos da web em tempo real.

A integração vai além do novo IDE. O Gemini 3 Pro agora está disponível no Google AI Studio, Vertex AI e Gemini CLI, garantindo que os fluxos de trabalho de produção existentes possam se beneficiar imediatamente dos recursos aprimorados do modelo. Os usuários do Android Studio também verão esses recursos serem implementados, trazendo a codificação de agente para o desenvolvimento de aplicativos móveis.

“Vibe Coding” e a evolução da pesquisa

Além do IDE, o Google está promovendo o conceito de “vibe coding”, onde a linguagem natural se torna a sintaxe principal. No Google AI Studio, o Gemini 3 Pro agora pode gerar aplicativos da web totalmente interativos a partir de um único prompt. Ele lida com a orquestração complexa de HTML, CSS e JavaScript nos bastidores.

Os não desenvolvedores podem criar protótipos funcionais simplesmente descrevendo uma “vibração” ou funcionalidade desejada, em vez de escrever a sintaxe. Uma demonstração destacada pela empresa mostrou um jogo de nave espacial retrô construído inteiramente a partir de uma descrição em linguagem natural, com o modelo lidando com a lógica do jogo e renderizando tiro zero.

[conteúdo incorporado]

Esse recurso se estende à pesquisa do consumidor. O”Modo IA”na Pesquisa Google agora aproveita o Gemini 3 para gerar layouts dinâmicos e interativos dinamicamente.

Um ecossistema multimodal

O lançamento do Gemini 3 Pro segue a atualização de outubro do Veo 3.1, que trouxe inserção granular de objetos e ferramentas de áudio mais ricas para o conjunto de geração de vídeo do Google.

A sinergia entre esses modelos sugere um futuro em que o Gemini 3 poderá orquestrar tarefas multimodais complexas, direcionando o Veo para gerar recursos de vídeo enquanto escreve o código e o script que os acompanham.

“O Gemini 3 oferece três frentes críticas para o Agent Opus: velocidade… precisão… e confiabilidade, gerenciamento de raciocínio de longo contexto e invocação de ferramentas granulares sem as armadilhas comuns da alucinação”, disse Jay Wu, cofundador e CTO da OpusClip.

A compreensão do vídeo também passou por uma grande atualização. O Gemini 3 Pro obteve pontuação de 87,6% no benchmark Video-MMMU, indicando alta proficiência na análise e raciocínio sobre conteúdo de vídeo. Essa capacidade é crucial para a “compreensão multimodal” que o Google apregoa, permitindo que o modelo processe entradas de vídeo de formato longo para tarefas como análise esportiva ou observação científica. Os exemplos fornecidos incluem a análise da forma de pickleball ou a visualização do fluxo de plasma em um reator tokamak.

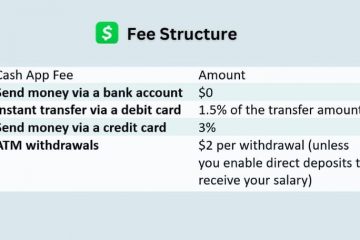

Preços, disponibilidade e barreiras de segurança

As estruturas de preços refletem uma mudança estratégica para tornar esses recursos avançados acessíveis para uso em produção. O Gemini 3 Pro custa US$ 2 por milhão de tokens de entrada e US$ 12 por milhão de tokens de saída para solicitações abaixo de 200.000 tokens de acordo com o blog do desenvolvedor. Este preço competitivo visa incentivar a adoção generalizada entre empresas e desenvolvedores que criam aplicativos de alto volume.

Os protocolos de segurança continuam sendo um pilar central do lançamento. O Google enfatiza que o Gemini 3 Pro passou por uma extensa equipe vermelha e atende aos limites de lançamento específicos para segurança infantil. O cartão modelo detalha avaliações no âmbito da”Estrutura de segurança de fronteira”, testes específicos para riscos químicos, biológicos, radiológicos e nucleares (QBRN).

Embora o modelo tenha mostrado”nível de elevação 1″em QBRN e segurança cibernética. conhecimento, não atingiu os limites críticos que desencadeariam uma interrupção da implantação. Este regime de testes específico visa evitar que o modelo auxilie na criação de materiais nocivos ou ataques cibernéticos.

Apesar da implementação agressiva, o Google reconhece limitações. O limite de conhecimento do modelo é janeiro de 2025, o que significa que falta conhecimento dos eventos dos últimos dez meses, a menos que seja fornecido através do contexto. Além disso, embora o “Deep Think” se mostre promissor, o seu lançamento atrasado para o público em geral sugere que garantir a segurança de capacidades de raciocínio tão poderosas continua a ser um desafio complexo.

Com este lançamento, a Google aposta que o futuro da IA não reside apenas em modelos maiores, mas em agentes mais inteligentes e autónomos que possam raciocinar através de problemas e executar tarefas de forma fiável. À medida que os desenvolvedores começarem a desenvolver o Antigravity e o Gemini 3 Pro, a indústria verá em breve se essas ferramentas podem cumprir a promessa de uma verdadeira era de “agente em primeiro lugar”.