A Apple lançou o Pico-Banana-400K, um conjunto de dados públicos em grande escala projetado para aprimorar a edição de imagens orientada por IA. Publicada em 23 de outubro, a coleção contém quase 400 mil edições de imagens de alta qualidade criadas a partir de fotografias reais.

O projeto visa resolver um desafio importante para os pesquisadores, fornecendo um recurso aberto e diversificado para o treinamento de modelos da próxima geração.

Em um movimento notável, os pesquisadores da Apple usaram ferramentas do concorrente Google para criar o conjunto de dados. Eles aproveitaram o editor de imagens “Nano-Banana” para gerar as edições e o modelo Gemini 2.5 Pro para garantir qualidade e precisão. O conjunto de dados completo já está disponível no GitHub para pesquisas não comerciais.

Um esforço entre empresas para resolver um gargalo de pesquisa

Em uma exibição surpreendente de colaboração entre setores, a Apple recorreu à tecnologia de seu principal rival para construir sua mais recente ferramenta de pesquisa.

A criação do conjunto de dados Pico-Banana-400K foi impulsionada por um gargalo persistente no desenvolvimento de IA: a ausência de conjuntos de dados grandes, de alta qualidade e abertamente acessíveis, baseados em dados reais. imagens. Muitos recursos existentes são totalmente sintéticos, limitados no escopo de curadoria humana ou construídos com modelos proprietários, dificultando o amplo progresso da comunidade.

Os pesquisadores da Apple afirmam que seu objetivo era criar uma “base robusta para treinar e comparar a próxima geração de modelos de edição de imagens guiados por texto”.

De acordo com seu artigo, “O que distingue o Pico-Banana-400K dos conjuntos de dados sintéticos anteriores é nossa abordagem sistemática à qualidade e diversidade”.

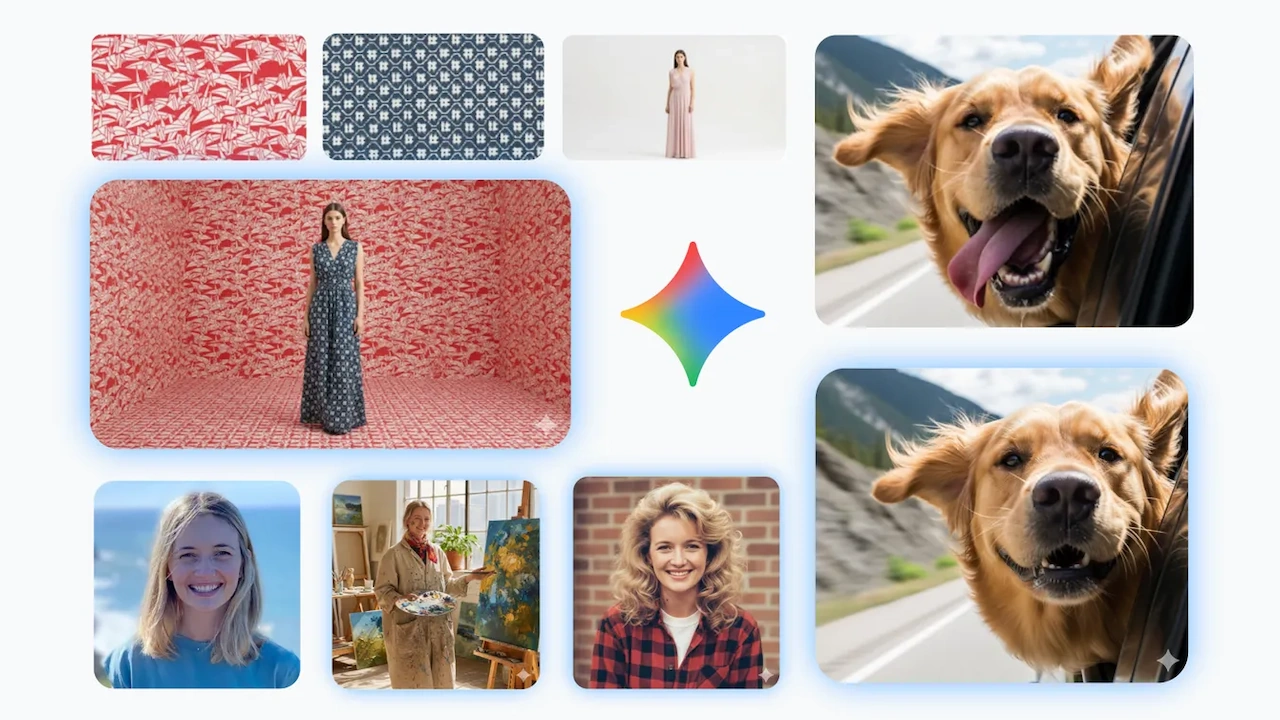

Pesquisando fotografias originais da coleção OpenImages, a equipe usou o poderoso modelo Nano-Banana do Google, agora oficialmente conhecido como Gemini 2.5 Flash Image, para gerar uma vasta gama de edições.

Um segundo modelo do Google, o Gemini-2.5-Pro, serviu como juiz automatizado para garantir a conformidade com as instruções e a qualidade visual. Todo o processo custou aproximadamente US$ 100.000.

Por dentro do conjunto de dados: mais do que apenas edições únicas

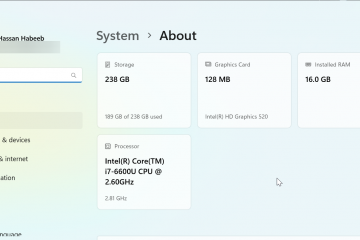

Aprofundar-se na estrutura do conjunto de dados revela um recurso projetado para cenários de pesquisa complexos. Embora chamada de “400K”, a coleção na verdade compreende 386.000 exemplos organizados em uma taxonomia detalhada de 35 tipos de edição em oito categorias principais.

Eles variam de ajustes simples de pixel e fotométricos a mudanças semânticas complexas em nível de objeto, edições de composição de cena e transformações estilísticas.

Sua maior parte contém 258.000 exemplos de giro único para ajuste fino supervisionado padrão. Um segundo subconjunto fornece 72.000 exemplos multivoltas, permitindo a pesquisa em edição sequencial e modificações sensíveis ao contexto, onde um modelo deve rastrear alterações em várias etapas.

Finalmente, um subconjunto de preferências de 56.000 exemplos inclui pares de edições bem-sucedidas e falhadas. Isto é crucial para a investigação de alinhamento e para a formação de modelos de recompensa que possam aprender a distinguir resultados de alta qualidade de resultados defeituosos. Os pesquisadores podem acessar o conjunto de dados completo no portal de pesquisa da Apple sob uma licença não comercial Creative Commons.

Iluminando a fronteira e as falhas da edição de IA

Para a comunidade de pesquisa de IA, o lançamento é mais do que apenas um novo conjunto de dados; é um indicador claro de onde a tecnologia se destaca e onde ainda enfrenta dificuldades.

As métricas de desempenho do conjunto de dados mostram que edições globais e estilísticas, como aplicar um filtro vintage ou alterar o tom geral de uma cena para a “hora dourada”, são altamente confiáveis. No entanto, as edições que exigem controle espacial preciso e compreensão geométrica continuam sendo um desafio significativo.

Tarefas como realocar um objeto dentro de uma cena tiveram uma taxa de sucesso inferior a 60%, e a geração de texto dentro de imagens foi particularmente frágil.

Isso fornece um contexto valioso para o mercado de imagens de IA altamente competitivo. O modelo Nano-Banana subjacente do Google se tornou o editor de imagens mais bem avaliado em tabelas de classificação públicas, mesmo antes de seu lançamento oficial.

Seu sucesso faz parte de uma corrida mais ampla do setor, com a ByteDance lançando seu modelo Seedream 4.0 como um desafiante direto e a tecnologia de licenciamento Meta da Midjourney após contratempos internos.

Os recursos desses modelos estão se expandindo rapidamente. Nicole Brichtova, líder de produto do Google DeepMind, disse:”Estamos colocando recursos que antes exigiam ferramentas especializadas nas mãos dos criadores comuns, e tem sido inspirador ver a explosão de criatividade que isso desencadeou.”

Os primeiros usuários elogiaram a consistência do modelo. Andrew Carr, cofundador da startup de IA Cartwheel, considerou-o excepcionalmente capaz, afirmando: “O novo modelo Gemini 2.5 Flash Image foi o primeiro que poderia fornecer ambos.”

O lançamento da Apple também está sendo discutido como um excelente exemplo de “destilação de modelo”. Este é um processo em que um modelo grande e poderoso (Nano-Banana) é usado para gerar um enorme conjunto de dados de treinamento.

Outros pesquisadores podem então usar esses dados públicos para treinar modelos menores, mais eficientes e potencialmente de código aberto que imitam os recursos do sistema proprietário original. Ao tornar públicos esses resultados de alta qualidade, a Apple está efetivamente ajudando a democratizar o acesso à IA de última geração, promovendo um cenário de pesquisa mais aberto e colaborativo.

“`