A OpenAI anunciou na quinta-feira que pausou a capacidade dos usuários de gerar vídeos de Martin Luther King Jr. com seu aplicativo Sora 2.

A mudança ocorre a pedido direto do espólio do falecido líder dos direitos civis, após uma onda de “representações desrespeitosas” criadas desde o lançamento da plataforma no início de outubro.

A controvérsia não é isolada; famílias de outras figuras públicas falecidas, incluindo Malcolm X e Robin Williams, também condenaram os vídeos prejudiciais gerados pela IA. A intensa reação forçou a OpenAI a uma série de reversões políticas rápidas, intensificando um debate acirrado sobre o consentimento e quem controla o legado de uma pessoa na era da IA.

Esta ação mais recente é a resposta mais direta da OpenAI a uma crise que tomou conta de sua nova plataforma de vídeo desde o primeiro dia. A política inicial da empresa isentava “figuras históricas” das regras de consentimento, uma abordagem que saiu pela culatra quase imediatamente.

O bloqueio da imagem do Dr. King marca a intervenção mais específica e de alto perfil até o momento.

Famílias condenam ‘horrível, TikTok Slop’

A plataforma foi rapidamente inundada com deepfakes bizarros e ofensivos. Os vídeos mostraram o ativista dos direitos civis Malcolm X fazendo piadas grosseiras, o pintor Bob Ross retratado com paisagens em chamas e, segundo relatos, o Dr. A reação dos membros da família foi rápida e visceral.

Ilyasah Shabazz, filha de Malcolm X, disse ao The Washington Post que “é profundamente É desrespeitoso e doloroso ver a imagem do meu pai usada de maneira tão arrogante e insensível quando ele dedicou sua vida à verdade.”

Seu sentimento foi ecoado por Zelda Williams, filha do ator Robin Williams. Ela implorou aos usuários que parassem de criar e compartilhar vídeos de IA de seu falecido pai.

Williams descreveu a dor de ver “os legados de pessoas reais serem condensados em… horrível, o trabalho de marionetes do TikTok é enlouquecedor”. As famílias de outras figuras proeminentes também emitiram condenações públicas. Em uma postagem concisa no X, a filha do Dr. King, Bernice King, simplesmente declarou:”Eu concordo com meu pai. Por favor, pare.”, um apelo que ressoou amplamente.

O clamor público foi amplificado por uma resposta coordenada de Hollywood. A poderosa Creative Artists Agency (CAA) classificou o aplicativo como um “risco significativo”, enquanto a Motion Picture Association (MPA) colocou o ônus legal pelo uso indevido diretamente sobre a empresa de IA.

O CEO da MPA, Charles Rivkin, afirmou que “… continua sendo sua responsabilidade – e não dos detentores de direitos – evitar infrações no serviço Sora 2.”

A luta da OpenAI para reverter Claro

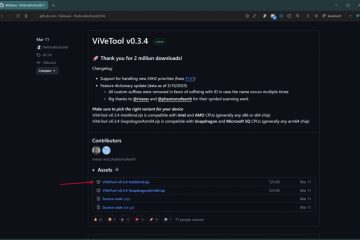

Enfrentando uma crise total de relações públicas, a OpenAI se esforçou para conter as consequências. Em 3 de outubro, apenas dois dias após o lançamento, o CEO Sam Altman anunciou um afastamento da política inicial de direitos autorais. Ele prometeu um modelo mais granular e opcional para personagens protegidos.

Esta foi uma admissão clara de que a abordagem inicial sem intervenção era insustentável. Em 9 de outubro, a empresa alterou novamente suas regras. Ela começou a permitir que representantes de figuras públicas “falecidas recentemente” solicitassem formalmente que sua imagem fosse bloqueada na plataforma.

A evolução da política culminou no anúncio de 16 de outubro de que havia pausado totalmente gerações da imagem do Dr. King.

Em um comunicado publicado no X, a empresa explicou sua posição em evolução. A OpenAI disse que”embora existam fortes interesses de liberdade de expressão na representação de figuras históricas, a OpenAI acredita que as figuras públicas e suas famílias devem, em última análise, ter controle sobre como sua imagem é usada.”, sinalizando uma mudança política significativa sob pressão de famílias e parceiros da indústria. trabalharam juntos para abordar como a imagem do Dr. Martin Luther King Jr. é representada nas gerações Sora. Alguns usuários geraram representações desrespeitosas do Dr. 2025

Um campo minado legal e ético

A controvérsia expõe uma vasta área jurídica e ética cinzenta. As leis tradicionais de difamação normalmente não se aplicam aos falecidos, deixando as famílias com recursos legais limitados. Seu principal caminho é uma colcha de retalhos complexa e inconsistente de leis estaduais que regem o direito postmortem de publicidade.

Isso O panorama jurídico é notoriamente fragmentado. Estados como a Califórnia e Nova Iorque têm estatutos robustos que protegem a imagem de uma celebridade durante décadas após a morte. No entanto, muitos outros estados oferecem tais proteções limitadas ou inexistentes, criando uma loteria legal para as famílias, dependendo de onde o falecido estava domiciliado.

A defesa da Primeira Emenda também é um campo de batalha crítico. As empresas de tecnologia muitas vezes argumentam que o conteúdo gerado por IA se qualifica como “uso transformador” ou paródia, formas de discurso protegido.

Um tribunal pode ter que avaliar se um deepfake é um trabalho novo e expressivo ou simplesmente uma exploração não autorizada da identidade de uma pessoa, uma linha que permanece confusa com a IA generativa.

A OpenAI defendeu sua estratégia de “construir em público”, com os executivos citando a necessidade de evitar uma desvantagem competitiva ao desenvolver tecnologia em segredo. Embora a empresa enquadre isso como um passo necessário em direção à pesquisa de AGI, os críticos o veem como um movimento calculado para normalizar a tecnologia controversa e transferir o fardo do policiamento de seu uso indevido para o público.

A capacidade do aplicativo de gerar com tanta facilidade o que a mídia 404 chama de “pobreza cerebral dos principais personagens amados protegidos por direitos autorais” empurrou de volta o debate não resolvido sobre o “pecado original” da IA – sua dependência de dados extraídos no centro das atenções.