A Califórnia está reforçando seu controle sobre a indústria de tecnologia com um trio de novas leis destinadas a proteger as crianças dos danos online. O governador Gavin Newsom assinou um pacote legislativo histórico na segunda-feira que exige rótulos de advertência de saúde nas redes sociais, impõe protocolos de segurança rigorosos aos chatbots de IA e cria um novo sistema de verificação de idade baseado em dispositivos.

A medida posiciona a Califórnia na vanguarda da regulamentação digital nos EUA, respondendo às crescentes preocupações sobre o impacto da tecnologia na saúde mental dos jovens. Essas leis visam aumentar a transparência e a responsabilidade dos gigantes da tecnologia, forçando-os a priorizar o bem-estar dos seus usuários mais jovens.

Em um declaração anunciando as novas leis, o governador Newsom destacou a natureza dupla da tecnologia moderna. Ele afirmou: “Tecnologias emergentes, como chatbots e mídias sociais, podem inspirar, educar e conectar – mas sem barreiras de proteção reais, a tecnologia também pode explorar, enganar e colocar nossos filhos em perigo”. ressaltando a justificativa do governo para a intervenção.

Um trio de novas proteções para menores on-line

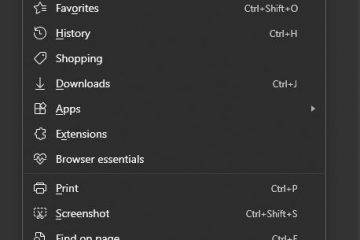

O pacote legislativo introduz três projetos de lei distintos, mas relacionados. O primeiro, AB 56, tem como alvo direto plataformas de mídia social como Instagram e TikTok. Ela exige que eles exibam avisos proeminentes aos usuários menores de 18 anos sobre o “profundo risco de danos à saúde mental e ao bem-estar de crianças e adolescentes”.

A lei exige um aviso ignorável de 10 segundos no primeiro login de um menor todos os dias. Um aviso de 30 segundos mais forte e impossível de ser ignorado aparecerá após três horas de uso, repetindo-se para cada hora adicional passada na plataforma.

O segundo projeto de lei, SB 243, faz da Califórnia o primeiro estado a regulamentar de forma abrangente o crescente campo de chatbots complementares de IA. A partir de 1º de janeiro de 2026, ela exige que as operadoras implementem recursos de segurança robustos, incluindo verificação de idade e protocolos para lidar com riscos de suicídio e automutilação.

O ímpeto para a lei do chatbot de IA foi particularmente forte. Ganhou impulso após acontecimentos trágicos, incluindo o suicídio de um adolescente após conversas com o ChatGPT, que estimularam os legisladores a exigirem responsabilização pelos danos provocados pela IA e a exigirem protocolos de prevenção do suicídio.

Finalmente, AB 1043 estabelece uma abordagem inovadora e centrada no dispositivo para verificação de idade. Obriga fabricantes de dispositivos como Apple e Google a que os pais insiram a idade de seus filhos durante a configuração. Essas informações devem então ser disponibilizadas para os aplicativos, criando um sistema mais consciente da privacidade do que aqueles que exigem uploads de documentos de identificação com foto.

O contexto nacional: do cirurgião-geral à ação estatal

Esse impulso legislativo não ocorreu no vácuo. A linguagem dos avisos nas redes sociais foi extraída diretamente de um consultoria de 2023 do Cirurgião Geral dos EUA Vivek Murthy. Mais tarde, Murthy ampliou as suas preocupações num artigo de opinião de junho de 2024, apelando à introdução de rótulos de advertência semelhantes aos do tabaco nestas plataformas.

Embora a ação da Califórnia seja significativa, segue-se ao Minnesota, que se tornou o primeiro estado a aprovar uma lei de rótulos de advertência semelhante em julho de 2025. Isto reflete uma tendência crescente de os estados tomarem medidas à medida que a legislação federal estagna. A primeira sócia da Califórnia, Jennifer Siebel Newsom, captou esse sentimento, afirmando: “Nossos filhos merecem um mundo que os valorize mais do que a tecnologia ao seu redor”.

As novas leis também se alinham com um ataque legal mais amplo à indústria de tecnologia. Na cidade de Nova Iorque, as autoridades abriram recentemente um processo importante contra vários gigantes das redes sociais, alegando que criaram um incômodo público. Ashwin Vasan, Comissário de Saúde de Nova York, declarou sem rodeios que “a mídia social é uma toxina em nosso ambiente digital e devemos intervir para proteger nossos filhos”. Embora algumas empresas tenham colaborado com legisladores para definir as regras, poderosos grupos de lobby manifestaram forte oposição, citando preocupações sobre a liberdade de expressão e a inovação.

A oposição da indústria vai além das preocupações gerais. Grupos comerciais de tecnologia argumentam que os rótulos de advertência equivalem a discurso forçado, enquanto a Motion Picture Association fez lobby contra a lei de verificação de idade, temendo que ela interrompesse perfis de streaming em dispositivos familiares compartilhados.

A empresa de capital de risco Andreessen Horowitz tem sido uma crítica particularmente veemente. Seu chefe de assuntos governamentais, Collin McCune, argumentou que “ele erra um marco importante ao regulamentar como a tecnologia é desenvolvida – uma medida que corre o risco de expulsar startups, desacelerar a inovação e consolidar os maiores players”.

Estamos lutando por uma estratégia nacional de IA que dê à Little Tech uma chance justa e mantenha os EUA na liderança. inclui algumas disposições ponderadas que levam em conta as necessidades distintas das startups. Mas perde um ponto importante ao regulamentar como a tecnologia…

— Collin McCune (@Collin_McCune) Setembro 29 de outubro de 2025

Esse sentimento ecoa o debate controverso que cercou a SB 53, a lei anterior de segurança de IA da Califórnia. Esse projeto de lei também enfrentou resistência de figuras da indústria que alertaram que poderia sufocar o progresso.

Califórnia entra no vazio regulatório federal

Com Washington D.C. em grande parte paralisado na política tecnológica, a Califórnia está mais uma vez a aproveitar o seu poder económico e tecnológico para estabelecer um padrão nacional de facto. O enorme mercado do estado muitas vezes obriga as empresas a adoptarem as suas regras a nível nacional, moldando efectivamente a política para todo o país.

Esta abordagem liderada pelo estado cria uma complexa colcha de retalhos de regras para uma indústria habituada a uma supervisão federal uniforme. O resultado é um teste de alto risco para saber se a ação a nível estatal pode governar eficazmente uma economia digital sem fronteiras, uma questão que cabe agora aos tribunais e ao mercado decidir.

Este padrão ficou evidente com a aprovação do SB 53, que estabeleceu novos requisitos de transparência para os desenvolvedores de modelos avançados de IA. As novas leis de segurança infantil seguem o mesmo manual, criando uma estrutura regulatória abrangente que outros estados poderão em breve imitar.

Ao lidar simultaneamente com avisos de mídia social, segurança de chatbots de IA e verificação de idade, a Califórnia está enviando uma mensagem inequívoca. O estado está determinado a construir um ambiente digital com proteções mais fortes para seus cidadãos mais jovens, independentemente de o governo federal agir ou não.