O Openai lançou um conjunto de controles parentais para o ChatGPT, dando aos Guardians novas ferramentas para gerenciar a experiência de adolescentes com a IA. O lançamento global na segunda-feira para usuários da Web é uma resposta direta à crescente pressão legal e regulatória sobre o impacto da plataforma na saúde mental dos jovens. O sistema permite que os pais vinculem contas a adolescentes, filtem conteúdo sensível, defina limites de uso e recebem alertas sobre potencial auto-mutilação. Os controles estão disponíveis agora para usuários da Web, com acesso esperado para seguir logo altura=”1281″src=”Data: imagem/svg+xml; nitro-inempty-id=mty0mzoxmtq1-1; base64, phn2zyb2awv3qm94psiwidagmti4mcaxmjgx IIB3AWR0Ad0Imti4MCIGAGVPZ2H0PSIXMJGXIIB4BWXUCZ0IAHR0CDOVL3D3DY53MY5VCMCVMJAWMC9ZDMCIPJWVC3ZNPG==”>

sob o capô: como os novos controles parentais do ChatGPT funcionam

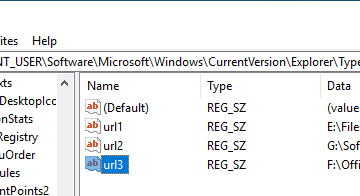

o New System é construído em um Mutual Model. Um pai ou adolescente deve iniciar um convite para vincular suas contas, e a outra parte deve aceitar. Uma vez conectados, os pais obtêm acesso a um painel de controle dedicado em suas próprias configurações de chatgpt.

Neste painel, os Guardiões podem implementar várias restrições. Isso inclui definir”horas tranquilas”para bloquear o acesso, desativar o modo de voz, desativar o recurso de memória do chatbot para limitar a personalização e impedir a geração de imagens.

Um recurso crucial é um sistema de notificação para crises agudas de saúde mental. Se uma conversa for sinalizada para o conteúdo da auto-prejudicação, uma equipe de revisores humanos da Openai a avalia. Se eles detectarem”angústia aguda”, os pais são alertados por e-mail, texto e notificação de push. “Queremos dar aos pais informações suficientes para agir e conversar com as adolescentes, mantendo uma quantidade de privacidade de adolescentes.”

No entanto, os adolescentes podem desvincular suas contas a qualquer momento, uma ação que imediatamente desencadeia uma notificação para os pais, garantindo que eles não estejam cientes da mudança que morreu por suicídio . O processo alega que as respostas bancárias e validadas do ChatGPT prepararam o adolescente e contribuíram para sua morte.”Como pais, você não pode imaginar como é ler uma conversa com um chatbot que preparou seu filho para tirar a própria vida”. Este caso galvanizou a preocupação pública e intensificou a pressão sobre o OpenAI para agir decisivamente.

O ambiente regulatório também está esquentando. Em meados de setembro, a Comissão Federal de Comércio iniciou uma investigação abrangente sobre sete grandes empresas de tecnologia-incluindo o OpenAI, Meta e Google-para investigar o impacto psicológico dos Chatbots da AI com as crianças.”Proteger as crianças on-line é uma das principais prioridades da FTC de Trump-Vance, assim como promover a inovação em setores críticos de nossa economia”. Essa ação federal sinaliza uma nova era de supervisão para uma indústria que, até agora, operava com poucos corrimãos. Outros gigantes da tecnologia estão enfrentando falhas de segurança semelhantes, provocando medidas reativas e condenação generalizada de funcionários. O incidente levou Jim Steyer, CEO da Common Sense Media, a declarar: “Meta ai é um perigo para os adolescentes e deve ser derrubado imediatamente.”

O fracasso levou a uma carta contundente de uma coalizão de 44 advogados gerais, que escreveu:”Somos uniformemente revolvidos por esse aparente de parente de crianças emocionais de crianças. href=”https://oag.ca.gov/system/files/attachments/press-docs/ai%20chatbot_final%20%2844%29.pdf”Target=”_ Blank”> REGULADORES DE ESTADO PERCIMENTE , por padrão, poderia abordar algumas dessas críticas. Por enquanto, a indústria observa se esses novos guardrails são suficientes.