TL;DR

A essência: o Google está testando uma interface “Search Live” que exibe cartões de citações visuais em tempo real durante respostas de voz conversacionais. Detalhes principais: Desenvolvido pelo Gemini 3, o recurso apresenta links de origem enquanto a IA fala para permitir a verificação imediata das reivindicações. Por que é importante: esta atualização visa corrigir a “lacuna de confiança” causada pelas alucinações de IA e aborda as preocupações dos editores sobre o tráfego sem cliques.

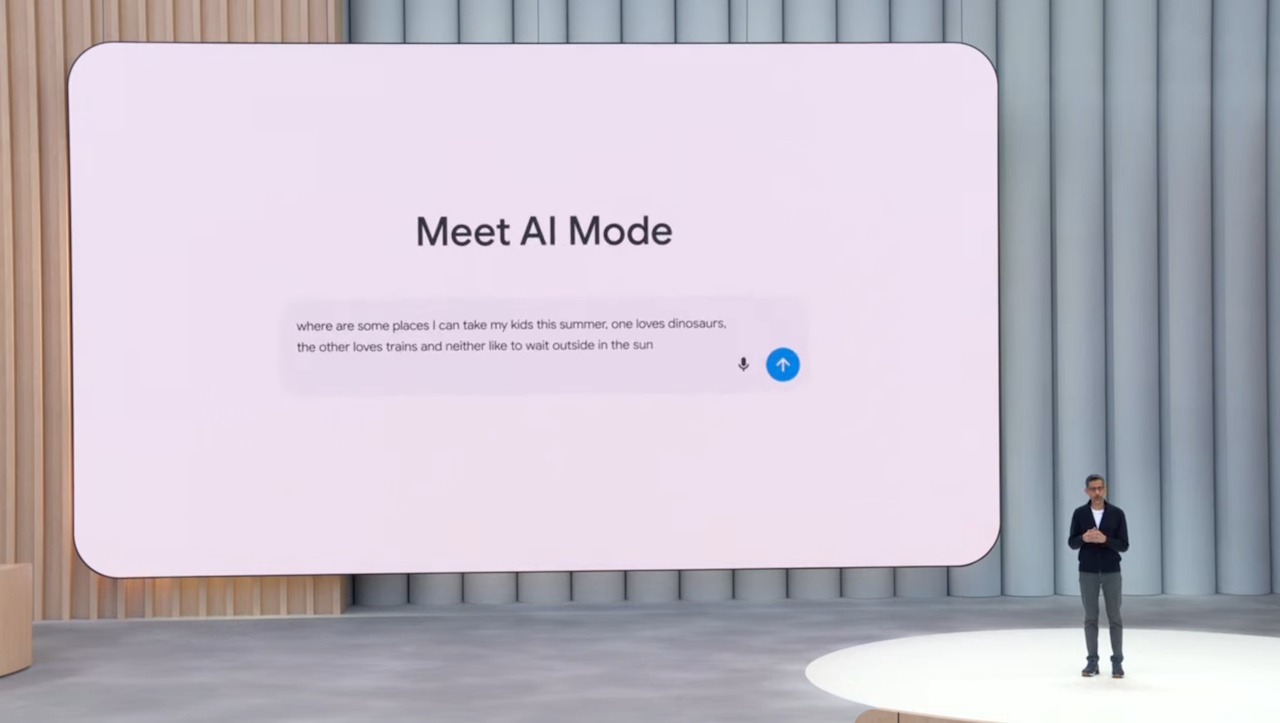

Preenchendo a lacuna entre a pesquisa por voz conversacional e a atribuição na Web, o Google está testando uma nova interface que sobrepõe cartões de citação visuais durante respostas faladas em tempo real. O recurso experimental, identificado no Modo IA da empresa, visa mitigar a natureza de “caixa preta” das interações de áudio.

Ao trazer à tona links de origem enquanto a IA fala, a atualização aborda críticas persistentes sobre “alucinações”, onde os modelos inventam fatos, e a erosão do tráfego dos editores. Ela integra os recursos de conversação do Gemini Live diretamente no produto de pesquisa principal.

Como funciona a nova interface de voz

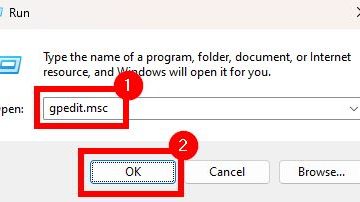

Identificada pelo especialista em SEO Sachin Patel durante um teste A/B, a atualização incorpora o Capacidade de pesquisa ao vivo diretamente no botão de alternância padrão do modo AI encontrado no Google app.

Ao contrário dos assistentes de voz anteriores, que geralmente funcionam como “caixas pretas” opacas, esta interface gera cartões de citação visuais em tempo real. À medida que a IA narra uma resposta, links de fontes relevantes aparecem na tela, permitindo que os usuários verifiquem afirmações específicas imediatamente.

Isso é novo no modo Ai (minha pergunta é – o que é SEO nele)? @brodieseo @rustybrick @gaganghotra_ pic.twitter.com/3N5hXtKmdm

— Sachin Patel (@SachuPatel53124) 6 de dezembro de 2025

Nos bastidores, o sistema aproveita os recursos multimodais da integração Gemini 3 recentemente implantada. Essa atualização de modelo foi projetada para lidar com consultas complexas em várias etapas que exigem a síntese de informações de fontes distintas.

Promo

Os executivos notaram uma mudança na forma como os usuários interagem com esses modelos mais capazes. Como observou anteriormente Hema Budaraju, diretor sênior de produto do Google, “com o Modo IA, já estamos vendo pessoas se aprofundando em tópicos complexos e fazendo perguntas quase três vezes mais do que pesquisas tradicionais”.

Mover essa funcionalidade do aplicativo independente Gemini para o ambiente de pesquisa de alto tráfego sinaliza uma grande mudança estratégica. Ele tenta normalizar a IA conversacional como um método de pesquisa principal, em vez de uma novidade.

A lacuna de confiança: mitigando alucinações

A pesquisa por voz tem historicamente sofrido com a falta de atribuição clara. Os usuários normalmente recebem uma resposta sintetizada sem saber de onde a informação se originou, dificultando a verificação.

Estrategicamente, a integração segue o lançamento do mecanismo de raciocínio Deep Think do Google. Essa arquitetura permite que o modelo faça uma pausa e raciocine antes de responder, um recurso que Demis Hassabis, CEO do Google DeepMind, descreveu como”o modelo mais avançado do Google para tarefas complexas”que pode”compreender vastos conjuntos de dados, problemas desafiadores de diferentes fontes de informação”.

Apesar desses avanços, a confiabilidade continua sendo um obstáculo crítico para adoção generalizada. Uma pesquisa independente sugere que os resultados da pesquisa generativa muitas vezes divergem significativamente das classificações tradicionais.

Um estudo de confiabilidade recente quantificou essa discrepância, descobrindo que 53% dos sites vinculados pela Visão geral de IA do Google não apareceram nos 10 principais resultados de uma pesquisa convencional. Isto indica uma divergência significativa dos sinais de classificação estabelecidos da pesquisa tradicional.

Essas descobertas destacam a “lacuna de confiança” que os cartões visuais pretendem preencher. Ao exibir as fontes específicas usadas para gerar uma resposta, o Google está tentando provar que sua IA está fundamentando suas respostas em conteúdo real da web, em vez de inventar fatos.

Tráfego versus respostas

Para empresas de mídia, a mudança para a pesquisa por voz “agentica” representa uma ameaça potencial ao tráfego de referência. Os editores temem que respostas de voz abrangentes eliminem a necessidade de clicar, mesmo que um cartão de citação esteja visível.

As plataformas estão contrariando essa narrativa, tentando redefinir o valor de uma interação de pesquisa. Eles argumentam que, embora o volume possa cair, a intenção do tráfego restante é maior.

A Microsoft tem sido particularmente eloquente sobre essa mudança nas métricas. Fabrice Canel, gerente principal de produtos do Bing, argumentou que”para os profissionais de marketing, a própria visibilidade está se tornando uma forma de moeda. Se você estiver moldando a preferência antes que um clique aconteça.”

Tanto a Microsoft quanto o Google divulgaram dados alegando que as taxas de conversão reivindicadas por referências de IA são até 3 vezes maiores do que o tráfego de pesquisa tradicional.

Os executivos de mídia continuam não convencidos por essa defesa de “qualidade em vez de quantidade”. Muitos veem a coleta de seus dados para treinamento em IA como uma violação fundamental da troca de valor da web.