A Microsoft está acelerando o desenvolvimento interno de chips de IA ao licenciar hardware proprietário e designs de sistemas de seu parceiro OpenAI, confirmou o CEO Satya Nadella esta semana. O movimento estratégico, revelado em entrevistas em 13 de novembro, dá à Microsoft acesso ao IP de silício personalizado da OpenAI, que está sendo desenvolvido em conjunto com a Broadcom.

Isso permite que a gigante de Redmond acelere seus próprios aceleradores de IA e construa uma pilha de hardware e software mais integrada verticalmente.

O acordo aprofunda a parceria das duas empresas até 2032 e posiciona a Microsoft para controlar melhor seus custos e roteiro de infraestrutura de IA de longo prazo, marcando um passo significativo na escalada da IA. corrida armamentista de hardware.

Uma parceria mais profunda forjada em silício

Em uma mudança estratégica significativa, a Microsoft está indo além de apenas fornecer infraestrutura de nuvem para OpenAI e está agora integrando as principais inovações de hardware de seu parceiro diretamente em seu próprio roteiro de silício.

O acordo de licenciamento concede à Microsoft direitos sobre todas as propriedades intelectuais em nível de sistema resultantes de sua colaboração com a OpenAI, incluindo designs de chips personalizados desenvolvidos em conjunto com a gigante de semicondutores Broadcom.

Esse acordo, que dá à Microsoft acesso à pesquisa de chips da OpenAI até 2030, foi projetado para permitir que a empresa industrialize e evolua a tecnologia sob sua própria propriedade intelectual.

Essa integração vertical é um componente central da estratégia de IA dual-track da Microsoft. Ao mesmo tempo que continua a aproveitar os modelos de fronteira da OpenAI, a empresa também está investindo pesadamente em suas próprias capacidades, incluindo a família de modelos MAI e aceleradores personalizados como o Maia.

Ao licenciar os designs comprovados da OpenAI, a Microsoft pode reduzir o risco e acelerar o desenvolvimento de seu próprio chip, uma vantagem crucial em um mercado dominado pela NVIDIA.

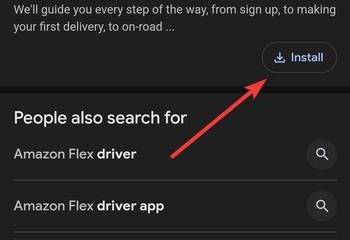

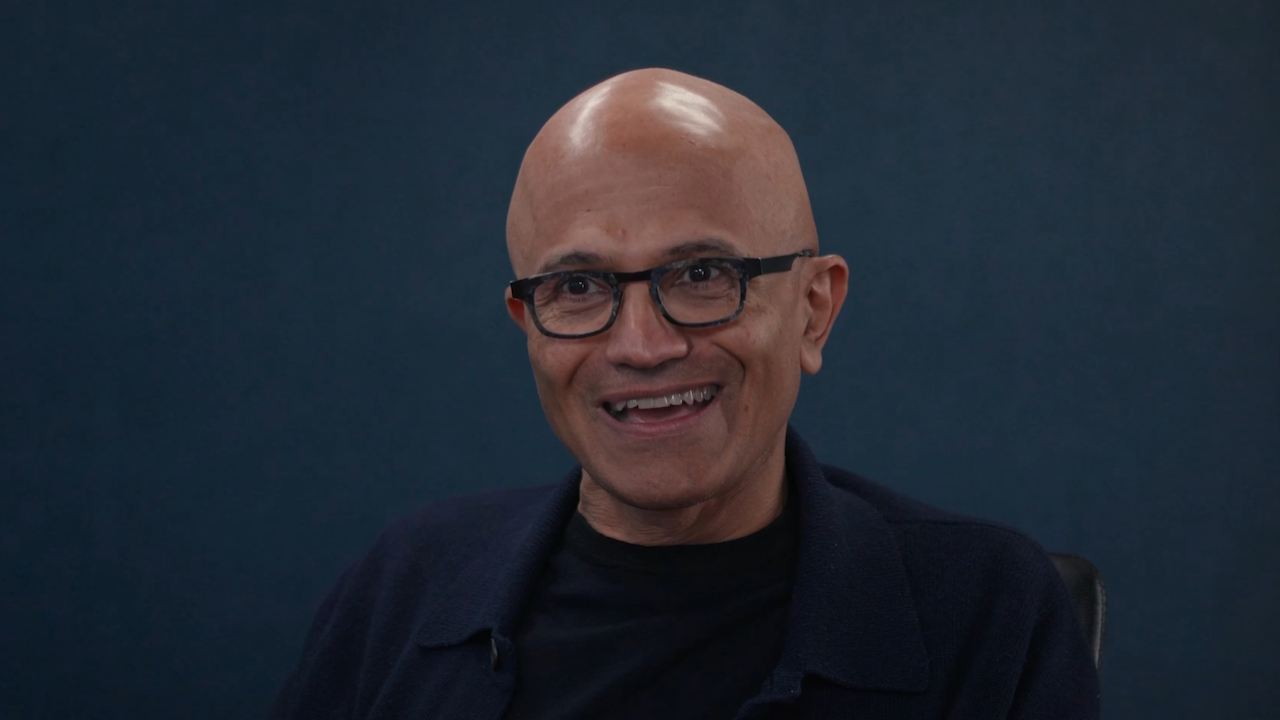

Como Satya Nadella explicou em uma entrevista recente no poscast de Dwarkesh Patel, isso garante que a Microsoft tenha uma vantagem de longo prazo, caminho flexível a seguir.

“Teremos acesso aos modelos OpenAI por mais sete anos, nos quais iremos inovar. Essencialmente, penso que temos um modelo de classe de fronteira que podemos usar e inovar com total flexibilidade”, disse Nadella.

[conteúdo incorporado]

O novo acordo também solidifica os laços financeiros e estratégicos entre as duas empresas.

Incluía a aquisição de uma participação de 27% na participação pública da OpenAI pela Microsoft. de benefícios, com uma avaliação de aproximadamente US$ 135 bilhões, e esclarece que a Microsoft manterá o acesso aos modelos da OpenAI mesmo depois que possíveis marcos de AGI forem alcançados.

Nadella foi clara sobre as ambições da empresa, afirmando: “A boa notícia aqui com o novo acordo é que podemos ter muito, muito certeza de que vamos construir uma equipe de superinteligência de classe mundial e persegui-la com uma grande ambição”.

De um “Grande”. Pausa”para um futuro verticalmente integrado

Os comentários de Nadella também fornecem um contexto crucial para a recente estratégia de infraestrutura da empresa.

No final de 2024 e início de 2025, analistas do setor notaram uma desaceleração significativa na construção do datacenter da Microsoft, um movimento que eles apelidaram de “Grande Pausa”. tinha atrapalhado sua liderança.

No entanto, Nadella reformula esse período como um movimento deliberado para evitar o aprisionamento geracional e construir uma frota mais resiliente e “fungível”.

Ele argumenta que a principal restrição à expansão da IA não é a disponibilidade de chips, mas de espaço de datacenter alimentado e resfriado, ou “conchas quentes”.

Construir muita capacidade otimizada para uma geração de hardware seria um enorme desperdício de capital. “Você não pode construir uma infraestrutura otimizada para um modelo”, disse Nadella.”Se você fizer isso, e se ficar para trás? Na verdade, toda a infraestrutura que você construiu será um desperdício.”

Esta filosofia destaca os imensos riscos financeiros da construção da IA, onde o investimento em hiperescala se aproxima de US$ 400 bilhões anualmente e atrai comparações com a bolha pontocom.

A decisão de licenciar o chip IP da OpenAI se encaixa perfeitamente nesta narrativa. Ele permite que a Microsoft crie hardware personalizado e altamente otimizado, projetado em conjunto com os modelos que executará, melhorando a eficiência e reduzindo os custos operacionais de longo prazo.

O movimento em direção à integração vertical é uma resposta direta ao imenso custo e à pressão competitiva da corrida armamentista de IA.

Navegando em uma corrida armamentista de vários modelos e vários fornecedores

Ao mesmo tempo em que aprofunda sua parceria de silício com a OpenAI, a Microsoft está simultaneamente protegendo suas apostas em todo o ecossistema de IA.

A empresa está trabalhando ativamente para reduzir sua dependência de qualquer hardware ou fornecedor de modelo único. Uma transcrição não confirmada circulando online de um suposto funcionário da Microsoft sugere que a empresa está enfrentando de frente o domínio do software da NVIDIA.

“Construímos alguns kits de ferramentas para ajudar a converter modelos CUDA em ROCm para que você possa usá-los em um AMD, como um 300X”, afirmou a fonte.

Essa ferramenta permitiria ao Azure executar cargas de trabalho críticas de IA em hardware AMD mais econômico, rompendo o poderoso fosso CUDA.

Essa estratégia de hardware de vários fornecedores reflete a abordagem da Microsoft na camada de aplicativo e modelo. A empresa também enfrenta concorrência crescente de parceiros como a Anthropic, que lançou recentemente o “Claude for Excel” para competir diretamente com os recursos Copilot da própria Microsoft em seu principal produto.

Em vez de bloquear tais movimentos, a Microsoft adotou uma estratégia multimodelo, integrando os modelos da Anthropic em suas próprias ofertas. mais opções para os clientes.

Isso posiciona o Azure não apenas como um provedor de OpenAI, mas como uma plataforma fundamental para um ecossistema diversificado de modelos e ferramentas de IA concorrentes. Ao controlar a infraestrutura subjacente, desde a plataforma de nuvem até o silício personalizado, a Microsoft pretende continuar sendo a base indispensável para toda a indústria de IA, independentemente de qual modelo ou aplicativo vencer qualquer batalha específica.