A Microsoft está introduzindo novos benchmarks de adoção do Copilot em sua plataforma Viva Insights, uma medida que permite aos gerentes monitorar e comparar como as equipes estão usando o principal assistente de IA da empresa.

O recurso permite que as organizações rastreiem o uso dentro de seus próprios departamentos e em relação a dados anonimizados de empresas semelhantes.

Embora a Microsoft afirme que o objetivo é melhorar o engajamento, a ferramenta evoca memórias de sua experiência. controverso “Pontuação de Produtividade”. Esse recurso foi fortemente criticado em 2020 como uma ferramenta de vigilância no local de trabalho antes de ser alterado para proteger a privacidade dos funcionários. Os novos benchmarks estão agora em versão prévia privada, com lançamento completo esperado ainda este mês.

Medindo a adoção de IA com novos benchmarks

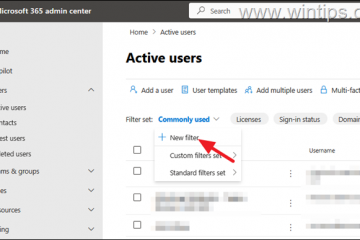

O novo recurso, oficialmente chamado de Benchmarks, é integrado diretamente ao Microsoft Copilot Dashboard no Viva Insights. Viva Insights é a plataforma analítica da empresa projetada para “absorver dados das atividades dos funcionários”, como afirma um relatório, ajudando a liderança a identificar padrões de colaboração, eficiência e potencial esgotamento em toda a força de trabalho.

Com as licenças Copilot representando um investimento contínuo significativo para as empresas, esses benchmarks fornecem uma maneira tangível para os gerentes medirem o envolvimento e justificarem as despesas. O sistema permite dois modos principais de comparação: análise interna e externa.

Internamente, os gerentes podem comparar diferentes “grupos” dentro de sua organização com base em atributos como cargo, região geográfica ou tipo de gerente.

O painel apresenta métricas importantes, como a porcentagem de usuários ativos do Copilot, taxas de adoção em aplicativos específicos do Microsoft 365 e a porcentagem de usuários recorrentes. Uma baixa taxa de usuários recorrentes, por exemplo, pode indicar que os funcionários estão experimentando a IA, mas não encontram valor sustentado em seus fluxos de trabalho diários.

O recurso de benchmarking externo introduz uma dinâmica competitiva, permitindo que uma empresa meça suas taxas de adoção em relação a pares anônimos do setor.

As organizações podem ver como sua porcentagem de usuários ativos se compara aos “10% e 25% principais” dos empresas similares ou contra uma média geral de todos os clientes. Isso pode pressionar as equipes a aumentar seu uso para atender ou exceder as normas do setor.

Para maior clareza, a Microsoft oferece uma definição específica do que ela rastreia. Um “usuário ativo do Copilot” é alguém que “executou uma ação intencional para um recurso alimentado por IA” em uma ampla gama de produtos, incluindo Teams, Outlook, Word, Excel, PowerPoint, OneNote e Loop.

A empresa enquadra o propósito da ferramenta de forma positiva, afirmando que “esses insights ajudam a identificar tendências de adoção e fornecem um contexto mais amplo e novas oportunidades para melhorar o envolvimento do Copilot”.

Déjà Vu? Ecos da controvérsia da “Pontuação de Produtividade”

Essa mudança não está acontecendo no vácuo. Em 2020, a Microsoft enfrentou uma reação negativa significativa em relação à privacidade em relação à sua “Pontuação de Produtividade” no Microsoft 365. Críticos e defensores da privacidade criticaram o recurso por permitir o monitoramento individual de funcionários, com alguns chamando-o de ferramenta de “vigilância no local de trabalho”.

A pontuação original poderia mostrar aos gerentes, por nome, quem era menos ativo nos canais do Teams ou contribuía menos para documentos compartilhados. O pesquisador austríaco Wolfie Christl twittou: “isso é tão problemático em muitos níveis”, capturando a preocupação generalizada de que a ferramenta era um passo em direção ao gerenciamento algorítmico invasivo.

Em uma declaração na época, a Microsoft insistiu que a “pontuação de produtividade não é uma ferramenta de monitoramento de trabalho. No entanto, o clamor público foi substancial o suficiente para forçar uma mudança.

Apenas uma semana após a controvérsia inicial, o vice-presidente executivo do Microsoft 365, Jared Spataro, anunciou grandes mudanças na ferramenta.

Ele declarou: “Ouvimos o feedback e hoje estamos respondendo fazendo alterações no produto para reforçar ainda mais a privacidade dos clientes”, confirmando que a Microsoft removeria nomes de usuários e se concentraria apenas em dados agregados. Essa história paira sobre os novos benchmarks do Copilot.

Proteções de privacidade e preocupações persistentes

A Microsoft parece ter aprendido com seus erros passados, incorporando considerações de privacidade nos novos benchmarks desde o início. Para comparações externas, a empresa afirma que usa “modelos matemáticos randomizados” para garantir que nenhum dado de uma única empresa possa ser identificados.

Além disso, cada grupo de benchmark externo é composto por pelo menos 20 empresas diferentes, adicionando outra camada de anonimato.

Para comparações internas, a Microsoft explica como calcula os resultados esperados. De acordo com a empresa, “o resultado da coorte analisa a composição de funções do grupo selecionado e constrói um resultado médio ponderado esperado com base na correspondência de funções entre os inquilinos”.

Apesar dessas salvaguardas, a própria existência da ferramenta levanta questões. O principal receio é que os gestores possam interpretar mal os dados, equiparando a elevada utilização do Copilot a elevado desempenho. Isso poderia levar os funcionários a “manipular o sistema”, executando ações superficiais de IA simplesmente para aumentar suas métricas.

Esse comportamento prejudicaria o objetivo de ganhos genuínos de produtividade e poderia prejudicar o moral. À medida que as organizações navegam na transição da IA, a linha entre incentivar a adoção e permitir a vigilância continua a ser uma questão crítica e sensível que a Microsoft deve navegar com cuidado.