A IA Mistral baseada em Paris lançou um recurso de memória para seu assistente de LE Chat, tornando-o o mais recente jogador importante a competir no campo cada vez mais lotado da IA personalizada. Capacidade semelhante. concorrentes. Ele também chega como parte de uma estratégia dupla, emparelhada com a liberação de mais de 20 conectores de grau corporativo. A função”Memórias”é uma versão beta opt-in, garantindo que os usuários consentem ativamente para que seus dados sejam armazenados. A empresa fornece Documentação detalhada sobre suas práticas de manipulação de dados . armazenado. Isso posiciona o bate-papo como uma alternativa atenciosa em um mercado em que o recall de IA provocou emoções e preocupações significativas de privacidade. De um lado, o Openai e o Google, que adotaram um modelo persistente,”sempre ativo”. O OpenAai atualizou o ChatGPT em abril de 2025 para referir implicitamente o histórico de bate-papo de um usuário. O diretor sênior do aplicativo Gemini, do Google, Michael Siliski, disse que o objetivo é que “o aplicativo Gemini agora possa fazer referência às suas conversas anteriores para aprender suas preferências, oferecendo respostas mais personalizadas quanto mais você o usa.”

Essa divergência estratégica reflete um debate fundamental no desenvolvimento da IA. O acampamento”sempre atinge”a criação de um assistente proativo profundamente integrado que antecipa as necessidades do usuário. O acampamento”iniciado pelo usuário”prioriza a transparência, apostando que os usuários valorizam a previsibilidade e o controle sobre o aprendizado autônomo.

Google, por sua parte, tenta preencher essa lacuna. While its memory is persistent, spokesperson Elijah Lawal said that “equally crucial is giving you easy controls to choose the experience that’s best for you, so you can turn this feature on and off at any time,”pointing to its “Temporary Bate-papos”Recurso Como prova. Anthropic introduced a memory feature for Claude in August 2025 that stands in stark contrast to the persistent models.

According to spokesperson Ryan Donegan, “it’s not yet a persistent memory feature like OpenAI’s ChatGPT. Claude will only retrieve and reference your past chats when you ask it to, and it’s not building a user profile.”

This design aligns with the company’s public safety estrutura. O CEO Dario Amodei enquadrou essa abordagem centrada no ser humano como essencial, afirmando:”Estamos indo para um mundo em que um desenvolvedor humano pode gerenciar uma frota de agentes, mas acho que o envolvimento humano contínuo será importante para o controle de qualidade…”

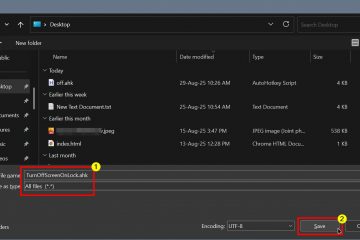

O cenário competitivo agora é bem definido. A Microsoft integrou a memória em Copilot em abril de 2025, e o Xai de Elon Musk fez o mesmo para Grok no mesmo mês, criando um mercado em que a memória agora é um recurso de risco de tabela. É também um jogo corporativo significativo. O lançamento simultâneo de mais de 20″conectores movidos a MCP”para ferramentas como Github, Snowflake e Asana ressalta essa ambição. Esses conectores transformam o bate-papo em um hub central para fluxos de trabalho de negócios. Essa capacidade do tipo agente é o que permite que a IA mova de simplesmente responder a perguntas para executar ativamente tarefas no ecossistema de software existente de um usuário. A conveniência da memória da IA cria um alvo valioso e vulnerável para atores maliciosos. Os pesquisadores de segurança cibernética demonstraram repetidamente esses riscos. O pesquisador Johann Rehberger explicou que, incorporando comandos inativos,”quando o usuário mais tarde diz \”x \”[para o comando programado], Gêmeos, acreditando que está seguindo a instrução direta do usuário, executa as ferramentas”, o que pode corromper a memória da IA. Uma vulnerabilidade na memória do ChatGPT permitiu a exfiltração de dados confidenciais no final de 2024.

Além disso, os novos conectores MCP apresentam um risco. Um relatório recente da empresa de segurança Pynt descobriu que um em dez plugins MCP é totalmente explorado . Um ataque não é apenas um fracasso único; Ele pode envenenar a base de conhecimento da IA, levando a erros repetidos ou vazamentos sutis de dados ao longo do tempo. Isso torna a integridade das’memórias’armazenadas uma fronteira crítica de segurança para todos os provedores. Equilibrar a inovação com a confiança do usuário continua sendo o desafio crítico nesta nova era da IA personalizada.