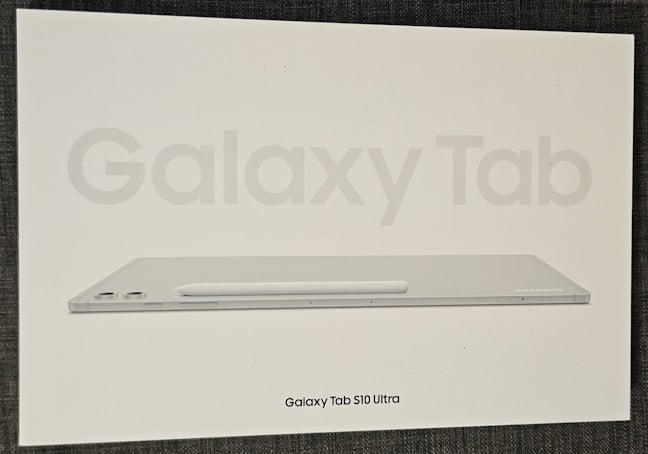

Quando a Samsung lançou seu primeiro tablet Ultra em 2022, foi um esforço ambicioso para redefinir o que um tablet poderia ser e confundir os limites entre tablets e laptops. Dois anos depois, o Galaxy Tab S10 Ultra chega como o mais recente candidato da Samsung à coroa dos tablets Android. Embora não se afaste muito de seus antecessores, este novo modelo traz melhorias sutis de hardware e um grande foco nos recursos de IA do Galaxy. Mas serão estas atualizações suficientes para justificar o seu preço premium? Nesta análise, compartilharei minha experiência prática com o Galaxy Tab S10 Ultra, destacando seus pontos fortes e fracos para ajudá-lo a determinar se ele é adequado para você:

Samsung Galaxy Tab S10 Ultra: para quem é indicado?

O Samsung Galaxy Tab S10 Ultra é uma excelente escolha para:

Designers gráficos, animadores, pintores ou desenhistas Criadores de conteúdo e usuários empresariais que desejam um tablet para substituir seu laptop Pessoas que desejam assistir filmes em um tablet superdimensionado com uma bela tela

Designers gráficos, animadores, pintores ou desenhistas Criadores de conteúdo e usuários empresariais que desejam um tablet para substituir seu laptop Pessoas que desejam assistir filmes em um tablet superdimensionado com uma bela tela

Prós e contras

Essas são as coisas O que mais gosto no Samsung Galaxy Tab S10:

Sete anos de atualizações de software Graças ao Samsung DEX, este tablet pode substituir seu laptop Recursos úteis de IA e produtividade A S Pen está incluída e funciona muito bem Excelente desempenho Linda tela com um revestimento anti-reflexo

Quanto às desvantagens:

Seu tamanho e engastes finos podem dificultar sua portabilidade É caro, assim como seus acessórios Carregamento lento

Classificação do produto 4/5

Veredicto

O Samsung Galaxy Tab S10 Ultra é um tablet impressionante, embora não seja isento de falhas. Sua enorme tela de 14,6 polegadas é excelente para trabalho e entretenimento, e a S Pen, Galaxy AI e Samsung DEX incluídos o tornam uma potência de produtividade especialmente útil para artistas e criadores de conteúdo. Embora este tablet use um chipset Mediatek Dimensity 9300, achei-o rápido, ágil e confiável. Também gosto que a Samsung prometa sete anos de atualizações, o que é raro no mundo dos tablets Android. No entanto, seu tamanho grande pode dificultar o transporte, o carregamento é lento e a falta de acessórios incluídos parece mesquinho devido ao seu preço muito alto. Embora não seja perfeito, se você concordar com seu tamanho e custo elevado, o Samsung Galaxy Tab S10 Ultra é um dos melhores tablets que você pode comprar.

Desembalar o Samsung Galaxy Tab S10 Ultra

A embalagem do Samsung Galaxy Tab S10 Ultra é minimalista e feita de materiais reciclados. Na parte superior você vê o nome do produto e uma foto do tablet. Fiquei feliz em ver a S Pen na foto, pois isso significava que ela estava incluída no tablet.

A embalagem do Samsung Galaxy Tab S10 Ultra é minimalista

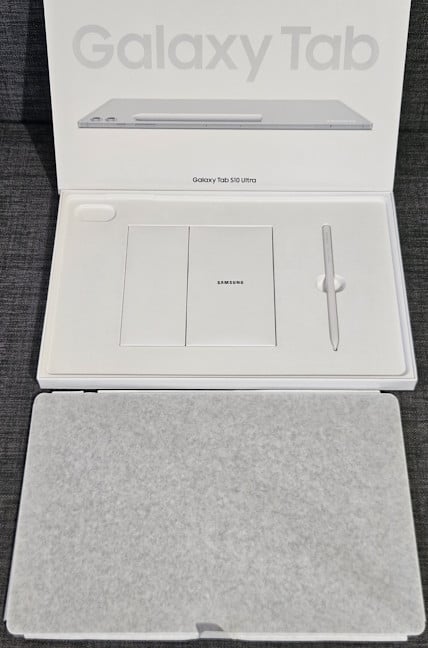

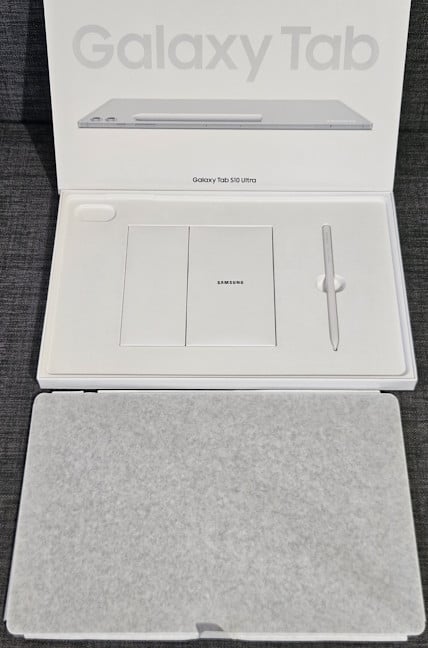

A Samsung não tem o hábito de imprimir especificações detalhadas de hardware em suas embalagens, então não há nada de interessante nas laterais. Abra a caixa e você verá imediatamente o tablet dentro de uma embalagem protetora. Retire-o e embaixo você encontrará a S Pen ao lado de duas pequenas caixas de papelão.

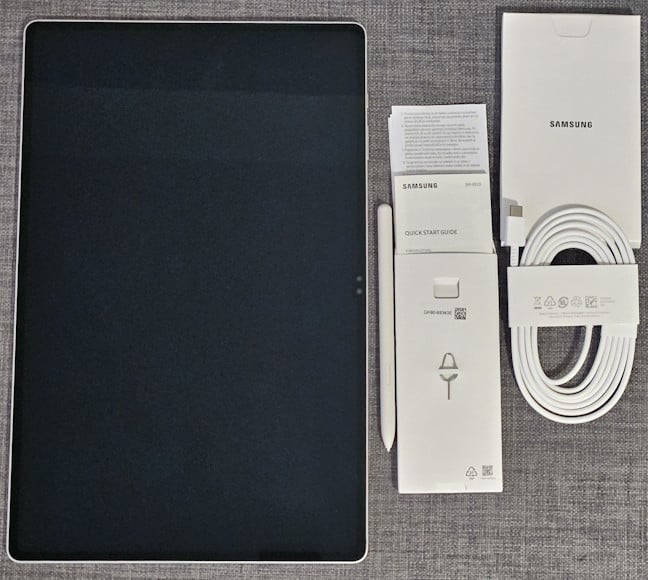

Desembalagem do Samsung Galaxy Tab S10 Ultra

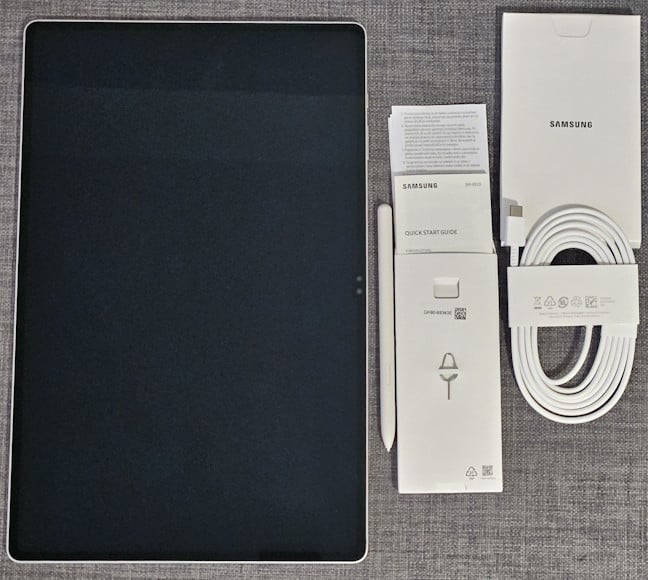

Ao desembalar tudo, você encontra os seguintes itens: o Samsung Galaxy Tab S10 Ultra, sua S Pen, um cabo de carregamento USB-C, uma ferramenta de ejeção para o Bandeja microSD, um guia de início rápido e detalhes de garantia.

Todos os itens e acessórios encontrados dentro da caixa

Até embora o Samsung Galaxy Tab S10 Ultra seja um dos tablets mais caros do mercado, sua experiência de desembalagem é rápida e direta. A Samsung não inclui nenhum acessório fora da S Pen, nem mesmo um carregador ou um case.

Design e qualidade de construção

Em termos de design, o Samsung Galaxy Tab S10 Ultra se assemelha muito ao seu antecessor, o Galaxy Tab S9 Ultra. As principais diferenças são que ele é um pouco mais fino e mais leve. Ambos os modelos compartilham o mesmo tamanho de 14,6 polegadas e design geral. Especificamente, o Galaxy Tab S10 Ultra mede 208,6 x 326,4 x 5,4 mm (ou 8,21 x 12,85 x 0,21 polegadas) e pesa apenas 723 gramas (ou 2,35 libras). Possui acabamento fosco na parte traseira. Nele você vê o logotipo da Samsung, a área de carregamento magnético da S Pen, duas câmeras traseiras e um flash.

A S Pen é carregada na parte traseira

Na parte traseira na borda superior, você encontra o botão Liga/Desliga e o botão de volume. Há também um microfone, um orifício de ventilação e uma bandeja para cartão microSD. A Samsung oferece este tablet nas versões Wi-Fi e LTE. Para a versão LTE, a bandeja do cartão acomoda o cartão SIM necessário para conectividade móvel.

Os botões estão na borda superior

A borda inferior hospeda apenas a porta dock do teclado. Infelizmente, a Samsung não inclui teclado no tablet, exigindo uma compra separada, o que torna o custo total ainda maior do que já é.

Na borda inferior, você pode conectar um teclado

A borda esquerda do Galaxy Tab S10 Ultra possui dois alto-falantes e um microfone.

Samsung Galaxy Tab S10 Ultra possui uma configuração de alto-falante estéreo

Na borda direita, você encontra a porta USB Type-C (usada para carregar o tablet e conectar um fone de ouvido USB-C) e mais dois alto-falantes.

A porta USB-C está na borda direita

Ao olhar para a tela e ligá-la, você também verá um entalhe na parte superior, que abriga o sistema de câmera frontal.

O entalhe ainda está lá

Samsung vende o Galaxy Tab S10 Ultra em duas opções de cores: Platinum Silver (a que recebi para teste) e Moonstone Grey. Ambas as cores parecem boas, mas são um tanto conservadoras.

As opções de cores para Samsung Galaxy Tab S10 Ultra

Como esperado de um tablet premium, a qualidade de construção é excelente. O Galaxy Tab S10 Ultra possui uma estrutura de alumínio Armor aprimorada que é mais durável do que nunca e oferece resistência IP68 à água e poeira.

Embora o Galaxy Tab S10 Ultra seja um tablet bem construído, ele não apresenta características significativas. mudanças de design em comparação com seu antecessor, o Galaxy Tab S9 Ultra. A maioria das pessoas achará difícil distinguir entre os dois modelos. O tamanho deste tablet é seu recurso de destaque e seu aspecto mais polêmico, já que muitos usuários podem considerá-lo grande demais para um uso confortável.

Especificações de hardware

O Samsung Galaxy Tab S10 Ultra possui uma impressionante tela AMOLED dinâmica de 14,6 polegadas com uma taxa de atualização que pode ir até 120 Hz. Infelizmente, você não pode definir manualmente a taxa de atualização para 120 Hz. Você só pode configurá-lo como adaptativo (o tablet ajusta automaticamente a taxa de atualização com base em como você o usa) ou padrão (60 Hz). Apesar desta limitação, a tela tem brilho máximo de 930 nits e um revestimento anti-reflexo avançado que a Samsung afirma refletir menos de 2% da luz. Essas melhorias devem melhorar a visibilidade externa e o desempenho sob luz forte.

A tela tem tamanho de 14,6 polegadas

Outro destaque é a saída da Samsung da Qualcomm Snapdragon, optando pelo octa-core chipset Mediatek Dimensity 9300. O tablet oferece opções flexíveis de configuração com 12 GB ou 16 GB de RAM e opções de armazenamento que variam de 256 GB a 1 TB. Uma generosa bateria de 11.200 mAh alimenta o dispositivo. No entanto, a Samsung decepciona com sua tecnologia de carregamento, com o Galaxy Tab S10 Ultra suportando apenas carregamento rápido de 45 watts, o que é lento para um tablet premium fabricado em 2024.

Samsung Galaxy Tab S10 Ultra é equipado com Mediatek Dimensity 9300

O tablet oferece conectividade moderna Wi-Fi 7 e Bluetooth v5.3, junto com rastreamento GPS. O chipset Mediatek Dimensity 9300 inclui uma Unidade de Processamento Neural (NPU) para lidar com cargas de trabalho de IA. No entanto, o tablet não possui um chip NFC, o que significa que os usuários não podem usá-lo para pagamentos móveis ou emparelhamento rápido de dispositivos. O sistema de câmera permanece inalterado em relação ao seu antecessor:

Câmeras traseiras: lente grande angular de 13 megapixels com foco automático e lente ultra grande angular de 8 megapixels Câmeras frontais: duas lentes de 12 megapixels (grande angular e ultra grande angular)

Os recursos de gravação de vídeo são limitado a uma resolução 4K a 30 quadros por segundo (fps) ou 1080p a 30 fps.

As câmeras na parte traseira

Os alto-falantes no Samsung O Galaxy Tab S10 Ultra é ajustado pela AKG e deve fornecer boa qualidade de áudio.

O Samsung Galaxy Tab S10 Ultra possui especificações de hardware adequadas um tablet premium. No entanto, as atualizações são relativamente modestas, com as mudanças mais notáveis sendo a mudança para um chipset MediaTek Dimensity 9300 e uma tela mais brilhante com revestimento anti-reflexo. Embora o tablet ofereça uma capacidade de bateria substancial, as suas capacidades de carregamento rápido continuam a ser decepcionantes.

Estes são os principais destaques técnicos do Samsung Galaxy Tab S10 Ultra. Para mais detalhes e especificações, visite a página oficial do produto: Samsung Galaxy Tab S10 Ultra.

A experiência do usuário em o Samsung Galaxy Tab S10 Ultra

O Samsung Galaxy Tab S10 Ultra é um dispositivo que pode encantar ou frustrar, dependendo de como você o usa e como se sente em relação ao seu tamanho. Se a portabilidade e a operação com uma mão são suas prioridades, o Galaxy Tab S10 Ultra pode parecer pesado, tornando seu irmão menor, o Galaxy Tab S10 Plus, uma opção melhor. No entanto, se você está procurando um tablet que possa funcionar como um substituto de laptop e oferecer uma experiência de exibição impressionante, o Galaxy Tab S10 Ultra é difícil de superar.

O 14,6 A tela AMOLED de 2,5 polegadas é uma das melhores que você pode obter. Suas cores vibrantes, detalhes nítidos e brilho aprimorado tornam-no o melhor que vimos até agora em tablets Samsung. Assistir filmes e transmitir vídeos do YouTube nesta tela é uma delícia, oferecendo uma bela experiência cinematográfica. Por outro lado, seu tamanho grande o torna menos prático para jogos portáteis. Embora o hardware do tablet possa lidar com jogos exigentes com facilidade, seu tamanho físico torna a experiência de jogo desconfortável. Felizmente, conectar um mouse e um teclado pode melhorar sua experiência.

A tela AMOLED é ótima para filmes

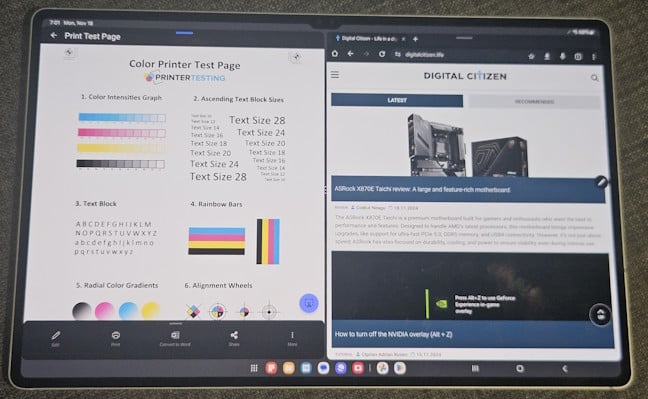

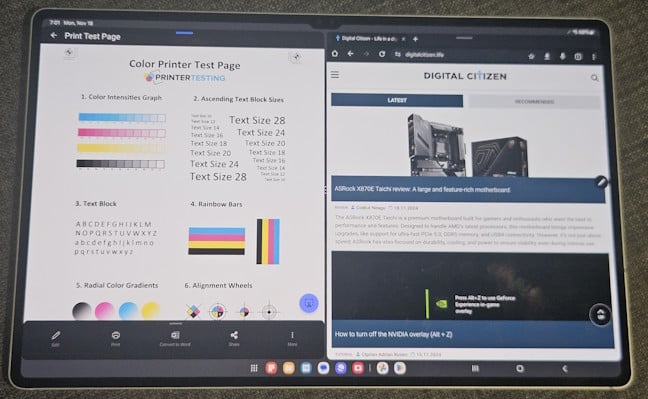

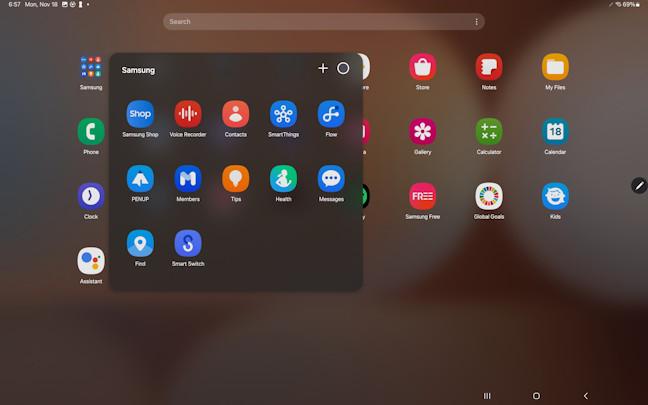

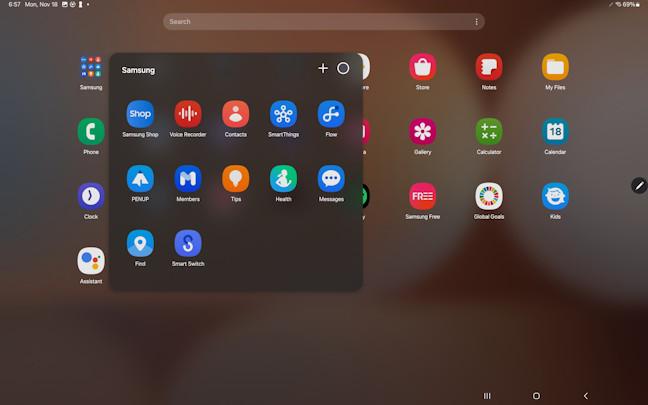

A produtividade é outra área onde o Galaxy Tab S10 brilha. A tela grande permite multitarefa eficiente, com o Samsung DEX transformando o tablet em um ambiente semelhante ao de um laptop. Você pode executar vários aplicativos lado a lado, editar documentos, conectar periféricos externos como mouse e teclado Bluetooth e começar a trabalhar.

A multitarefa funciona muito bem no Galaxy Tab S10 Ultra

A S Pen é uma ferramenta versátil que permite fazer anotações ou usar rapidamente recursos como Círculo para Pesquisar para encontrar coisas on-line. Mas o seu verdadeiro potencial brilha em empreendimentos criativos. A combinação da tela grande do tablet, da S Pen de baixa latência e da precisão o torna uma excelente escolha para artistas digitais. Se você está experimentando a criação de arte digital, recomendo que experimente o aplicativo PENUP, que é um recurso valioso para aprender a desenhar em seu tablet.

A S Pen é super suave e responsivo

Um pequeno inconveniente é o armazenamento da S Pen. Embora carregue magneticamente na parte de trás do tablet, seu posicionamento o torna propenso a rolar quando o Galaxy Tab S10 Ultra é movido ou retirado de uma bolsa. Isso pode ser frustrante para usuários que viajam com frequência.

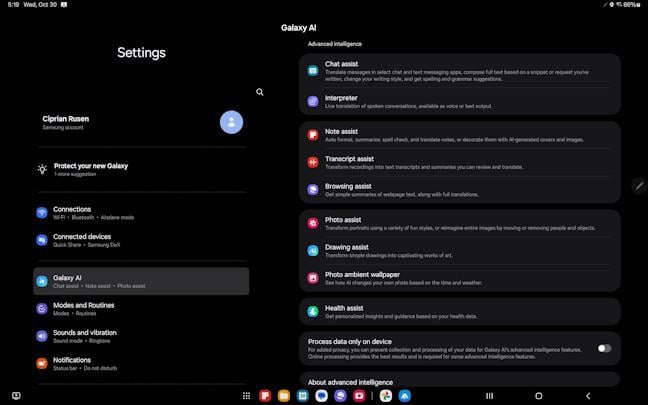

A Samsung equipou o Galaxy Tab S10 Ultra com uma série de recursos alimentados por IA, como Note Assist, Sketch to Image, Interpreter e Drawing Assist. Essas ferramentas variam desde aplicativos divertidos, como desenho assistido por IA, até aprimoramentos de produtividade, como transcrição de voz para texto e tradução em tempo real. Apresentei aqueles que considerei mais úteis neste artigo: Samsung Galaxy Tab S10 Ultra: 5 truques para ser mais produtivo com o Galaxy AI.

Você obtém muitos recursos do Galaxy AI

Desbloquear um tablet deste tamanho sem biometria pode ser complicado, mas a Samsung oferece várias opções. O leitor de impressão digital na tela é preciso e responsivo, embora seja mais fácil de usar quando o tablet está no modo paisagem ou colocado em um suporte. Felizmente, o desbloqueio facial é uma excelente alternativa, que funciona bem independentemente da orientação do tablet. É ainda mais útil se você planeja manter o Samsung Galaxy Tab S10 Ultra em sua mesa e usá-lo de forma semelhante a um laptop.

O leitor de impressão digital nem sempre é fácil de pressionar

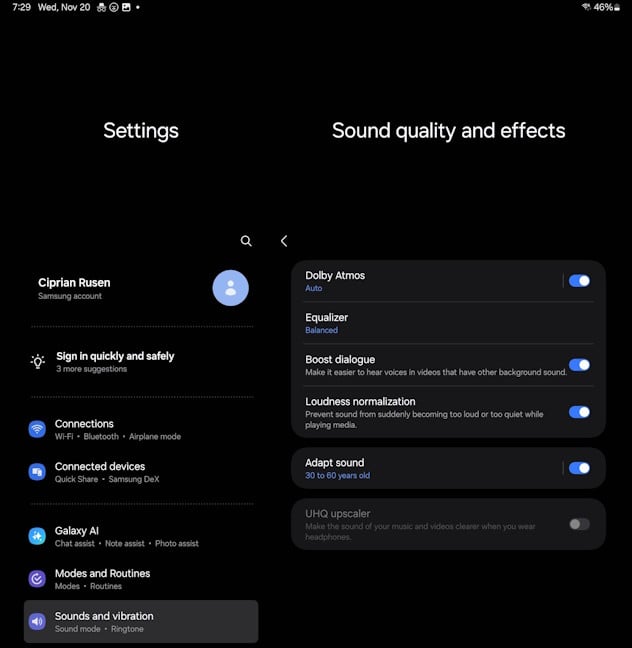

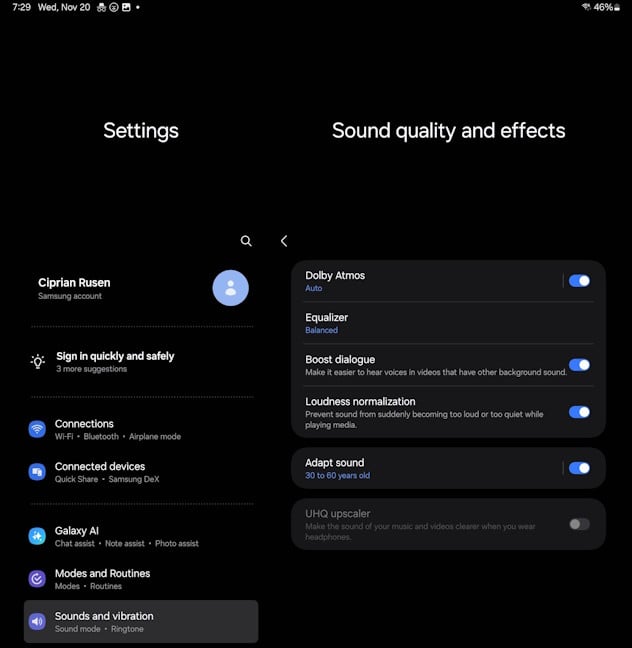

A qualidade do som deste tablet é uma das melhores que você pode obter em tablets. Os alto-falantes do Galaxy Tab S10 Ultra são altos, claros e adequados para música, filmes ou podcasts. O suporte Dolby Atmos melhora a imersão do áudio, enquanto configurações adicionais permitem aprimoramento de diálogos e ajustes de som com base na idade do usuário. No entanto, o posicionamento dos alto-falantes ao longo das bordas do tablet significa que o som não fica voltado diretamente para o usuário, o que diminui um pouco a experiência.

Samsung Galaxy Tab S10 Ultra possui alto-falantes competentes

Dado o tamanho substancial do Samsung Galaxy Tab S10 Ultra, é improvável que as pessoas o utilizem para fotografia. Em vez disso, o tablet atende a propósitos práticos, como digitalização de documentos e videoconferência, onde seu sistema de câmera funciona de forma competente. Embora as câmeras deste tablet produzam bons resultados, elas ficam aquém do que você obteria em um Samsung Galaxy S24 Ultra. A gravação de vídeo é igualmente restrita, limitada a 30 quadros por segundo nas resoluções 4K e 1080p. Você também não possui estabilização ótica de imagem e o zoom digital é restrito a uma modesta ampliação de 2X.

Samsung Galaxy Tab S10 Ultra não é ótimo para tirar fotos

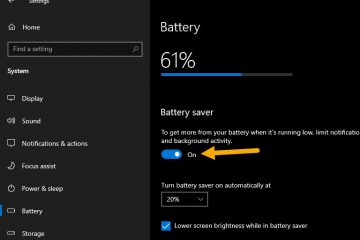

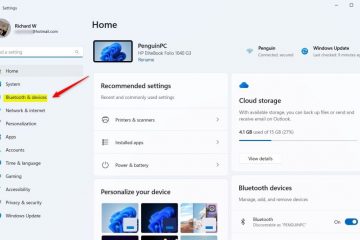

Galaxy Tab S10 Ultra vem com One UI 6.1 pré-instalado, que é baseado no Android 14. Samsung a interface do usuário é intuitiva e rápida, com a taxa de atualização dinâmica melhorando a suavidade das interações. No entanto, a abundância de aplicativos pré-instalados pode parecer excessiva. Juntamente com os aplicativos Android padrão feitos pelo Google, você obtém muitos aplicativos Samsung que clonam muitos dos aplicativos do Google, alguns aplicativos da Microsoft (Microsoft 365, OneDrive e Outlook) e alguns aplicativos de teste (Clip Studio, Goodnotes e LumaFusion). Prefiro ter menos aplicativos pré-instalados e recomendo que você desinstale aqueles que não precisa.

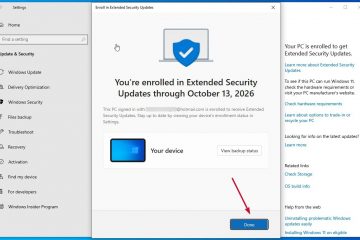

Um ponto positivo importante é o compromisso da Samsung com atualizações de software de longo prazo. O Galaxy Tab S10 Ultra receberá atualizações até outubro de 2031 – um ciclo de suporte de sete anos que poucas outras empresas igualam.

Há muitos aplicativos pré-instalados

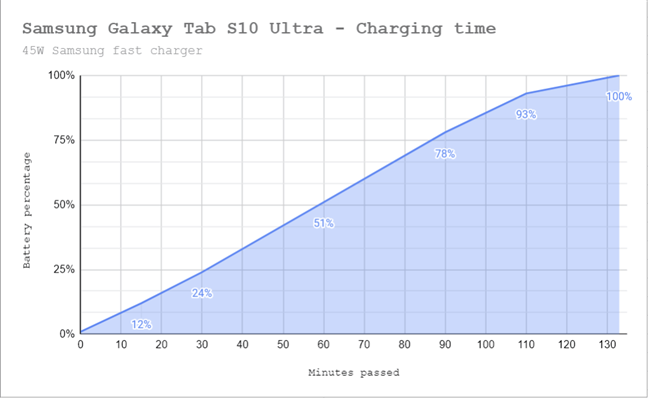

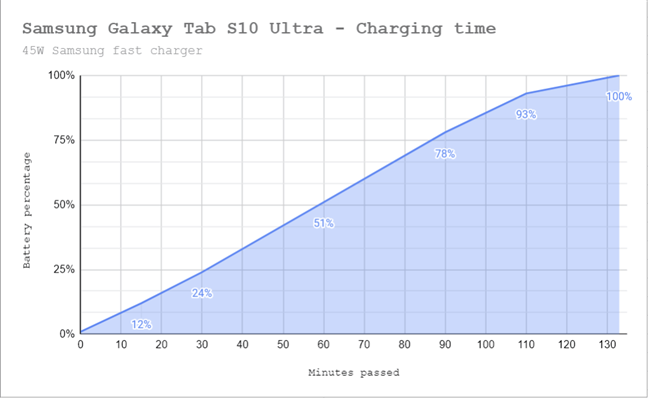

A duração da bateria é boa, com o tablet durando 9 horas e 36 minutos no teste de bateria do PCMark. Para usuários leves que precisam do tablet de sessenta a noventa minutos diariamente, o carregamento pode ser necessário uma vez a cada seis a sete dias. No entanto, a Samsung não inclui carregador, o que é decepcionante dado o preço premium do tablet. Usei um carregador Samsung de 45 W e consegui de 1% a 100% em duas horas e 13 minutos. Uma carga de trinta minutos aumentou de 1% para 24%, o que não é muito.

Como o Samsung Galaxy Tab S10 Ultra carrega sua bateria

O Samsung Galaxy Tab S10 Ultra é um dispositivo notável com alguns compromissos. Embora nem sempre seja confortável de usar devido ao seu tamanho, ele se destaca em vários aspectos: uma bela tela, qualidade de áudio sólida, S Pen versátil, recursos de IA de ponta e período de suporte de software líder do setor. Se você ainda não está convencido e busca métricas de desempenho detalhadas, a próxima página desta análise fornece resultados de referência para ajudá-lo a tomar uma decisão informada.