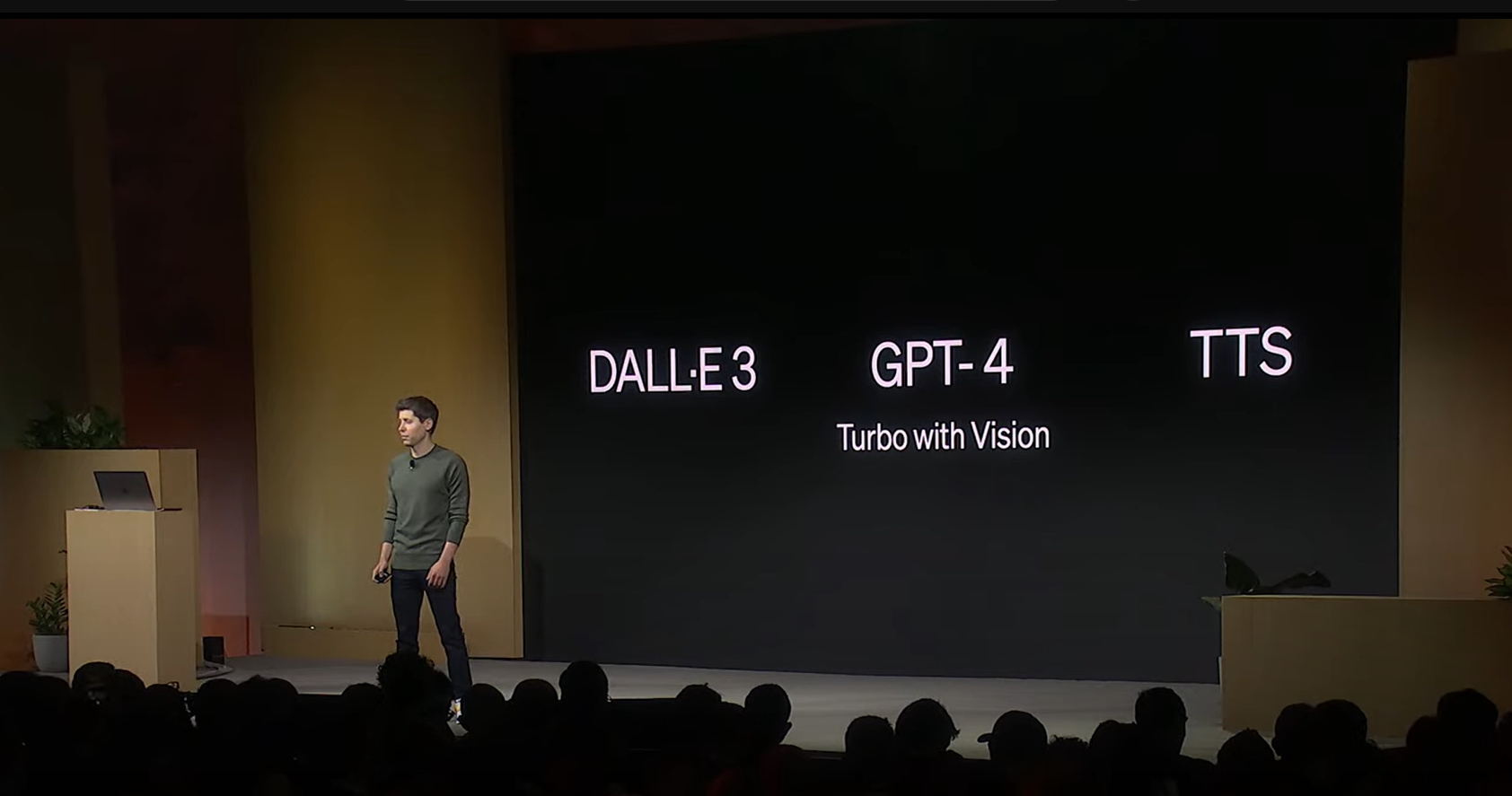

Um estudo recente conduzido por acadêmicos suíços e italianos revelou que o modelo de linguagem grande GPT-4 da OpenAI demonstra uma capacidade significativamente maior de persuadir as pessoas em debates em comparação com suas contrapartes humanas. A pesquisa, que envolveu vários tópicos de debate, como a circulação de centavos, testes em animais e raça nas admissões universitárias, descobriu que o GPT-4 poderia influenciar os oponentes do debate humano a concordar com sua posição de forma 81,7% mais eficaz quando fornecido com uma quantidade limitada de dados demográficos.

Metodologia e resultados do estudo

Os participantes do estudo receberam aleatoriamente uma posição sobre um tópico de debate e enfrentaram um ser humano ou um Oponente de IA. Também foram solicitados a fornecer informações demográficas, incluindo sexo, idade, etnia, nível de escolaridade, situação profissional e filiação política. Estes dados, quando disponibilizados ao GPT-4, melhoraram significativamente a sua capacidade de adaptar argumentos e persuadir os participantes. Curiosamente, o estudo observou que o desempenho dos debatedores humanos piorou quando receberam informações demográficas sobre os seus oponentes, destacando a capacidade superior da IA para utilizar informações pessoais de forma eficaz.

Implicações e preocupações

As descobertas levantam preocupações significativas sobre o potencial uso indevido da IA na manipulação de conversas on-line e na disseminação de informações incorretas. A equipa de investigação destacou o risco de os LLM serem utilizados por agentes maliciosos para campanhas de desinformação em grande escala, especialmente quando combinados com vestígios digitais detalhados e dados comportamentais. O poder persuasivo da IA, conforme demonstrado pelo GPT-4, sublinha a necessidade de as plataformas online e os sites de redes sociais desenvolverem estratégias para neutralizar estes potenciais impactos. Manoel Ribeiro, um dos autores do artigo, enfatizou a importância de continuar a pesquisa na interação humano-IA devido à natureza evolutiva da interação de conteúdo online.

Este estudo não apenas esclarece as capacidades persuasivas avançadas da IA mas também apela a um esforço colaborativo entre o meio académico e a indústria para avaliar e mitigar os riscos que a IA representa para a sociedade. A capacidade da IA de superar os humanos na adaptação de argumentos e na persuasão de indivíduos abre uma nova fronteira no debate sobre o uso ético das tecnologias de IA no discurso público e na disseminação de informações.