Meta estreou uma nova IA de código aberto que combina fluxos de dados, como texto , visual, áudio, movimento e temperatura. Segundo a empresa, o modelo – chamado ImageBind – mostra como os sistemas generativos de IA no futuro criarão experiências multissensoriais e imersivas. Claro, isso está relacionado ao objetivo principal da Meta de criar a tecnologia Metaverse.

No entanto, a Meta aponta que o ImageBind é apenas um protótipo e a empresa não está colocando nenhuma data para um lançamento futuro. Então, no momento, o projeto é apenas de pesquisa e não tem nenhuma aplicação para consumidores ou empresas. Mesmo assim, é razoável supor que a tecnologia que Meta está destacando se tornará parte de futuros modelos de IA.

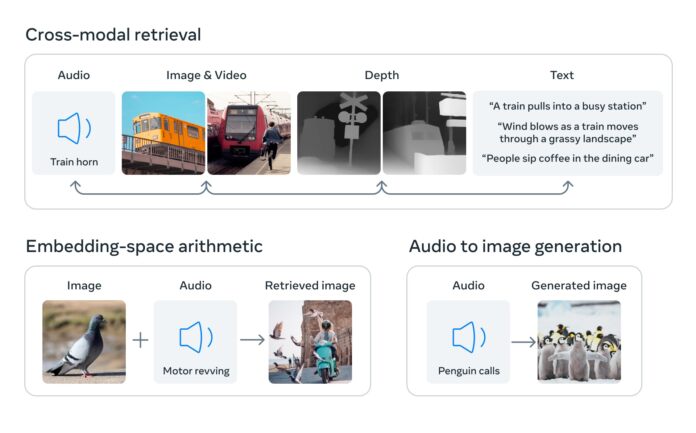

No centro da pesquisa está a capacidade de vincular vários tipos de dados em um único índice multidimensional. Isso é conhecido como espaço de incorporação e é essencialmente o que os modelos atuais de IA generativa multimodal podem fazer, como o GPT-4 da OpenAI.

DALL-E 2 é outro exemplo de IA que pode gerar imagens e texto juntos. Atualmente, a Microsoft está usando o DALL-E AI da OpenAI em seu Bing Image Creator. A Microsoft também está aproveitando o GPT-4 juntamente com seus próprios modelos de IA no Bing Chat.

ImageBind promete um novo nível de desempenho de IA multimodal

ImageBind faz parte de A iniciativa da Meta de criar sistemas multimodais que podem aprender com diversos tipos de dados. O modelo de IA não apenas entende um elemento, mas também é capaz de vinculá-lo a outros recursos. Por exemplo, ele pode gerar um vídeo de um cachorro vestindo uma roupa de Gandalf enquanto se equilibra em uma bola de praia a partir de uma descrição de texto, um prompt de imagem ou um prompt de áudio. Ele também pode realizar pesquisa cross-modal, aritmética multimodal e geração cross-modal.

A Meta afirma que o ImageBind alcança um novo desempenho de última geração em tarefas emergentes de reconhecimento zero-shot entre modalidades, ainda melhor do que modelos especializados anteriores treinados especificamente para essas modalidades. Isso significa que o modelo pode identificar objetos ou conceitos que nunca viu antes usando seu conhecimento multimodal.

O ImageBind pode eventualmente levar a avanços na acessibilidade e na criação de ambientes de realidade misturada. Por exemplo, um futuro fone de ouvido poderia construir cenas 3D totalmente realizadas com som, movimento e temperatura em tempo real. Ou, os desenvolvedores de jogos virtuais podem usá-lo para eliminar grande parte do trabalho braçal de seu processo de design.

A Meta diz que o ImageBind é o primeiro modelo de IA capaz de vincular dados de seis modalidades ao mesmo tempo. A empresa espera que, ao abrir o código do modelo, mas apenas para fins de pesquisa em andamento.

Meta Making AI Push apesar dos objetivos do Metaverse

Claro, Meta é a empresa controladora do Facebook. Foi lançado em parte para colocar distância entre a marca manchada do Facebook e outros projetos nos quais a empresa trabalha. Como o nome sugere, o foco do Meta é o metaverso. Em outras palavras, a IA não tem sido um driver para a empresa. Embora existam possibilidades claras para a IA e o metaverso interagirem.

Embora a empresa tenha jogado tudo por trás do Metaverso, mesmo perdendo bilhões de dólares, agora parece que a Meta pode precisar se voltar novamente para a IA. Certamente, embora o Metaverso não esteja morto (longe disso), ele não se tornou um setor de boom tecnológico da mesma forma que a IA.

De acordo com o CEO da empresa, Mark Zuckerberg, uma nova persona de assistente de bate-papo AI está em desenvolvimento que chegará ao Facebook e Instagram. Em março, a Meta também mostrou um novo projeto de IA que pode permitir que os robôs vejam, replicando o córtex visual do olho humano.

Os pesquisadores de IA da empresa desenvolveram duas inovações: coordenação sensório-motora adaptativa (ASC) e córtex visual (VC-1) i robot AI. ASC é uma estrutura que permite que os robôs aprendam com vídeos de humanos realizando tarefas cotidianas e depois adaptem suas ações a diferentes ambientes e formas de realização.

VC-1 é um modelo de percepção compatível com uma ampla gama de sensores sensório-motores habilidades, ambientes e formas de realização.

Dica do dia: o Histórico de arquivos é um recurso de backup do Windows que salva cada versão dos arquivos nos Documentos, Imagens, Vídeos, Área de trabalho e Pastas off-line do OneDrive. Embora seu nome implique um foco principal no controle de versão, você pode realmente usá-lo como uma ferramenta de backup completa para seus documentos importantes.